Czym jest Model Context Protocol (MCP)? Klucz do agentowej integracji AI

Agentowe AI redefiniuje automatyzację przepływów pracy dzięki Model Context Protocol (MCP), umożliwiając skalowalną, dynamiczną integrację agentów AI z różnorod...

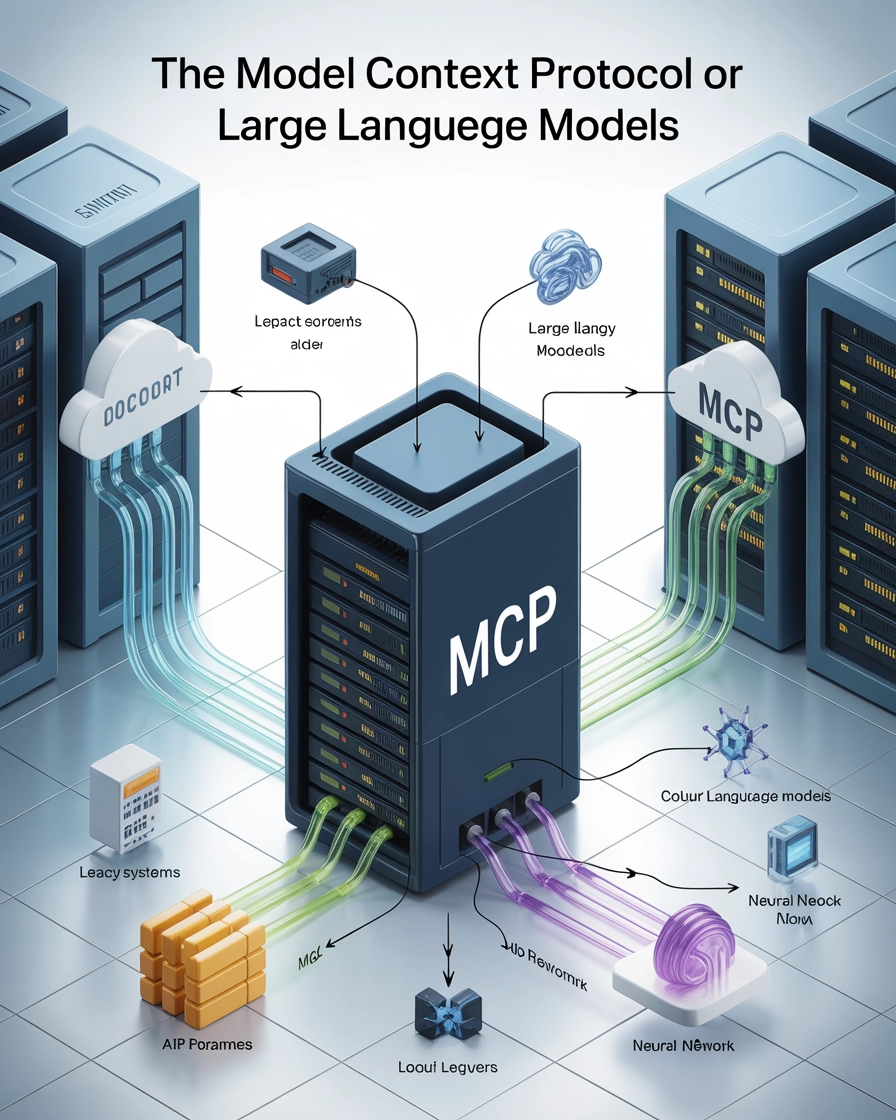

Model Context Protocol (MCP) to otwarty standard interfejsu, który umożliwia dużym modelom językowym (LLM) bezpieczny i spójny dostęp do zewnętrznych źródeł danych, narzędzi i funkcjonalności, działając jako „USB-C” dla systemów AI.

Model Context Protocol (MCP) to otwarty standard interfejsu, który umożliwia dużym modelom językowym (LLM) bezpieczny i spójny dostęp do zewnętrznych źródeł danych, narzędzi oraz dodatkowych funkcjonalności. MCP ustanawia standaryzowaną warstwę komunikacji pomiędzy aplikacjami AI a różnymi dostawcami kontekstu, pełniąc rolę „USB-C” dla systemów sztucznej inteligencji.

MCP opiera się na architekturze klient-serwer:

MCP definiuje trzy fundamentalne prymitywy, które stanowią podstawę protokołu:

Zasoby reprezentują dane i treści, które serwery MCP udostępniają dużym modelom językowym.

Przykład użycia: Serwer MCP udostępniający plik logów jako zasób o URI file:///logs/app.log

Prompt’y to zdefiniowane wcześniej szablony lub przepływy pracy, które serwery oferują w celu prowadzenia interakcji z LLM.

Przykład użycia: Prompt generatora wiadomości do commitów git, przyjmujący zmiany w kodzie jako wejście

Narzędzia udostępniają funkcje wykonawcze, które LLM mogą wywoływać (zazwyczaj za zgodą użytkownika) w celu wykonania akcji.

Przykład użycia: Narzędzie kalkulatora wykonujące działania matematyczne na wejściu dostarczonym przez model

// Serwer udostępniający pojedynczy plik logów jako zasób

const server = new Server({ /* config */ }, { capabilities: { resources: {} } });

// Listowanie dostępnych zasobów

server.setRequestHandler(ListResourcesRequestSchema, async () => {

return {

resources: [

{

uri: "file:///logs/app.log",

name: "Logi aplikacji",

mimeType: "text/plain"

}

]

};

});

// Udostępnianie zawartości zasobu

server.setRequestHandler(ReadResourceRequestSchema, async (request) => {

if (request.params.uri === "file:///logs/app.log") {

const logContents = await readLogFile();

return {

contents: [{

uri: request.params.uri,

mimeType: "text/plain",

text: logContents

}]

};

}

throw new Error("Zasób nie znaleziony");

});

const server = new Server({ /* config */ }, { capabilities: { tools: {} } });

// Listowanie dostępnych narzędzi

server.setRequestHandler(ListToolsRequestSchema, async () => {

return {

tools: [{

name: "calculate_sum",

description: "Dodaj do siebie dwie liczby",

inputSchema: {

type: "object",

properties: {

a: { type: "number", description: "Pierwsza liczba" },

b: { type: "number", description: "Druga liczba" }

},

required: ["a", "b"]

},

annotations: {

title: "Oblicz sumę",

readOnlyHint: true,

openWorldHint: false

}

}]

};

});

// Obsługa wykonania narzędzia

server.setRequestHandler(CallToolRequestSchema, async (request) => {

if (request.params.name === "calculate_sum") {

try {

const { a, b } = request.params.arguments;

if (typeof a !== 'number' || typeof b !== 'number') {

throw new Error("Nieprawidłowe dane wejściowe: 'a' i 'b' muszą być liczbami.");

}

const sum = a + b;

return {

content: [{ type: "text", text: String(sum) }]

};

} catch (error: any) {

return {

isError: true,

content: [{ type: "text", text: `Błąd podczas obliczania sumy: ${error.message}` }]

};

}

}

throw new Error("Narzędzie nie znalezione");

});

Zacznij budować zaawansowane systemy AI dzięki standaryzowanym integracjom, bezpiecznemu dostępowi do danych i elastycznemu połączeniu narzędzi z FlowHunt.

Agentowe AI redefiniuje automatyzację przepływów pracy dzięki Model Context Protocol (MCP), umożliwiając skalowalną, dynamiczną integrację agentów AI z różnorod...

Szybki przykład, jak stworzyć własny serwer MCP w Pythonie.

Dowiedz się, jak Model Context Protocol (MCP) umożliwia bezpieczne operacje na systemie plików dla asystentów AI i narzędzi deweloperskich. Ten kompleksowy prze...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.