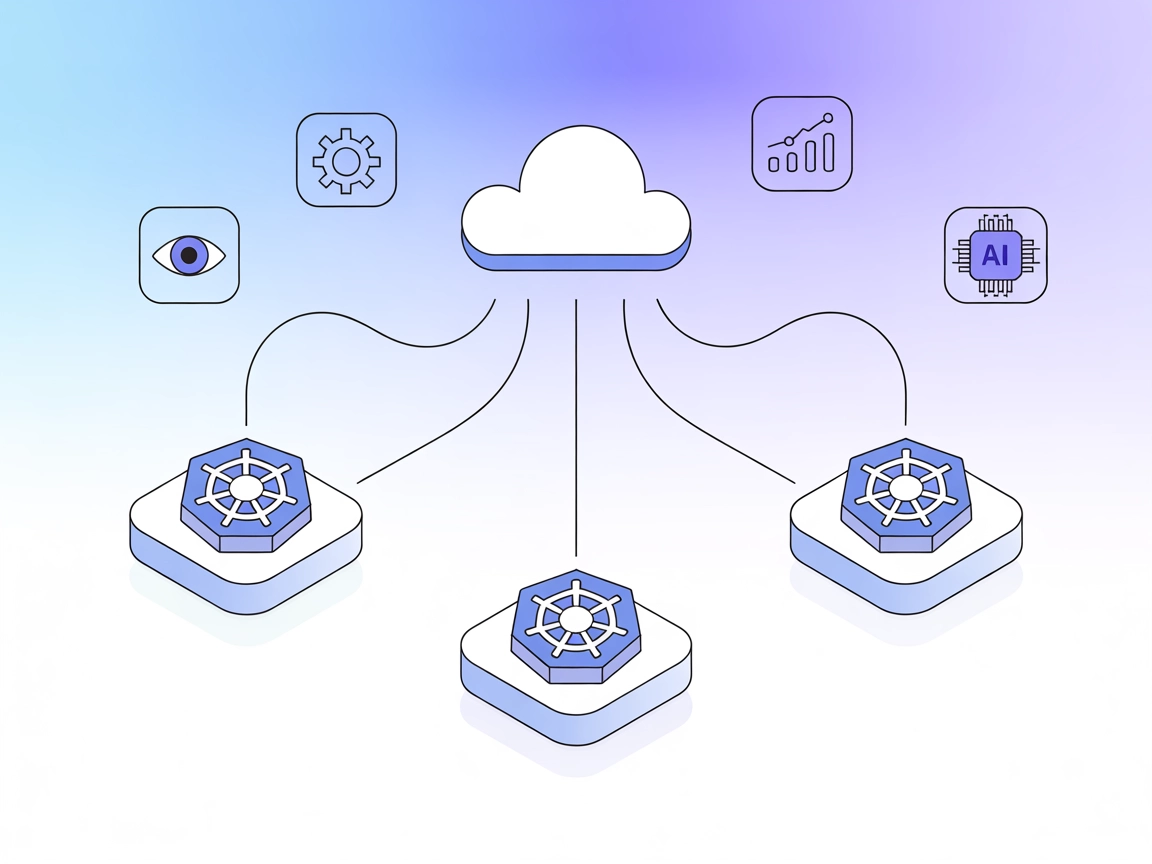

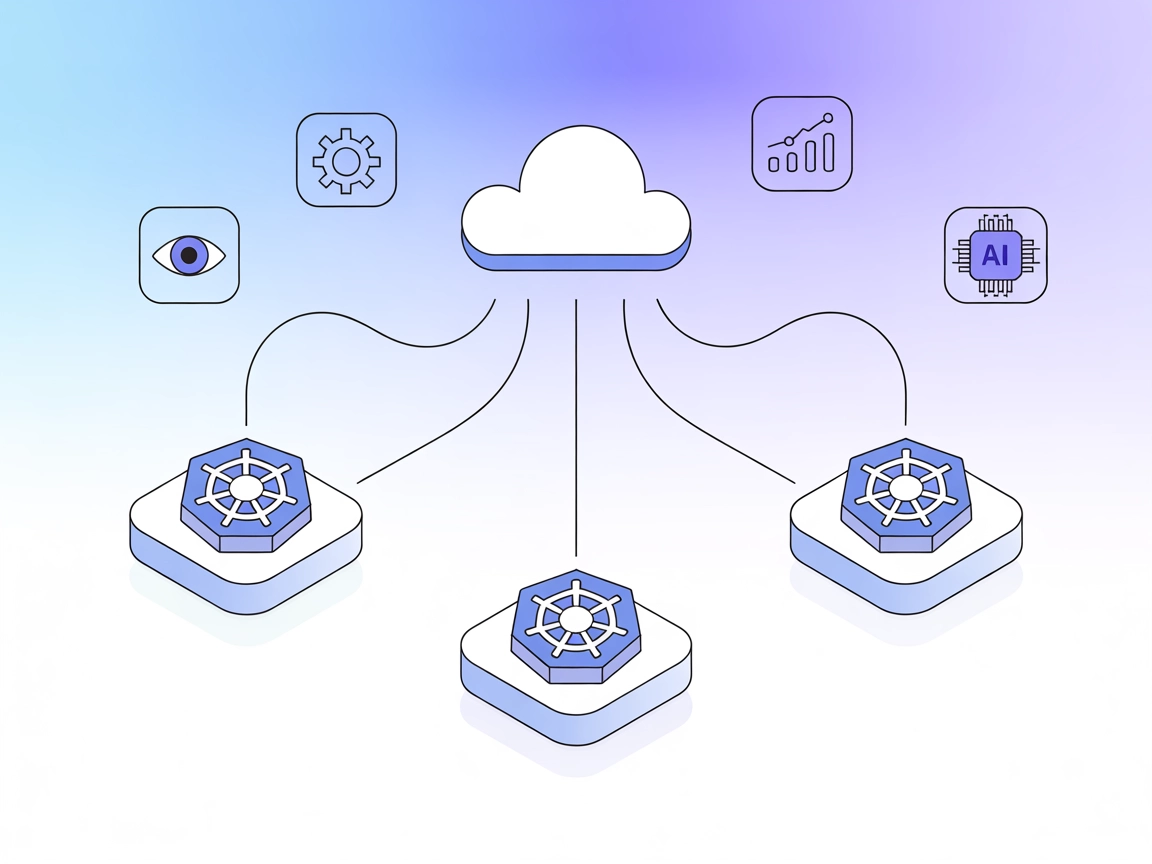

Multicluster MCP Server

Der Multicluster MCP Server ermöglicht GenAI-Systemen und Entwickler-Tools die Verwaltung, Überwachung und Orchestrierung von Ressourcen über mehrere Kubernetes...

Mit dem Multi-Model Advisor MCP Server von FlowHunt können Ihre KI-Agenten mehrere Ollama-Modelle gleichzeitig konsultieren und deren Ergebnisse für umfassendere Antworten und fortschrittliche kollaborative Entscheidungsfindung kombinieren.

FlowHunt bietet eine zusätzliche Sicherheitsschicht zwischen Ihren internen Systemen und KI-Tools und gibt Ihnen granulare Kontrolle darüber, welche Tools von Ihren MCP-Servern aus zugänglich sind. In unserer Infrastruktur gehostete MCP-Server können nahtlos mit FlowHunts Chatbot sowie beliebten KI-Plattformen wie ChatGPT, Claude und verschiedenen KI-Editoren integriert werden.

Der Multi-Model Advisor MCP Server ist ein Model Context Protocol (MCP) Server, der KI-Assistenten mit mehreren lokalen Ollama-Modellen verbindet. So können sie mehrere Modelle gleichzeitig abfragen und deren Antworten kombinieren. Dieser Ansatz, auch als „Rat der Berater“ bezeichnet, ermöglicht es KI-Systemen wie Claude, verschiedene Standpunkte unterschiedlicher Modelle zu synthetisieren und dadurch umfassendere und nuanciertere Antworten auf Benutzeranfragen zu liefern. Der Server unterstützt die Zuweisung unterschiedlicher Rollen oder Personas pro Modell, das Anpassen von System-Prompts und integriert sich nahtlos in Umgebungen wie Claude for Desktop. Er verbessert Entwickler-Workflows, indem er Aufgaben wie die Aggregation von Modellmeinungen, die Unterstützung fortschrittlicher Entscheidungsfindung sowie die Bereitstellung reichhaltiger Kontextinformationen aus mehreren KI-Quellen erleichtert.

server.py, und auch in README oder Dateibaum sind keine Tool-Interfaces explizit dokumentiert.mcpServers ein:{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

npx -y @smithery/cli install @YuChenSSR/multi-ai-advisor-mcp --client claude

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

API-Schlüssel sichern

Um API-Schlüssel oder sensible Umgebungsvariablen zu schützen, verwenden Sie das env-Feld in Ihrer Konfiguration:

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

}

}

}

Setzen Sie Umgebungsvariablen in Ihrem Betriebssystem oder in Ihrer CI/CD-Pipeline, um das Festschreiben von Geheimnissen zu vermeiden.

Verwendung von MCP in FlowHunt

Um MCP-Server in Ihren FlowHunt-Workflow zu integrieren, fügen Sie zunächst die MCP-Komponente zu Ihrem Flow hinzu und verbinden Sie diese mit Ihrem KI-Agenten:

Klicken Sie auf die MCP-Komponente, um das Konfigurationspanel zu öffnen. Tragen Sie im Bereich System-MCP-Konfiguration Ihre MCP-Serverdetails in folgendem JSON-Format ein:

{

"multi-ai-advisor-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Nach der Konfiguration kann der KI-Agent dieses MCP als Tool nutzen und erhält Zugriff auf alle Funktionen. Denken Sie daran, “multi-ai-advisor-mcp” durch den tatsächlichen Namen Ihres MCP-Servers zu ersetzen und die URL durch Ihre eigene MCP-Server-URL auszutauschen.

| Abschnitt | Verfügbarkeit | Details/Anmerkungen |

|---|---|---|

| Übersicht | ✅ | README.md, Homepage |

| Liste der Prompts | ⛔ | Keine Prompt-Vorlagen gefunden |

| Liste der Ressourcen | ⛔ | Keine expliziten Ressourcen gelistet |

| Liste der Tools | ⛔ | Keine Tool-Liste im Code oder in den Docs |

| API-Schlüssel sichern | ✅ | .env & JSON-Konfigurationsbeispiele |

| Sampling-Unterstützung (weniger relevant) | ⛔ | Nicht erwähnt |

Der Multi-Model Advisor MCP ist für die Einrichtung gut dokumentiert und bietet einen einzigartigen „Rat der Berater“-Ansatz, es fehlt aber an Transparenz bezüglich Prompts, Ressourcen und Tools. Der Nutzen ist für Multi-Model-Entscheidungs-Workflows hoch, mehr technische Details wären jedoch wünschenswert. Ich würde diese MCP mit 6/10 bewerten, da sie die Grundlagen abdeckt und einen überzeugenden Anwendungsfall bietet, aber hinsichtlich technischer Dokumentation noch Luft nach oben besteht.

| Hat eine LICENSE | ✅ (MIT) |

|---|---|

| Mindestens ein Tool | ⛔ |

| Anzahl der Forks | 15 |

| Anzahl der Stars | 49 |

Entfesseln Sie die Kraft eines KI-Beratergremiums. Aggregieren Sie Perspektiven mehrerer Modelle und steigern Sie Ihren Workflow mit umfassenderen Einblicken durch FlowHunts Multi-Model Advisor MCP.

Der Multicluster MCP Server ermöglicht GenAI-Systemen und Entwickler-Tools die Verwaltung, Überwachung und Orchestrierung von Ressourcen über mehrere Kubernetes...

Der Model Context Protocol (MCP) Server verbindet KI-Assistenten mit externen Datenquellen, APIs und Diensten und ermöglicht so eine optimierte Integration komp...

Erfahren Sie, was MCP (Model Context Protocol) Server sind, wie sie funktionieren und warum sie die AI-Integration revolutionieren. Entdecken Sie, wie MCP die V...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.