Conselheiro Multi-Modelo

Aproveite o Multi-Model Advisor do FlowHunt para unificar fluxos de trabalho com IA, consultando vários modelos Ollama simultaneamente, atribuindo personas pers...

Automação de IA

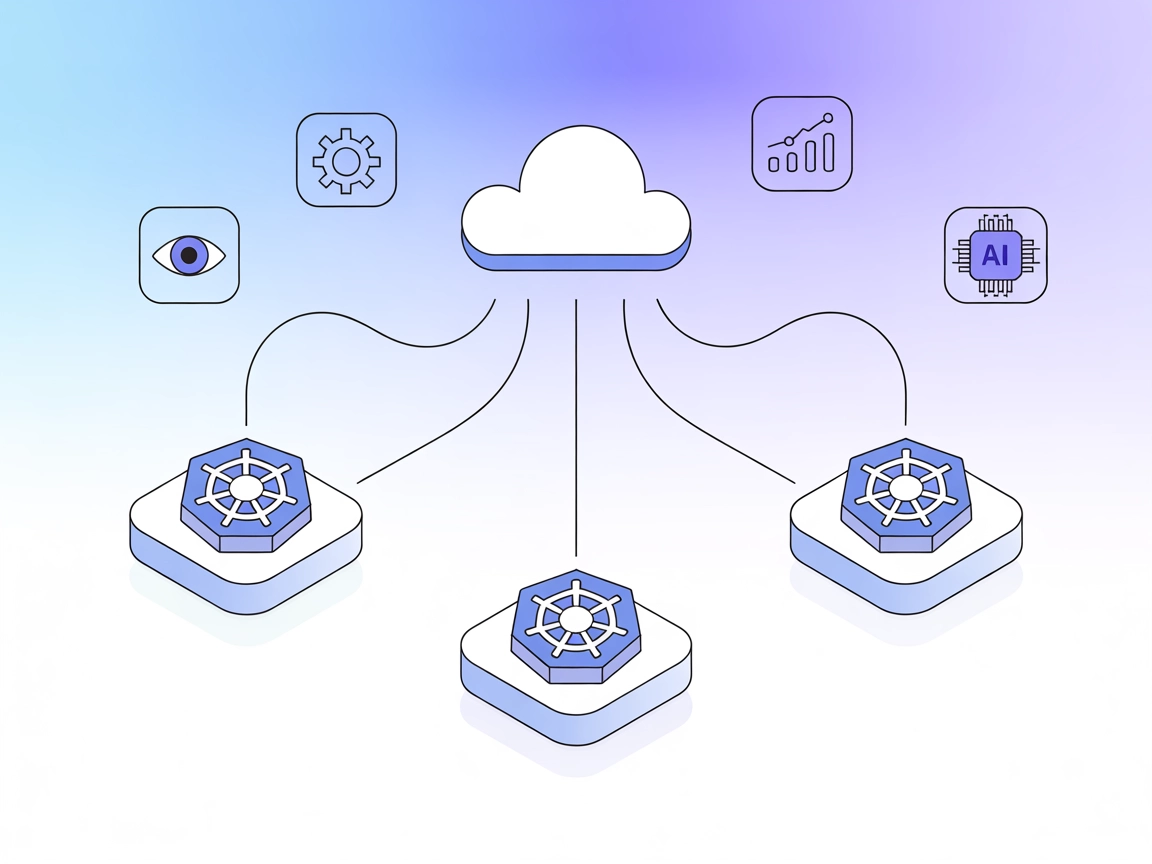

O Servidor MCP Multi-Model Advisor do FlowHunt permite que seus agentes de IA consultem vários modelos Ollama ao mesmo tempo, combinando suas saídas para respostas mais abrangentes e decisões colaborativas avançadas.

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Servidor MCP Multi-Model Advisor é um servidor de Model Context Protocol (MCP) projetado para conectar assistentes de IA a vários modelos locais do Ollama, permitindo que consultem múltiplos modelos simultaneamente e combinem suas respostas. Essa abordagem, descrita como um “conselho de consultores”, possibilita que sistemas de IA como o Claude sintetizem diferentes pontos de vista de diversos modelos, resultando em respostas mais completas e detalhadas para as perguntas dos usuários. O servidor permite atribuir diferentes papéis ou personas para cada modelo, personalizar prompts do sistema e integra-se perfeitamente com ambientes como Claude Desktop. Ele aprimora o fluxo de trabalho de desenvolvimento ao facilitar tarefas como agregação de opiniões de modelos, apoio à tomada de decisões avançadas e fornecimento de informações contextuais mais ricas de múltiplas fontes de IA.

server.py ou arquivo similar, nem interfaces de ferramentas estão explicitamente documentadas no README ou na árvore de arquivos visível.mcpServers:{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

npx -y @smithery/cli install @YuChenSSR/multi-ai-advisor-mcp --client claude

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

Protegendo Chaves de API

Para proteger chaves de API ou variáveis de ambiente sensíveis, use o campo env na sua configuração:

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

}

}

}

Defina as variáveis de ambiente no seu sistema operacional ou pipeline CI/CD para evitar expor segredos no código.

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo de trabalho no FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração MCP do sistema, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"multi-ai-advisor-mcp": {

"transport": "streamable_http",

"url": "https://seudomcpserver.exemplo/caminhoparamcp/url"

}

}

Depois de configurado, o agente de IA poderá usar este MCP como uma ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de alterar “multi-ai-advisor-mcp” para o nome real do seu servidor MCP e atualizar a URL pelo endereço do seu próprio MCP.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão Geral | ✅ | README.md, página inicial |

| Lista de Prompts | ⛔ | Nenhum template de prompt encontrado |

| Lista de Recursos | ⛔ | Nenhum recurso explícito listado |

| Lista de Ferramentas | ⛔ | Nenhuma lista de ferramentas em código ou docs |

| Proteção de Chaves de API | ✅ | Exemplos de .env & configuração JSON |

| Suporte a Amostragem (menos relevante) | ⛔ | Não mencionado |

O Multi-Model Advisor MCP é bem documentado para configuração e oferece uma abordagem única de “conselho de consultores”, mas carece de transparência quanto a prompts, recursos e ferramentas. Seu valor é alto para fluxos de decisão multi-modelo, embora mais detalhes técnicos o tornariam melhor. Eu avaliaria este MCP com nota 6/10 com base nas duas tabelas, pois cobre o essencial e oferece um caso de uso interessante, mas falta profundidade na documentação técnica.

| Tem uma LICENSE | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ⛔ |

| Número de Forks | 15 |

| Número de Stars | 49 |

Liberte o poder de um conselho de consultores de IA. Agregue perspectivas de múltiplos modelos e otimize seu fluxo de trabalho com insights mais ricos usando o Multi-Model Advisor MCP do FlowHunt.

Aproveite o Multi-Model Advisor do FlowHunt para unificar fluxos de trabalho com IA, consultando vários modelos Ollama simultaneamente, atribuindo personas pers...

O Servidor MCP Multicluster capacita sistemas GenAI e ferramentas de desenvolvimento a gerenciar, monitorar e orquestrar recursos em múltiplos clusters Kubernet...

Descubra o que são servidores MCP (Model Context Protocol), como funcionam e por que estão revolucionando a integração de IA. Veja como o MCP simplifica a conex...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.