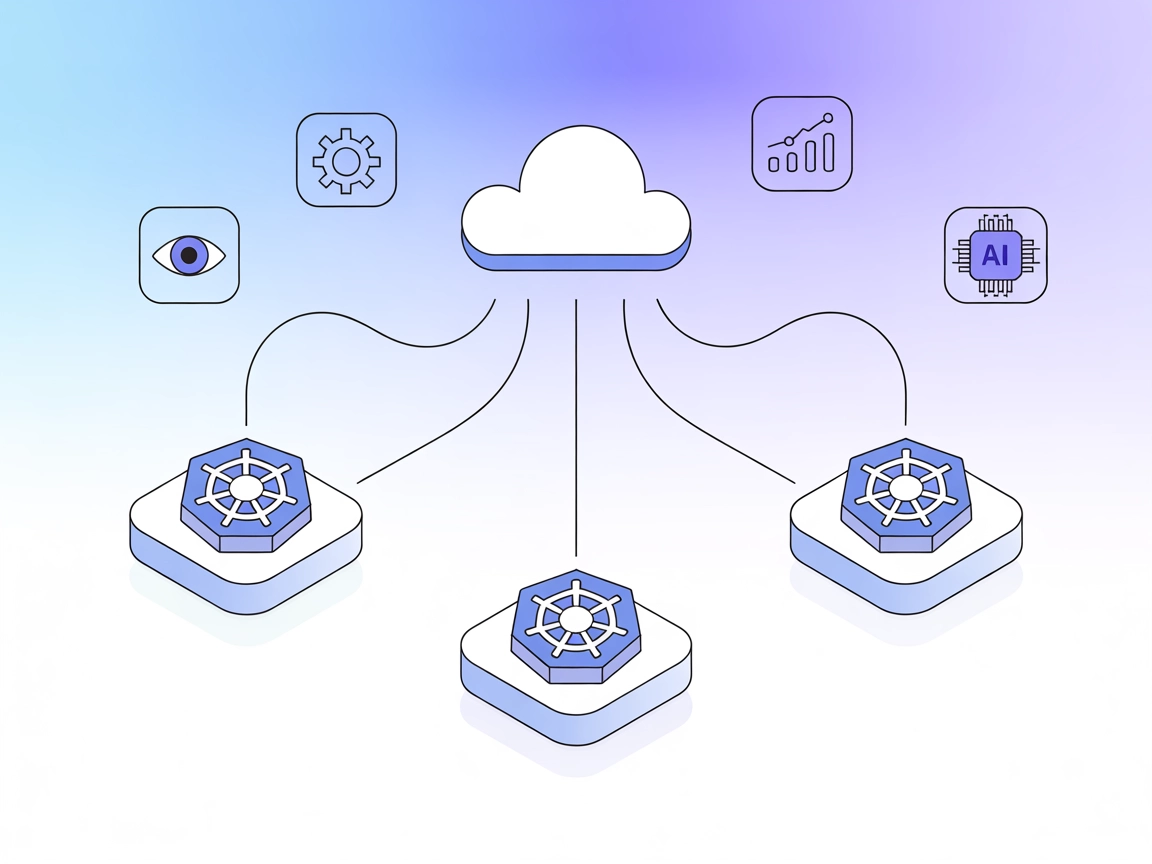

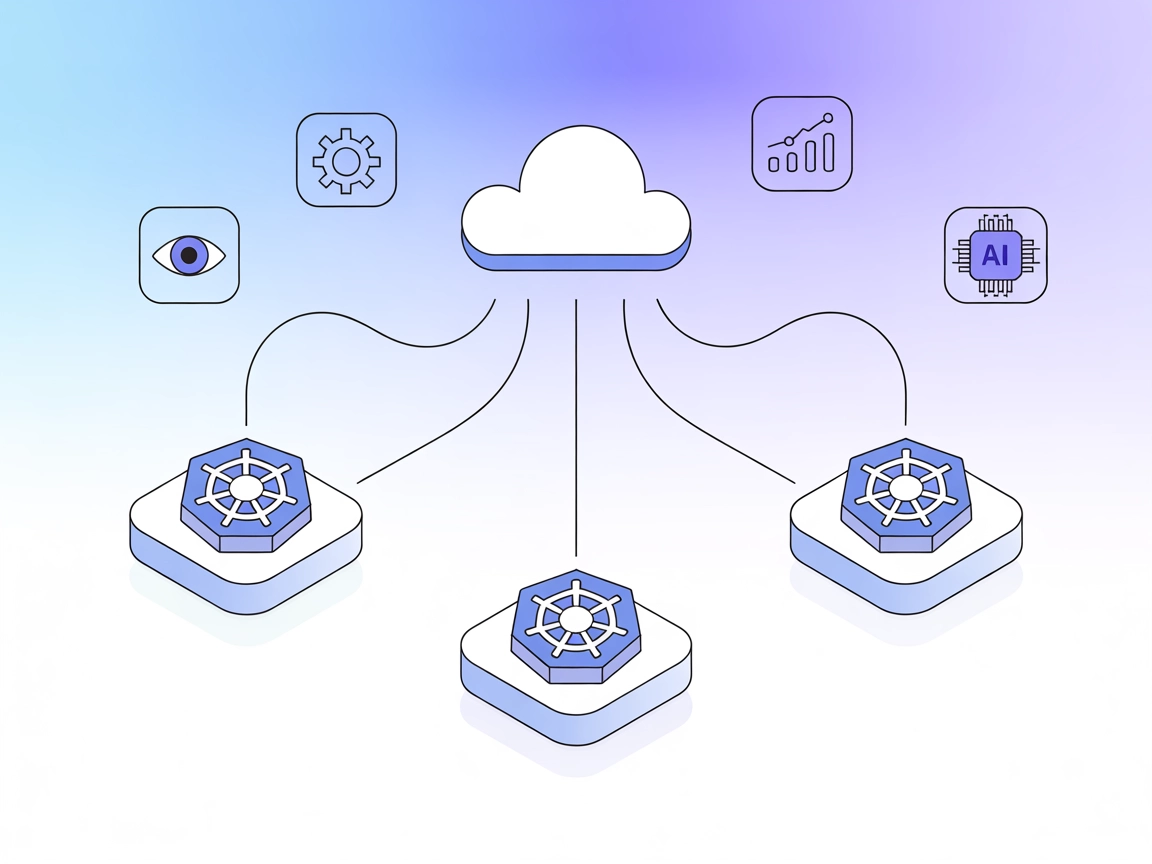

Multicluster MCP Server

De Multicluster MCP Server stelt GenAI-systemen en ontwikkelaarstools in staat om resources te beheren, monitoren en orkestreren over meerdere Kubernetes-cluste...

FlowHunt’s Multi-Model Advisor MCP Server laat je AI-agenten meerdere Ollama-modellen tegelijk raadplegen, waarbij hun uitkomsten worden gecombineerd voor meer volledige antwoorden en geavanceerde, collaboratieve besluitvorming.

FlowHunt biedt een extra beveiligingslaag tussen uw interne systemen en AI-tools, waardoor u granulaire controle heeft over welke tools toegankelijk zijn vanaf uw MCP-servers. MCP-servers die in onze infrastructuur worden gehost, kunnen naadloos worden geïntegreerd met FlowHunt's chatbot evenals populaire AI-platforms zoals ChatGPT, Claude en verschillende AI-editors.

De Multi-Model Advisor MCP Server is een Model Context Protocol (MCP) server die is ontworpen om AI-assistenten te verbinden met meerdere lokale Ollama-modellen, zodat ze verschillende modellen gelijktijdig kunnen bevragen en hun antwoorden kunnen combineren. Deze aanpak, omschreven als een “raad van adviseurs”, stelt AI-systemen zoals Claude in staat om diverse gezichtspunten van verschillende modellen te synthetiseren, wat resulteert in meer volledige en genuanceerde antwoorden op gebruikersvragen. De server ondersteunt het toewijzen van verschillende rollen of persona’s aan elk model, het aanpassen van systeemopdrachten, en integreert naadloos met omgevingen zoals Claude voor Desktop. Het verbetert ontwikkelaarsworkflows door taken mogelijk te maken zoals het samenbrengen van modelopinies, het ondersteunen van geavanceerde besluitvorming en het bieden van rijkere contextuele informatie uit meerdere AI-bronnen.

server.py of vergelijkbaar bestand, noch zijn tool-interfaces expliciet gedocumenteerd in de README of zichtbare bestandsstructuur.mcpServers sectie:{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

npx -y @smithery/cli install @YuChenSSR/multi-ai-advisor-mcp --client claude

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

API-sleutels beveiligen

Om API-sleutels of gevoelige omgevingsvariabelen te beveiligen, gebruik je het veld env in je configuratie:

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

}

}

}

Stel omgevingsvariabelen in op je besturingssysteem of CI/CD-pijplijn om het hardcoden van geheimen te voorkomen.

MCP gebruiken in FlowHunt

Om MCP-servers te integreren in je FlowHunt-workflow, begin je met het toevoegen van het MCP-component aan je flow en verbind je deze met je AI-agent:

Klik op het MCP-component om het configuratiepaneel te openen. In het systeem MCP-configuratiegedeelte voeg je je MCP-servergegevens toe met dit JSON-formaat:

{

"multi-ai-advisor-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Na configuratie kan de AI-agent deze MCP nu als tool gebruiken met toegang tot alle functies en mogelijkheden. Vergeet niet om “multi-ai-advisor-mcp” te wijzigen naar de daadwerkelijke naam van je MCP-server en de URL te vervangen door je eigen MCP-server-URL.

| Sectie | Beschikbaarheid | Details/Opmerkingen |

|---|---|---|

| Overzicht | ✅ | README.md, homepage |

| Lijst van Prompts | ⛔ | Geen prompt-sjablonen gevonden |

| Lijst van Resources | ⛔ | Geen expliciete resources vermeld |

| Lijst van Tools | ⛔ | Geen tools-lijst gevonden in code of documentatie |

| API-sleutels beveiligen | ✅ | .env & JSON-configuratievoorbeelden |

| Sampling-ondersteuning (minder belangrijk) | ⛔ | Niet vermeld |

De Multi-Model Advisor MCP is goed gedocumenteerd voor installatie en biedt een unieke “raad van adviseurs”-aanpak, maar mist transparantie over prompts, resources en tools. De waarde is hoog voor multi-model besluitvormingsworkflows, hoewel meer technische details het zou verbeteren. Ik geef deze MCP een 6/10 op basis van de twee tabellen, omdat het de basis dekt en een overtuigend gebruiksdoel biedt, maar diepgang in technische documentatie mist.

| Heeft een LICENSE | ✅ (MIT) |

|---|---|

| Heeft minstens één tool | ⛔ |

| Aantal Forks | 15 |

| Aantal Stars | 49 |

Ontgrendel de kracht van een raad van AI-adviseurs. Verzamel perspectieven van meerdere modellen en verbeter je workflow met rijkere inzichten met FlowHunt's Multi-Model Advisor MCP.

De Multicluster MCP Server stelt GenAI-systemen en ontwikkelaarstools in staat om resources te beheren, monitoren en orkestreren over meerdere Kubernetes-cluste...

Leer hoe je een Model Context Protocol (MCP) server bouwt en implementeert om AI-modellen te verbinden met externe tools en databronnen. Stapsgewijze handleidin...

De Replicate MCP Server-connector van FlowHunt biedt naadloze toegang tot Replicate's uitgebreide AI-modelhub, waarmee ontwikkelaars direct binnen hun workflows...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.