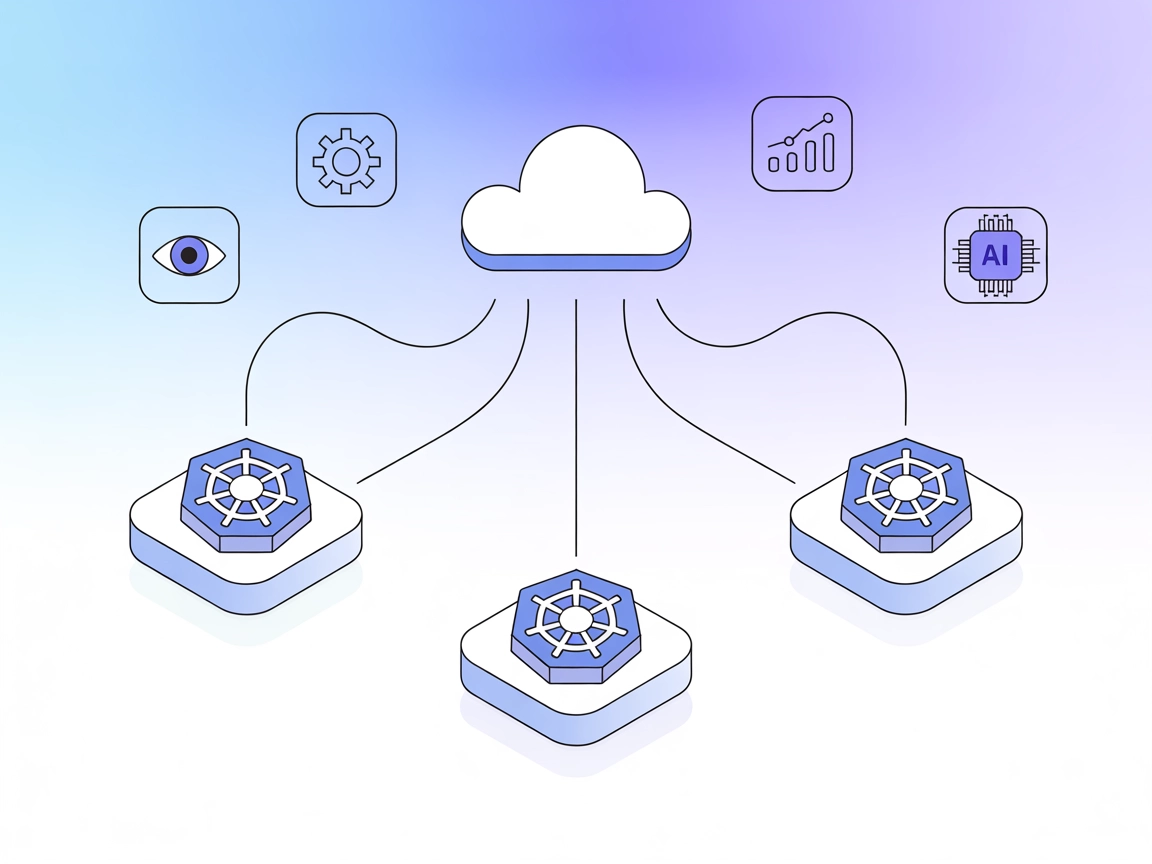

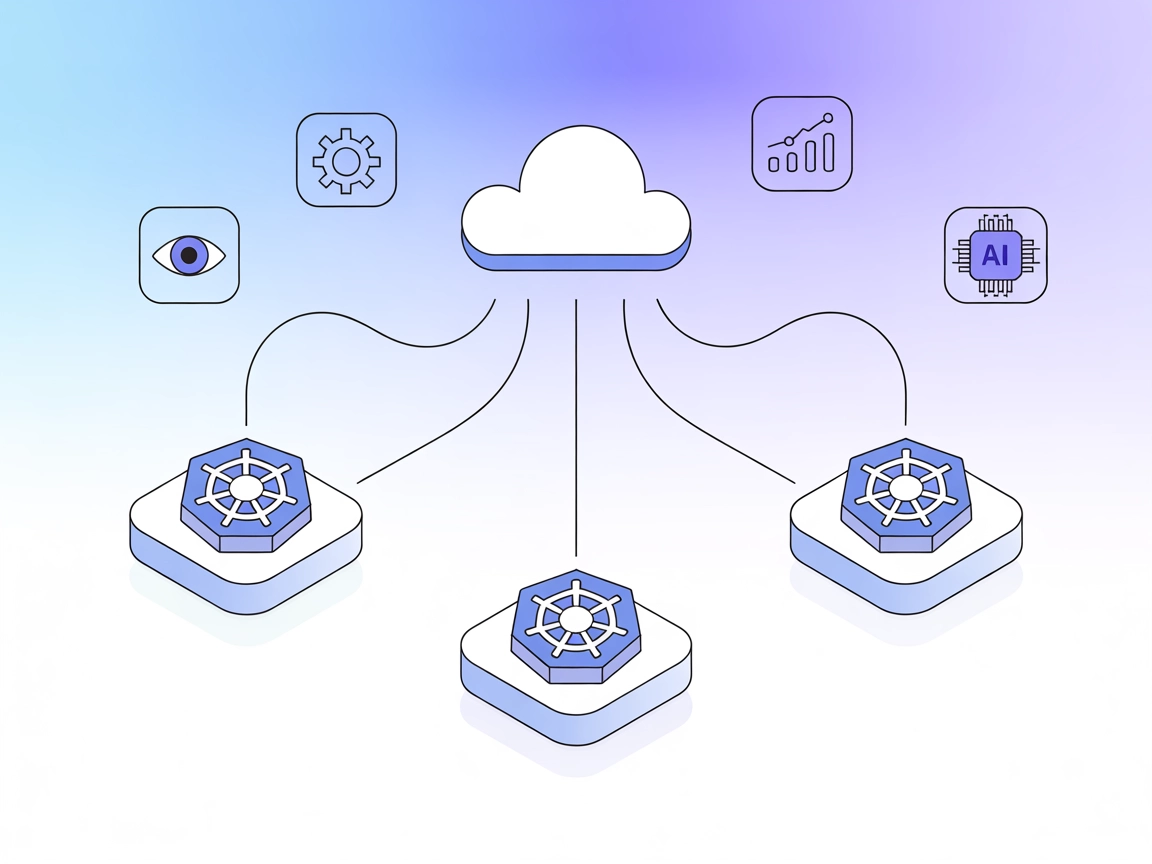

Serveur MCP Multicluster

Le Serveur MCP Multicluster permet aux systèmes GenAI et aux outils de développement de gérer, surveiller et orchestrer des ressources à travers plusieurs clust...

Le serveur MCP Multi-Model Advisor de FlowHunt permet à vos agents IA de consulter plusieurs modèles Ollama en même temps, en combinant leurs sorties pour des réponses plus complètes et une prise de décision collaborative avancée.

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

Le serveur MCP Multi-Model Advisor est un serveur Model Context Protocol (MCP) conçu pour connecter des assistants IA à plusieurs modèles Ollama locaux, leur permettant d’interroger plusieurs modèles simultanément et de combiner leurs réponses. Cette approche, décrite comme un « conseil d’experts », permet aux systèmes IA comme Claude de synthétiser des points de vue divers issus de différents modèles, aboutissant à des réponses plus complètes et nuancées aux requêtes des utilisateurs. Le serveur permet d’attribuer différents rôles ou personas à chaque modèle, de personnaliser les prompts système et s’intègre parfaitement à des environnements comme Claude for Desktop. Il améliore les workflows de développement en facilitant des tâches telles que l’agrégation d’opinions de modèles, la prise de décision avancée et la fourniture d’informations contextuelles plus riches issues de multiples sources IA.

server.py ou un fichier similaire, ni d’interfaces d’outils explicitement documentées dans le README ou l’arborescence visible des fichiers.mcpServers :{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

npx -y @smithery/cli install @YuChenSSR/multi-ai-advisor-mcp --client claude

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

Sécurisation des clés API

Pour sécuriser les clés API ou variables d’environnement sensibles, utilisez le champ env dans votre configuration :

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

}

}

}

Définissez les variables d’environnement dans votre OS ou votre pipeline CI/CD afin d’éviter d’intégrer les secrets en dur.

Utiliser le MCP dans FlowHunt

Pour intégrer des serveurs MCP dans votre workflow FlowHunt, commencez par ajouter le composant MCP à votre flow et connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section configuration système MCP, insérez les détails de votre serveur MCP en utilisant ce format JSON :

{

"multi-ai-advisor-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Une fois configuré, l’agent IA pourra utiliser ce MCP comme outil, avec accès à toutes ses fonctions et capacités. N’oubliez pas de remplacer “multi-ai-advisor-mcp” par le nom réel de votre serveur MCP et l’URL par celle de votre propre serveur MCP.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Vue d’ensemble | ✅ | README.md, page d’accueil |

| Liste des prompts | ⛔ | Aucun modèle de prompt trouvé |

| Liste des ressources | ⛔ | Aucune ressource explicite listée |

| Liste des outils | ⛔ | Aucune liste d’outils trouvée dans le code/docs |

| Sécurisation des clés API | ✅ | Exemples .env & config JSON |

| Support de l’échantillonnage (peu important) | ⛔ | Non mentionné |

Le Multi-Model Advisor MCP est bien documenté pour l’installation et propose une approche unique de « conseil d’experts », mais manque de transparence sur les prompts, ressources et outils. Sa valeur est élevée pour des workflows de décision multi-modèles, bien qu’un niveau de détail technique plus poussé l’améliorerait. Je noterais ce MCP à 6/10 sur la base des deux tableaux, car il couvre les bases et offre un cas d’usage convaincant, mais manque de profondeur dans la documentation technique.

| Dispose d’une LICENCE | ✅ (MIT) |

|---|---|

| Au moins un outil | ⛔ |

| Nombre de forks | 15 |

| Nombre d’étoiles | 49 |

Libérez la puissance d’un conseil d’experts IA. Agrégez les perspectives de plusieurs modèles et améliorez votre workflow grâce à des analyses plus riches avec le Multi-Model Advisor MCP de FlowHunt.

Le Serveur MCP Multicluster permet aux systèmes GenAI et aux outils de développement de gérer, surveiller et orchestrer des ressources à travers plusieurs clust...

Le serveur Model Context Protocol (MCP) fait le lien entre les assistants IA et des sources de données externes, des API et des services, permettant une intégra...

Découvrez ce que sont les serveurs MCP (Model Context Protocol), comment ils fonctionnent et pourquoi ils révolutionnent l'intégration de l'IA. Découvrez commen...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.