Model Context Protocol (MCP) -palvelin

Model Context Protocol (MCP) -palvelin yhdistää tekoälyavustajat ulkoisiin tietolähteisiin, API-rajapintoihin ja palveluihin, mahdollistaen sujuvan monimutkaist...

FlowHuntin Multi-Model Advisor MCP -palvelin antaa tekoälyagenttiesi kuulla useita Ollama-malleja kerralla, yhdistäen niiden tuotokset kattavampiin vastauksiin ja edistyneeseen yhteistoiminnalliseen päätöksentekoon.

FlowHunt tarjoaa lisäturvallisuuskerroksen sisäisten järjestelmiesi ja tekoälytyökalujen väliin, antaen sinulle yksityiskohtaisen hallinnan siitä, mitkä työkalut ovat käytettävissä MCP-palvelimistasi. Infrastruktuurissamme isännöidyt MCP-palvelimet voidaan integroida saumattomasti FlowHuntin chatbotin sekä suosittujen tekoälyalustojen kuten ChatGPT:n, Clauden ja erilaisten tekoälyeditoreiden kanssa.

Multi-Model Advisor MCP -palvelin on Model Context Protocol (MCP) -palvelin, joka yhdistää tekoälyapulaiset useisiin paikallisiin Ollama-malleihin mahdollistaen useiden mallien yhtäaikaisen kyselyn ja vastausten yhdistelyn. Tätä lähestymistapaa kutsutaan usein “neuvonantajaneuvostoksi”, ja se mahdollistaa esimerkiksi Clauden kaltaisille AI-järjestelmille erilaisten näkökulmien synteesin useista malleista, mikä johtaa kattavampiin ja vivahteikkaampiin vastauksiin käyttäjän kysymyksiin. Palvelin tukee myös eri roolien tai persoonien määrittelyä jokaiselle mallille, järjestelmäkehotteiden räätälöintiä ja integroituu saumattomasti esimerkiksi Claude for Desktop -ympäristöihin. Palvelin parantaa kehittäjätyönkulkua mahdollistamalla mm. mallien mielipiteiden yhdistelyn, tukemalla edistynyttä päätöksentekoa ja tarjoamalla laajempaa kontekstuaalista tietoa useista AI-lähteistä.

server.py-tiedostossa, eikä työkalurajapintoja ole dokumentoitu README:ssä tai tiedostorakenteessa.mcpServers-osioon:{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

npx -y @smithery/cli install @YuChenSSR/multi-ai-advisor-mcp --client claude

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434"

}

}

}

API-avainten suojaaminen

Suojataksesi API-avaimet tai muut arkaluonteiset ympäristömuuttujat, käytä env-kenttää konfiguraatiossasi:

{

"multi-ai-advisor-mcp": {

"command": "npx",

"args": ["@YuChenSSR/multi-ai-advisor-mcp@latest"],

"env": {

"OLLAMA_HOST": "http://localhost:11434",

"MY_SECRET_API_KEY": "${MY_SECRET_API_KEY}"

}

}

}

Aseta ympäristömuuttujat käyttöjärjestelmään tai CI/CD-putkeen, älä kovakoodaa salaisuuksia.

MCP:n käyttö FlowHuntissa

Jos haluat liittää MCP-palvelimia FlowHunt-työnkulkuusi, lisää ensin MCP-komponentti työnkulkuun ja yhdistä se tekoälyagenttiin:

Napsauta MCP-komponenttia avataksesi asetuspaneelin. Järjestelmän MCP-konfiguraatio-osioon syötä MCP-palvelimesi tiedot seuraavassa JSON-muodossa:

{

"multi-ai-advisor-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Kun olet konfiguroinut palvelimen, tekoälyagentti voi käyttää MCP:tä työkaluna, jolla on pääsy kaikkiin sen ominaisuuksiin. Muista vaihtaa “multi-ai-advisor-mcp” MCP-palvelimesi todelliseen nimeen ja korvata URL omalla MCP-palvelimesi osoitteella.

| Osio | Saatavuus | Lisätiedot/Huomiot |

|---|---|---|

| Yleiskatsaus | ✅ | README.md, kotisivu |

| Kehotepohjalista | ⛔ | Kehotepohjia ei löytynyt |

| Resurssilista | ⛔ | Erillisiä resursseja ei mainittu |

| Työkalulista | ⛔ | Työkaluja ei löytynyt koodista tai dokumenteista |

| API-avainten suojaus | ✅ | .env & JSON-konfiguraatioesimerkit |

| Näytteenotto (ei arvioinnissa tärkein) | ⛔ | Ei mainittu |

Multi-Model Advisor MCP on hyvin dokumentoitu asennuksen osalta ja tarjoaa ainutlaatuisen “neuvonantajaneuvosto”-lähestymistavan, mutta läpinäkyvyys kehotteiden, resurssien ja työkalujen suhteen puuttuu. Sen arvo on suuri monimallisten päätöstyönkulkujen kannalta, mutta tekninen yksityiskohtaisuus voisi olla parempaa. Arvioisin tämän MCP:n arvosanaksi 6/10 yllä olevien taulukoiden perusteella: se kattaa perusasiat ja tarjoaa kiinnostavan käyttötapauksen, mutta syvyyttä tekniseen dokumentaatioon kaipaisi lisää.

| Onko LICENSE | ✅ (MIT) |

|---|---|

| Onko vähintään yksi työkalu | ⛔ |

| Forkkien määrä | 15 |

| Tähtien määrä | 49 |

Vapauta tekoälyneuvonantajien neuvoston voima. Yhdistä näkökulmia useista malleista ja tehosta työnkulkuasi syvemmillä oivalluksilla FlowHuntin Multi-Model Advisor MCP:n avulla.

Model Context Protocol (MCP) -palvelin yhdistää tekoälyavustajat ulkoisiin tietolähteisiin, API-rajapintoihin ja palveluihin, mahdollistaen sujuvan monimutkaist...

Opi rakentamaan ja ottamaan käyttöön Model Context Protocol (MCP) -palvelin, jolla yhdistät tekoälymallit ulkoisiin työkaluihin ja tietolähteisiin. Vaiheittaine...

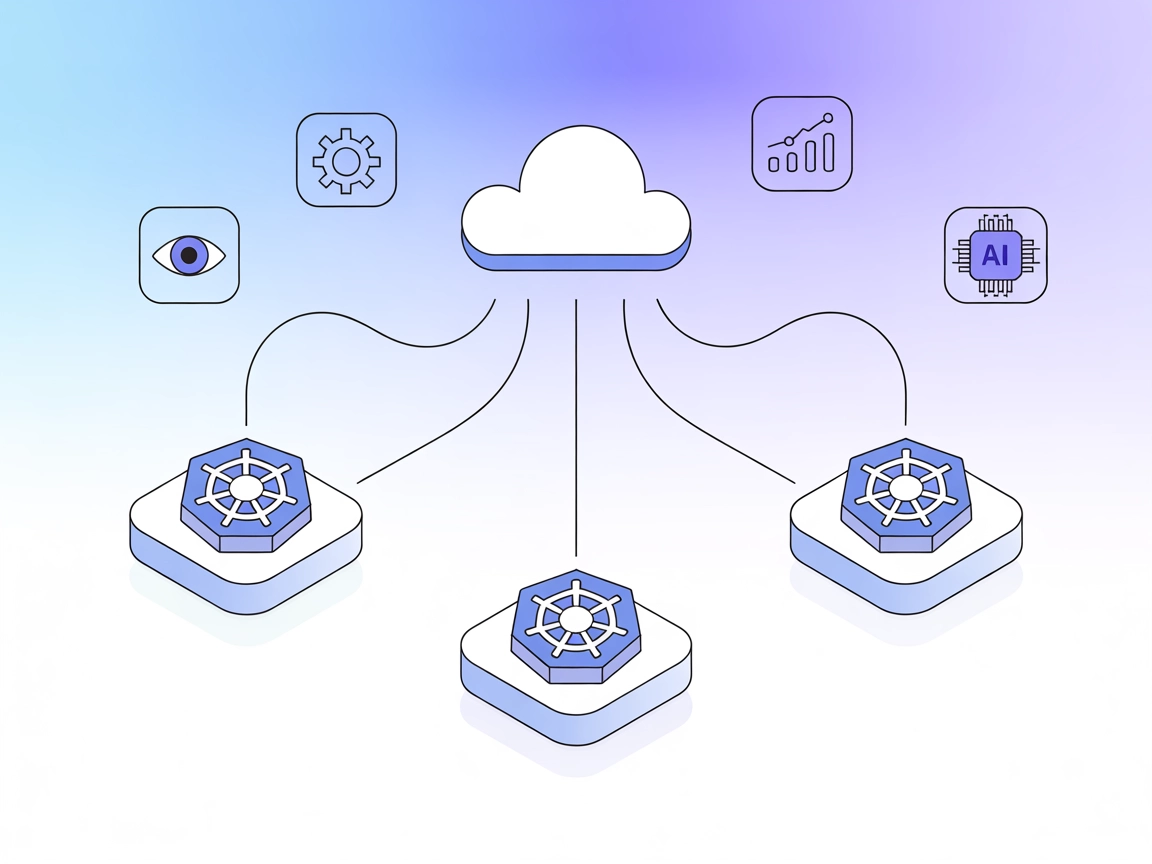

Multicluster MCP -palvelin mahdollistaa GenAI-järjestelmien ja kehittäjätyökalujen resurssien hallinnan, valvonnan ja orkestroinnin useissa Kubernetes-klusterei...

Evästeiden Suostumus

Käytämme evästeitä parantaaksemme selauskokemustasi ja analysoidaksemme liikennettämme. See our privacy policy.