Integración del Servidor MCP de Upstash

El Servidor MCP de Upstash permite a asistentes y agentes de IA gestionar bases de datos en la nube de Upstash de forma sencilla, utilizando lenguaje natural o ...

Conecta fácilmente tus agentes de IA a los feature flags de Unleash con el Servidor MCP de Unleash para toma de decisiones automatizada, gestión de flags y una integración ágil de proyectos.

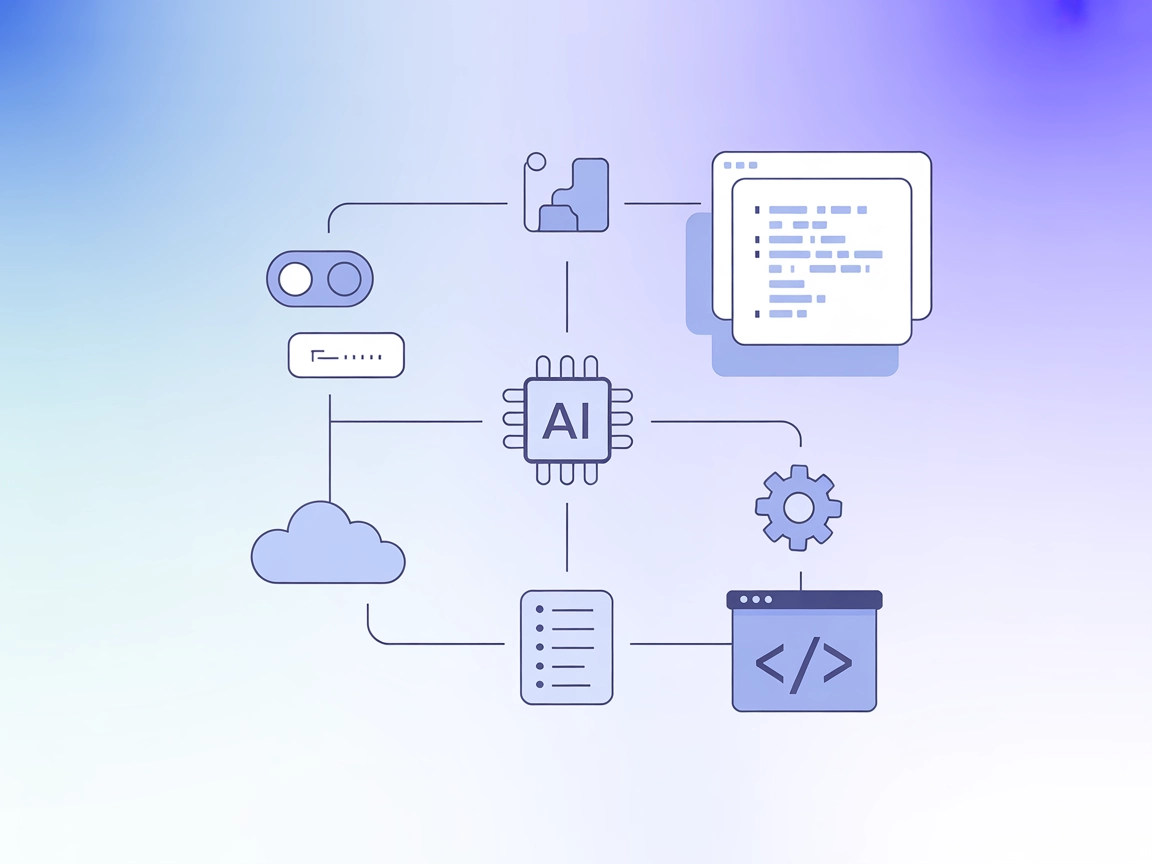

FlowHunt proporciona una capa de seguridad adicional entre tus sistemas internos y las herramientas de IA, dándote control granular sobre qué herramientas son accesibles desde tus servidores MCP. Los servidores MCP alojados en nuestra infraestructura pueden integrarse perfectamente con el chatbot de FlowHunt, así como con plataformas de IA populares como ChatGPT, Claude y varios editores de IA.

El Servidor MCP de Unleash es una implementación del Model Context Protocol (MCP) que conecta asistentes de IA y aplicaciones LLM con el sistema de Feature Toggle de Unleash. Actúa como un puente, permitiendo que los clientes de IA consulten el estado de los feature flags, enumeren proyectos y gestionen flags directamente desde Unleash mediante interfaces MCP estandarizadas. Esta integración permite a los desarrolladores automatizar la gestión de funcionalidades, exponer datos de feature flags a los agentes de IA para decisiones informadas y optimizar flujos de trabajo que dependen de la activación dinámica de funcionalidades en sistemas de software. Al proporcionar herramientas y recursos que interactúan con Unleash, el servidor potencia aplicaciones basadas en IA para mejorar los pipelines de desarrollo, ejecutar comprobaciones automatizadas y participar en operaciones de gestión de funcionalidades.

mcpServers usando el siguiente fragmento JSON:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Utiliza variables de entorno para almacenar información sensible:

{

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"],

"env": {

"UNLEASH_API_KEY": "${UNLEASH_API_KEY}"

},

"inputs": {

"apiUrl": "https://unleash.example.com/api"

}

}

}

}

mcpServers:"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

"mcpServers": {

"unleash-mcp": {

"command": "npx",

"args": ["@cuongtl1992/unleash-mcp@latest"]

}

}

Uso de MCP en FlowHunt

Para integrar servidores MCP en tu flujo de trabajo en FlowHunt, comienza añadiendo el componente MCP a tu flujo y conectándolo a tu agente de IA:

Haz clic en el componente MCP para abrir el panel de configuración. En la sección de configuración del sistema MCP, inserta los datos de tu servidor MCP usando este formato JSON:

{

"unleash-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una vez configurado, el agente de IA podrá usar este MCP como herramienta con acceso a todas sus funciones y capacidades. Recuerda cambiar "unleash-mcp" por el nombre real de tu servidor MCP y reemplazar la URL según corresponda.

| Sección | Disponibilidad | Detalles/Notas |

|---|---|---|

| Resumen | ✅ | Proporciona un resumen de la integración con Unleash y aplicaciones LLM |

| Lista de Prompts | ✅ | Plantilla de prompt flag-check |

| Lista de Recursos | ✅ | flags, projects |

| Lista de Herramientas | ✅ | get-flag, get-projects |

| Protección de claves API | ✅ | Ejemplo usando variables de entorno |

| Soporte de Sampling (menos relevante) | ⛔ | No mencionado |

El Servidor MCP de Unleash ofrece una integración clara y enfocada para la gestión de feature flags en flujos de trabajo con LLM. El repositorio cubre todos los primitivos MCP esenciales, brinda instrucciones prácticas de configuración y demuestra buenas prácticas de seguridad. Sin embargo, no se documentan explícitamente características avanzadas de MCP como sampling o roots. En general, es un servidor MCP sólido y especializado con un valor claro para desarrolladores.

| Tiene LICENSE | ✅ (MIT) |

|---|---|

| Tiene al menos una herramienta | ✅ |

| Número de Forks | 0 |

| Número de Stars | 8 |

El Servidor MCP de Unleash es una implementación del Model Context Protocol que conecta asistentes de IA y aplicaciones LLM con el sistema de Feature Toggle de Unleash, permitiendo la gestión automatizada de flags, descubrimiento de proyectos y exposición dinámica de funcionalidades.

Proporciona una plantilla de prompt `flag-check`, expone `flags` y `projects` como recursos MCP, y ofrece las herramientas `get-flag` y `get-projects` para interactuar con los datos de Unleash.

Sigue las instrucciones de configuración para tu plataforma (Windsurf, Claude, Cursor o Cline), asegurándote de que Node.js esté instalado y las variables de entorno se configuren de forma segura para el acceso al API.

Los casos de uso incluyen monitorización de flags impulsada por IA, gestión automatizada de funcionalidades, descubrimiento de proyectos, exposición contextual de flags para LLMs e integración en pipelines de despliegue continuo.

Permite la automatización del cambio de estado de los feature flags y la gestión de proyectos como parte de los pipelines CI/CD, aumentando la agilidad en el despliegue y reduciendo la intervención manual.

Permite que tus agentes de IA gestionen y monitoricen los feature flags de forma programática. Optimiza los flujos de despliegue y decisión con la integración de Unleash MCP Server.

El Servidor MCP de Upstash permite a asistentes y agentes de IA gestionar bases de datos en la nube de Upstash de forma sencilla, utilizando lenguaje natural o ...

El Servidor Lightdash MCP conecta asistentes de IA y Lightdash, una plataforma moderna de inteligencia empresarial, permitiendo el acceso programático sin probl...

Integra FlowHunt con Unleash Feature Toggle para una gestión fluida de flags de funcionalidad en tus aplicaciones LLM. Consulta, crea y actualiza flags al insta...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.