Integrazione Unleash MCP Server

Il server Unleash MCP collega assistenti AI e applicazioni LLM al sistema Unleash Feature Toggle, abilitando la gestione automatizzata dei flag di funzionalità,...

Integra il server Langfuse MCP con FlowHunt per gestire, recuperare e compilare centralmente i prompt AI da Langfuse, abilitando flussi di lavoro LLM dinamici e standardizzati.

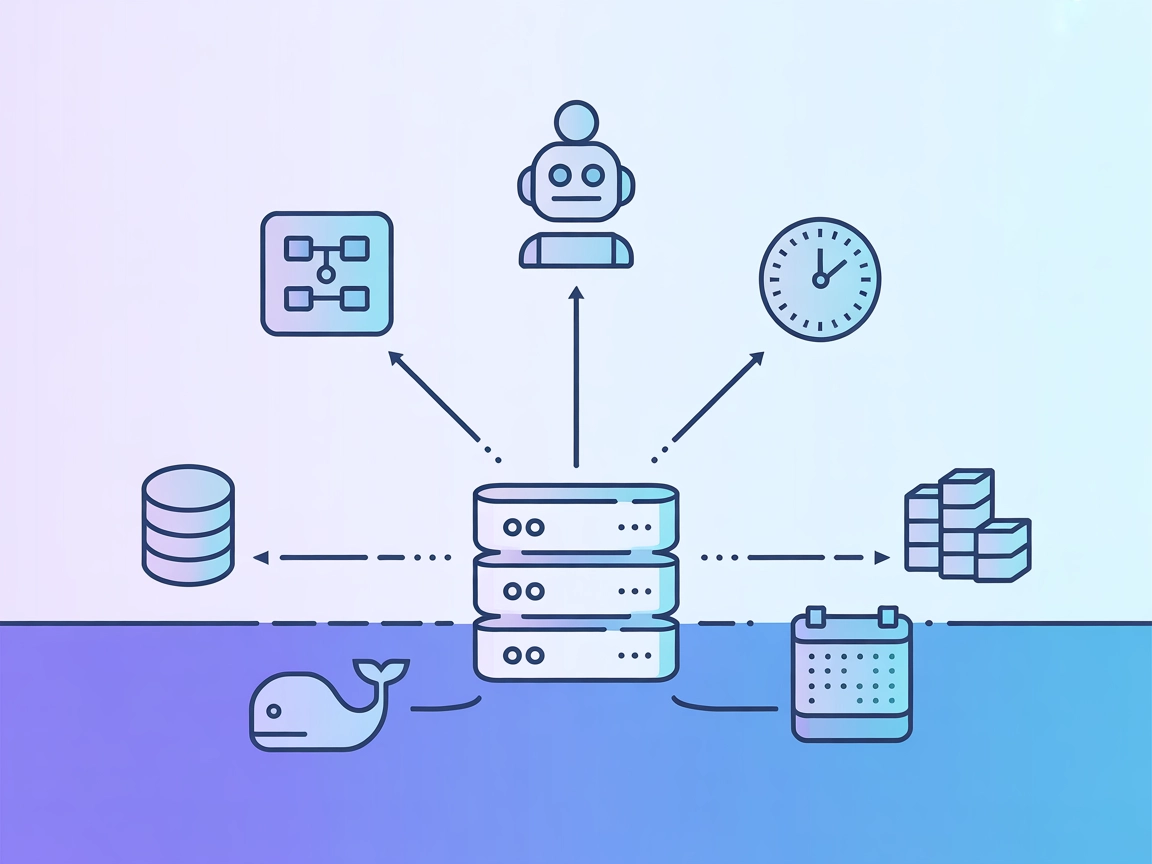

Il server Langfuse MCP è un server Model Context Protocol (MCP) progettato per la gestione dei prompt con Langfuse. Consente ad assistenti AI e sviluppatori di accedere e gestire i prompt archiviati in Langfuse utilizzando l’interfaccia standardizzata MCP. Collegando i client AI ai repository di prompt esterni tramite MCP, questo server semplifica il recupero, l’elenco e la compilazione dei prompt, migliorando il flusso di lavoro di sviluppo per i Large Language Model (LLM). Il server Langfuse MCP supporta la scoperta, il recupero e la compilazione dei prompt, consentendo attività come la selezione dinamica dei prompt e la sostituzione delle variabili. Questa integrazione semplifica la gestione dei prompt e standardizza le interazioni tra LLM e database di prompt, risultando particolarmente utile in ambienti in cui è richiesta coerenza e condivisione dei prompt tra team o piattaforme.

prompts/list: Elenca tutti i prompt disponibili nel repository Langfuse. Supporta la paginazione opzionale basata su cursore e fornisce i nomi dei prompt con i relativi argomenti richiesti. Tutti gli argomenti sono considerati opzionali.prompts/get: Recupera un prompt specifico per nome e lo compila con le variabili fornite. Supporta sia prompt di testo che di chat, trasformandoli in oggetti prompt MCP.production in Langfuse per la scoperta e il recupero da parte dei client AI.get-prompts: Elenca i prompt disponibili con i relativi argomenti. Supporta il parametro opzionale cursor per la paginazione, restituendo un elenco di nomi di prompt e argomenti.get-prompt: Recupera e compila un prompt specifico. Richiede il parametro name e opzionalmente accetta un oggetto JSON di variabili per popolare il prompt.Nessuna istruzione specifica per Windsurf è stata trovata nel repository.

npm install

npm run build

claude_desktop_config.json per aggiungere il server MCP:{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "la-tua-public-key",

"LANGFUSE_SECRET_KEY": "la-tua-secret-key",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

npm install

npm run build

LANGFUSE_PUBLIC_KEY="la-tua-public-key" LANGFUSE_SECRET_KEY="la-tua-secret-key" LANGFUSE_BASEURL="https://cloud.langfuse.com" node absolute-path/build/index.js

Nessuna istruzione specifica per Cline è stata trovata nel repository.

Si raccomanda di proteggere le chiavi API utilizzando variabili d’ambiente. Ecco un esempio di snippet JSON per la configurazione del server MCP:

{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "la-tua-public-key",

"LANGFUSE_SECRET_KEY": "la-tua-secret-key",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

Sostituisci i valori con le tue reali credenziali API.

Utilizzo di MCP in FlowHunt

Per integrare i server MCP all’interno del tuo workflow FlowHunt, inizia aggiungendo il componente MCP al tuo flow e collegandolo al tuo agente AI:

Clicca sul componente MCP per aprire il pannello di configurazione. Nella sezione di configurazione MCP di sistema, inserisci i dettagli del tuo server MCP usando questo formato JSON:

{

"langfuse": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Una volta configurato, l’agente AI sarà in grado di utilizzare questo MCP come strumento, con accesso a tutte le sue funzioni e capacità. Ricorda di cambiare "langfuse" con il vero nome del tuo server MCP e di sostituire l’URL con quello del tuo server MCP.

| Sezione | Disponibilità | Dettagli/Note |

|---|---|---|

| Panoramica | ✅ | Langfuse MCP per la gestione dei prompt |

| Elenco dei prompt | ✅ | prompts/list, prompts/get |

| Elenco delle risorse | ✅ | Elenco prompt, variabili prompt, risorse paginati |

| Elenco degli strumenti | ✅ | get-prompts, get-prompt |

| Protezione delle chiavi API | ✅ | Tramite variabili d’ambiente nella configurazione MCP |

| Supporto Sampling (meno importante in valutazione) | ⛔ | Non menzionato |

Sulla base delle sezioni e funzionalità disponibili, il server Langfuse MCP è ben documentato e copre la maggior parte delle capacità MCP critiche, soprattutto per la gestione dei prompt. La mancanza di un supporto esplicito per sampling o roots ne limita leggermente l’estensibilità. Nel complesso, è una solida implementazione per la sua area di interesse.

| Ha una LICENSE | ✅ (MIT) |

|---|---|

| Ha almeno uno strumento | ✅ |

| Numero di Fork | 22 |

| Numero di Star | 98 |

Centralizza e standardizza i tuoi flussi di lavoro di prompt AI integrando il server Langfuse MCP con FlowHunt. Sblocca una scoperta, un recupero e una compilazione dinamica dei prompt efficiente per operazioni LLM avanzate.

Il server Unleash MCP collega assistenti AI e applicazioni LLM al sistema Unleash Feature Toggle, abilitando la gestione automatizzata dei flag di funzionalità,...

Il server LSP MCP collega i server Language Server Protocol (LSP) agli assistenti AI, abilitando analisi avanzate del codice, completamento intelligente, diagno...

Il Prefect MCP Server collega gli assistenti AI e la piattaforma Prefect per l'orchestrazione dei workflow, permettendo la gestione tramite linguaggio naturale ...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.