Integrarea Unleash MCP Server

Unleash MCP Server face legătura între asistenții AI și aplicațiile LLM cu sistemul Unleash Feature Toggle, permițând gestionarea automată a flag-urilor de func...

Integrează serverul MCP Langfuse cu FlowHunt pentru a gestiona, recupera și compila centralizat prompturi AI din Langfuse, oferind fluxuri LLM dinamice și standardizate.

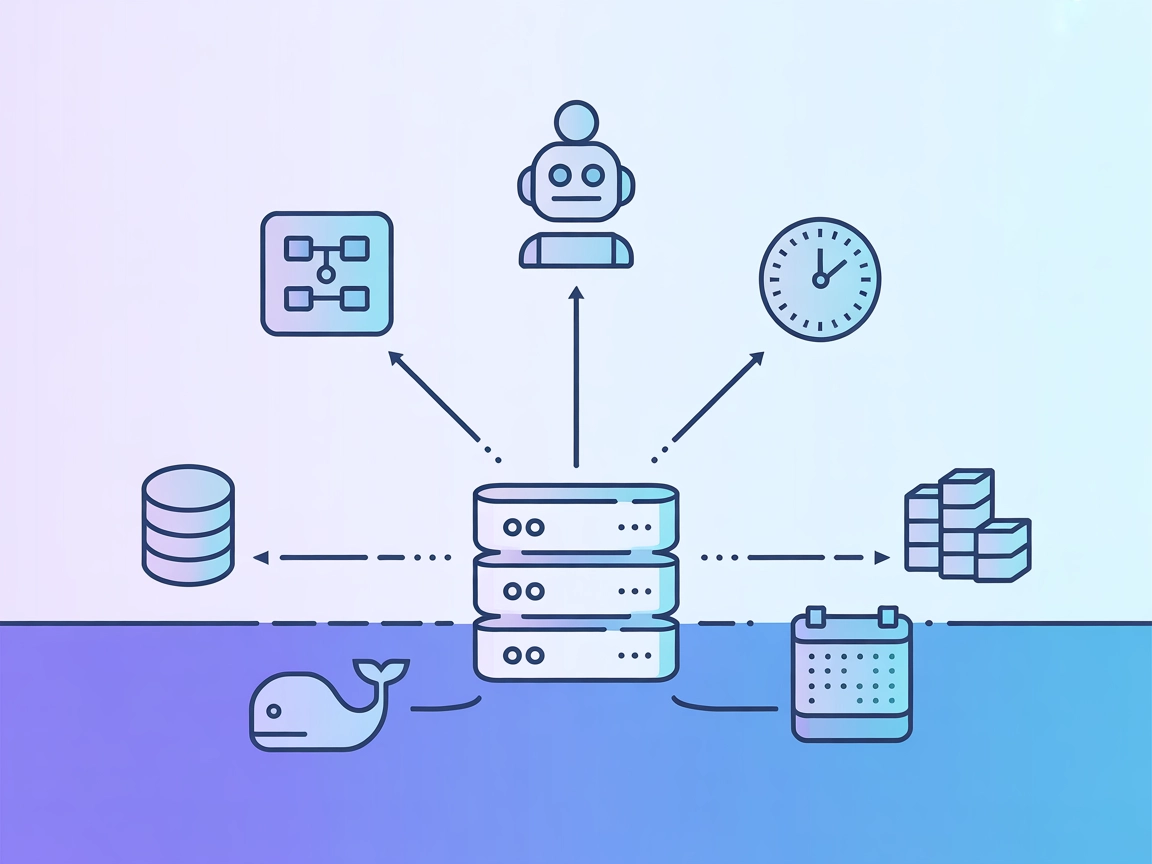

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

Serverul MCP Langfuse este un server Model Context Protocol (MCP) proiectat pentru gestionarea prompturilor în Langfuse. Permite asistenților AI și dezvoltatorilor să acceseze și să gestioneze prompturile stocate în Langfuse utilizând interfața standardizată MCP. Prin conectarea clienților AI la depozite externe de prompturi prin MCP, acest server eficientizează recuperarea, listarea și compilarea prompturilor, îmbunătățind fluxul de dezvoltare pentru modele lingvistice mari (LLM). Serverul MCP Langfuse suportă descoperirea, recuperarea și compilarea prompturilor, permițând activități precum selecția dinamică a promptului și înlocuirea variabilelor. Această integrare simplifică gestionarea prompturilor și standardizează interacțiunile dintre LLM-uri și bazele de date de prompturi, fiind deosebit de utilă în medii unde este necesară utilizarea și partajarea consecventă a prompturilor între echipe sau platforme.

prompts/list: Listează toate prompturile disponibile din depozitul Langfuse. Suportă opțional paginare bazată pe cursor și oferă numele prompturilor și argumentele necesare. Toate argumentele sunt considerate opționale.prompts/get: Recuperează un prompt specific după nume și îl compilează cu variabilele furnizate. Suportă atât prompturi text, cât și chat, transformându-le în obiecte MCP prompt.production în Langfuse pentru descoperire și recuperare de către clienții AI.get-prompts: Listează prompturile disponibile cu argumentele lor. Suportă opțional parametrul cursor pentru paginare, returnând o listă de nume și argumente de prompt.get-prompt: Recuperează și compilează un prompt specific. Necesită parametrul name și opțional un obiect JSON cu variabile pentru a popula promptul.Nu au fost găsite instrucțiuni specifice pentru Windsurf în depozit.

npm install

npm run build

claude_desktop_config.json pentru a adăuga serverul MCP:{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "cheia-ta-publică",

"LANGFUSE_SECRET_KEY": "cheia-ta-secretă",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

npm install

npm run build

LANGFUSE_PUBLIC_KEY="cheia-ta-publică" LANGFUSE_SECRET_KEY="cheia-ta-secretă" LANGFUSE_BASEURL="https://cloud.langfuse.com" node absolute-path/build/index.js

Nu au fost găsite instrucțiuni specifice pentru Cline în depozit.

Este recomandat să securizezi cheile API folosind variabile de mediu. Iată un exemplu de fragment JSON pentru configurarea serverului MCP:

{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "cheia-ta-publică",

"LANGFUSE_SECRET_KEY": "cheia-ta-secretă",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

Înlocuiește valorile cu datele tale reale de autentificare API.

Utilizarea MCP în FlowHunt

Pentru a integra servere MCP în fluxul tău FlowHunt, începe prin a adăuga componenta MCP în flux și conecteaz-o la agentul tău AI:

Dă click pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurare MCP de sistem, introdu detaliile serverului MCP folosind acest format JSON:

{

"langfuse": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI va putea folosi acest MCP ca unealtă, cu acces la toate funcțiile și capabilitățile sale. Nu uita să modifici "langfuse" cu numele real al serverului tău MCP și să înlocuiești URL-ul cu cel al serverului tău MCP.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | Langfuse MCP pentru gestionarea prompturilor |

| Listă de Prompturi | ✅ | prompts/list, prompts/get |

| Listă de Resurse | ✅ | Listare prompturi, variabile prompt, resurse cu paginare |

| Listă de Unelte | ✅ | get-prompts, get-prompt |

| Securizarea cheilor API | ✅ | Prin variabile de mediu în configurarea MCP |

| Suport pentru sampling (mai puțin relevant) | ⛔ | Nu este menționat |

Pe baza secțiunilor și funcționalităților disponibile, serverul MCP Langfuse este bine documentat și acoperă cele mai importante capabilități MCP, în special pentru gestionarea prompturilor. Lipsa suportului explicit pentru sampling sau roots reduce puțin extensibilitatea. Per ansamblu, este o implementare solidă pentru aria sa de focus.

| Are o LICENȚĂ | ✅ (MIT) |

|---|---|

| Are cel puțin o unealtă | ✅ |

| Număr Fork-uri | 22 |

| Număr Stele | 98 |

Centralizează și standardizează fluxurile tale de prompturi AI integrând serverul MCP Langfuse cu FlowHunt. Descoperă, recuperează și compilează prompturi eficient pentru operațiuni LLM avansate.

Unleash MCP Server face legătura între asistenții AI și aplicațiile LLM cu sistemul Unleash Feature Toggle, permițând gestionarea automată a flag-urilor de func...

Serverul LSP MCP conectează servere Language Server Protocol (LSP) cu asistenți AI, permițând analiză avansată a codului, completare inteligentă, diagnosticare ...

Prefect MCP Server conectează asistenții AI și platforma de orchestrare a fluxurilor Prefect, permițând gestionarea prin limbaj natural a fluxurilor, deployment...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.