Integração do Unleash MCP Server

O Unleash MCP Server conecta assistentes de IA e aplicações LLM ao sistema Unleash Feature Toggle, permitindo a gestão automatizada de feature flags, descoberta...

Automação de IA

Integre o Servidor Langfuse MCP ao FlowHunt para gerenciar, recuperar e compilar prompts de IA do Langfuse centralmente, promovendo fluxos de trabalho dinâmicos e padronizados de LLM.

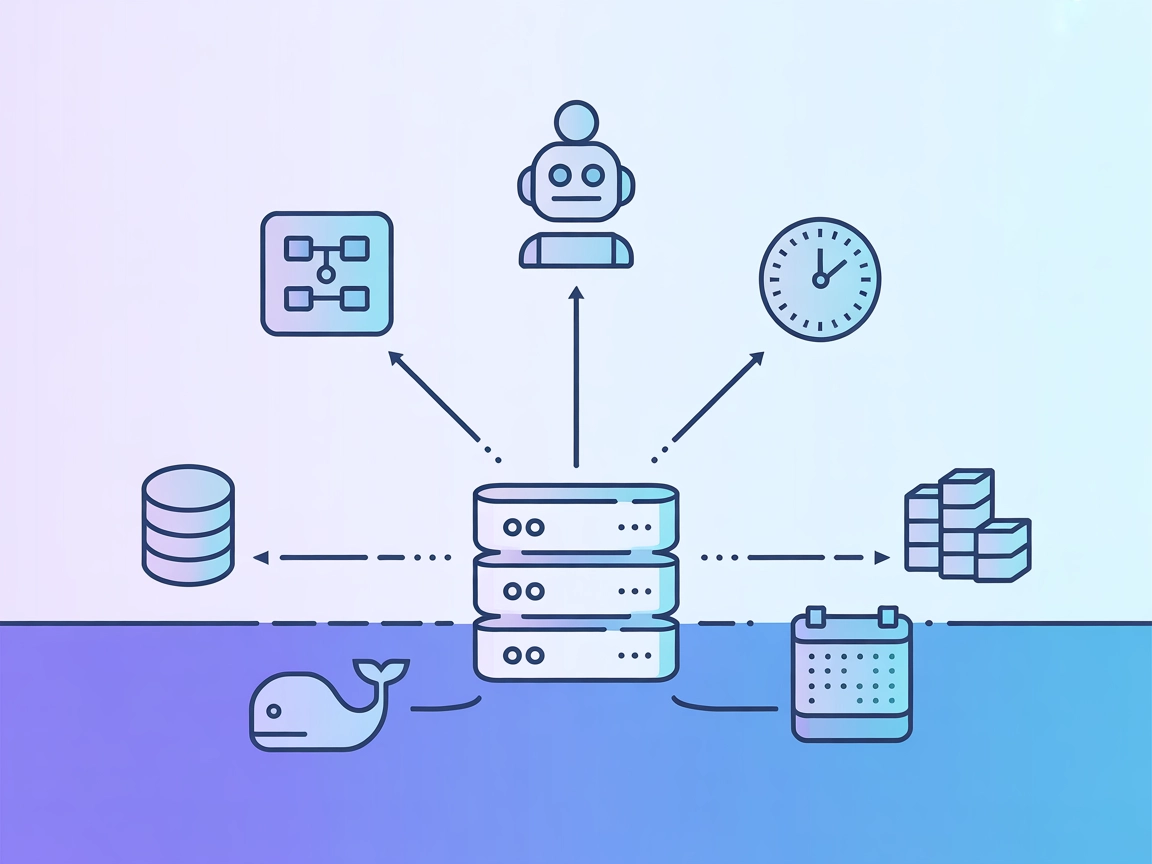

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

O Servidor Langfuse MCP é um servidor Model Context Protocol (MCP) projetado para o Gerenciamento de Prompts Langfuse. Ele permite que assistentes de IA e desenvolvedores acessem e gerenciem prompts armazenados no Langfuse usando a interface padronizada MCP. Ao conectar clientes de IA a repositórios externos de prompts via MCP, este servidor simplifica a recuperação, listagem e compilação de prompts, otimizando o fluxo de desenvolvimento para grandes modelos de linguagem (LLMs). O Servidor Langfuse MCP suporta descoberta, recuperação e compilação de prompts, permitindo tarefas como seleção dinâmica de prompts e substituição de variáveis. Essa integração simplifica o gerenciamento de prompts e padroniza as interações entre LLMs e bancos de dados de prompts, sendo especialmente útil em ambientes onde o uso consistente e o compartilhamento de prompts são necessários entre equipes ou plataformas.

prompts/list: Lista todos os prompts disponíveis no repositório Langfuse. Suporta paginação opcional baseada em cursor e fornece nomes de prompts com seus argumentos necessários. Todos os argumentos são considerados opcionais.prompts/get: Recupera um prompt específico pelo nome e o compila com as variáveis fornecidas. Suporta prompts de texto e chat, transformando-os em objetos de prompt MCP.production no Langfuse para descoberta e recuperação por clientes de IA.get-prompts: Lista os prompts disponíveis com seus argumentos. Suporta o parâmetro opcional cursor para paginação, retornando uma lista de nomes de prompts e argumentos.get-prompt: Recupera e compila um prompt específico. Requer o parâmetro name e, opcionalmente, recebe um objeto JSON de variáveis para preencher o prompt.Nenhuma instrução específica para Windsurf foi encontrada no repositório.

npm install

npm run build

claude_desktop_config.json para adicionar o servidor MCP:{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "sua-public-key",

"LANGFUSE_SECRET_KEY": "sua-secret-key",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

npm install

npm run build

LANGFUSE_PUBLIC_KEY="sua-public-key" LANGFUSE_SECRET_KEY="sua-secret-key" LANGFUSE_BASEURL="https://cloud.langfuse.com" node absolute-path/build/index.js

Nenhuma instrução específica para Cline foi encontrada no repositório.

É recomendado proteger suas chaves de API utilizando variáveis de ambiente. Aqui está um exemplo de trecho JSON para a configuração do servidor MCP:

{

"mcpServers": {

"langfuse": {

"command": "node",

"args": ["<absolute-path>/build/index.js"],

"env": {

"LANGFUSE_PUBLIC_KEY": "sua-public-key",

"LANGFUSE_SECRET_KEY": "sua-secret-key",

"LANGFUSE_BASEURL": "https://cloud.langfuse.com"

}

}

}

}

Substitua os valores pelas suas credenciais reais da API.

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo de trabalho do FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do MCP do sistema, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"langfuse": {

"transport": "streamable_http",

"url": "https://seudominio.exemplo/pathtothemcp/url"

}

}

Uma vez configurado, o agente de IA poderá usar este MCP como ferramenta, acessando todas as suas funções e capacidades. Lembre-se de alterar "langfuse" para o nome real do seu servidor MCP e substituir a URL pela URL do seu próprio servidor MCP.

| Seção | Disponibilidade | Detalhes/Notas |

|---|---|---|

| Visão geral | ✅ | Langfuse MCP para gerenciamento de prompts |

| Lista de Prompts | ✅ | prompts/list, prompts/get |

| Lista de Recursos | ✅ | Listagem de prompts, variáveis de prompt, recursos paginados |

| Lista de Ferramentas | ✅ | get-prompts, get-prompt |

| Protegendo as Chaves de API | ✅ | Via variáveis de ambiente na configuração MCP |

| Suporte a Amostragem (menos importante na avaliação) | ⛔ | Não mencionado |

Com base nas seções e recursos disponíveis, o Servidor Langfuse MCP é bem documentado e cobre as principais capacidades MCP, especialmente para gerenciamento de prompts. A ausência de suporte explícito a amostragem ou roots reduz um pouco a extensibilidade. No geral, é uma implementação forte para seu foco principal.

| Possui LICENSE | ✅ (MIT) |

|---|---|

| Possui ao menos uma ferramenta | ✅ |

| Número de Forks | 22 |

| Número de Stars | 98 |

Centralize e padronize seus fluxos de trabalho de prompts de IA integrando o Servidor Langfuse MCP ao FlowHunt. Desbloqueie descoberta eficiente de prompts, recuperação e compilação dinâmica para operações avançadas de LLM.

O Unleash MCP Server conecta assistentes de IA e aplicações LLM ao sistema Unleash Feature Toggle, permitindo a gestão automatizada de feature flags, descoberta...

O Servidor Prefect MCP conecta assistentes de IA à plataforma de orquestração de fluxos Prefect, permitindo o gerenciamento em linguagem natural de fluxos, impl...

O Servidor LSP MCP conecta servidores Language Server Protocol (LSP) a assistentes de IA, permitindo análise avançada de código, autocompletar inteligente, diag...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.