mem0 MCP-server

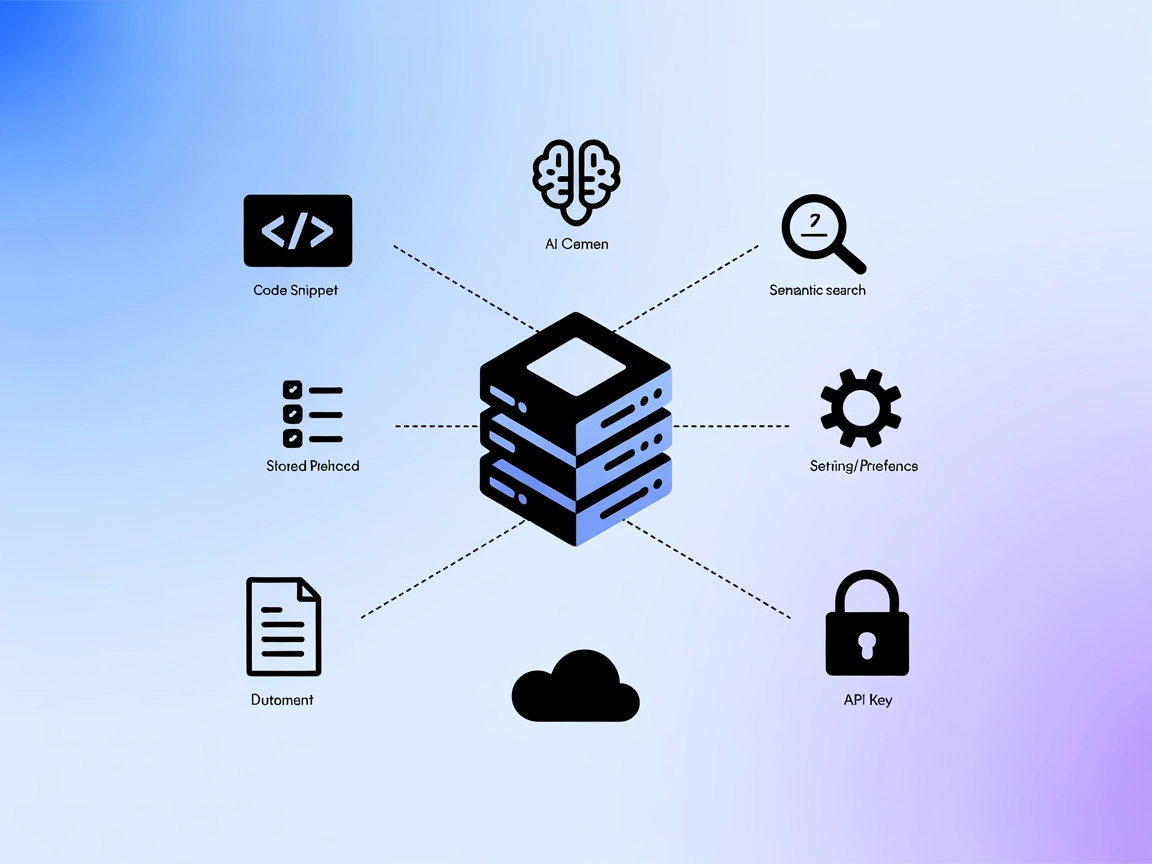

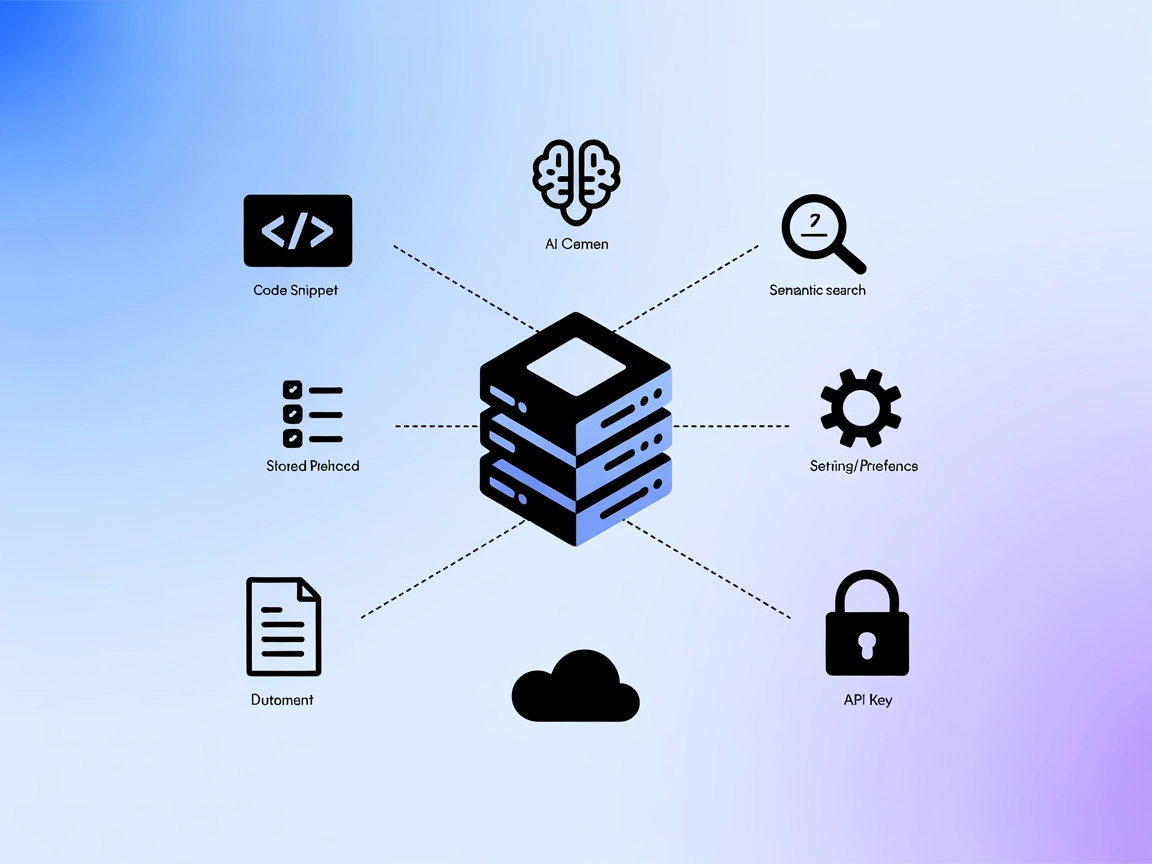

mem0 MCP-server kopplar AI-assistenter till strukturerad lagring, hämtning och semantisk sökning för kodsnuttar, dokumentation och bästa praxis inom kodning. De...

Aktivera säkert, beständigt och multi-session AI-minne med Membase MCP-server—en decentraliserad minnesgateway för robust agentkontinuitet och efterlevnad.

FlowHunt erbjuder ett extra säkerhetslager mellan dina interna system och AI-verktyg, vilket ger dig granulär kontroll över vilka verktyg som är tillgängliga från dina MCP-servrar. MCP-servrar som hostas i vår infrastruktur kan sömlöst integreras med FlowHunts chatbot samt populära AI-plattformar som ChatGPT, Claude och olika AI-redigerare.

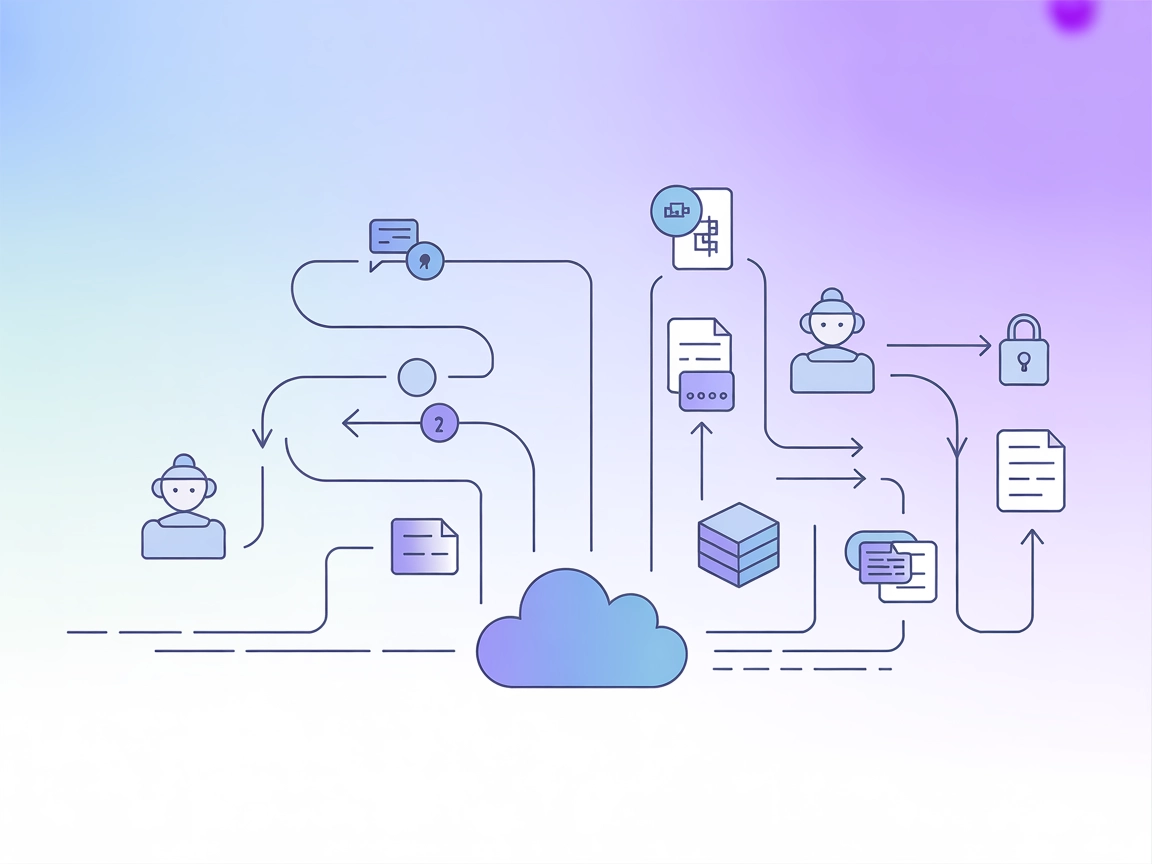

Membase MCP (Model Context Protocol) Server fungerar som en lättviktig, decentraliserad minnesgateway för AI-agenter och kopplar dem till Membase för säkert, beständigt och verifierbart multi-session minne. Drivs av Unibase och låter AI-assistenter ladda upp och hämta konversationshistorik, interaktionsregister och kunskap, vilket säkerställer agentkontinuitet, personalisering och spårbarhet. Genom att integrera med Membase-protokollet möjliggör servern sömlös lagring och hämtning av minnesdata från Unibase decentraliserade nätverk, och stödjer användningsfall där beständigt, manipuleringssäkert minne är avgörande för AI-drivna arbetsflöden.

Inga promptmallar nämns i repot.

Inga explicita MCP-resurser beskrivs i repot.

uv-runner).git clone https://github.com/unibaseio/membase-mcp.git{

"mcpServers": {

"membase": {

"command": "uv",

"args": [

"--directory",

"path/to/membase-mcp",

"run",

"src/membase_mcp/server.py"

],

"env": {

"MEMBASE_ACCOUNT": "ditt konto, 0x...",

"MEMBASE_CONVERSATION_ID": "ditt konversations-id, ska vara unikt",

"MEMBASE_ID": "ditt subkonto, valfri sträng"

}

}

}

}

Säkra API-nycklar:

Använd miljövariabler i env-blocket för att hålla uppgifterna säkra.

uv-runner och Python).{

"mcpServers": {

"membase": {

"command": "uv",

"args": [

"--directory",

"path/to/membase-mcp",

"run",

"src/membase_mcp/server.py"

],

"env": {

"MEMBASE_ACCOUNT": "ditt konto, 0x...",

"MEMBASE_CONVERSATION_ID": "ditt konversations-id, ska vara unikt",

"MEMBASE_ID": "ditt subkonto, valfri sträng"

}

}

}

}

Obs! Spara känslig information som miljövariabler.

uv).{

"mcpServers": {

"membase": {

"command": "uv",

"args": [

"--directory",

"path/to/membase-mcp",

"run",

"src/membase_mcp/server.py"

],

"env": {

"MEMBASE_ACCOUNT": "ditt konto, 0x...",

"MEMBASE_CONVERSATION_ID": "ditt konversations-id, ska vara unikt",

"MEMBASE_ID": "ditt subkonto, valfri sträng"

}

}

}

}

uv, Python).{

"mcpServers": {

"membase": {

"command": "uv",

"args": [

"--directory",

"path/to/membase-mcp",

"run",

"src/membase_mcp/server.py"

],

"env": {

"MEMBASE_ACCOUNT": "ditt konto, 0x...",

"MEMBASE_CONVERSATION_ID": "ditt konversations-id, ska vara unikt",

"MEMBASE_ID": "ditt subkonto, valfri sträng"

}

}

}

}

Säkra API-nycklar:

Alla känsliga uppgifter bör skickas i env-objektet som visas ovan för att undvika hårdkodning.

Använd MCP i FlowHunt

För att integrera MCP-servrar i ditt FlowHunt-arbetsflöde börjar du med att lägga till MCP-komponenten i ditt flöde och koppla den till din AI-agent:

Klicka på MCP-komponenten för att öppna konfigurationspanelen. I sektionen för systemets MCP-konfiguration, lägg in dina MCP-serveruppgifter med detta JSON-format:

{

"MCP-name": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

När det är konfigurerat kan AI-agenten nu använda denna MCP som ett verktyg med tillgång till alla dess funktioner. Kom ihåg att ändra “MCP-name” till det faktiska namnet på din MCP-server (t.ex. “github-mcp”, “weather-api” etc.) och byt ut URL:en mot din egen MCP-server-URL.

| Sektion | Tillgänglighet | Detaljer/Noteringar |

|---|---|---|

| Översikt | ✅ | |

| Lista över promptar | ⛔ | Inga återanvändbara promptmallar tillhandahålls |

| Lista över resurser | ⛔ | Inga explicita MCP-resurser listade |

| Lista över verktyg | ✅ | get_conversation_id, switch_conversation, save_message, get_messages |

| Säkra API-nycklar | ✅ | Använder miljövariabler i konfigurationen |

| Samplingstöd (mindre viktigt vid utvärdering) | ⛔ | Inte nämnt |

Baserat på tillgänglig information tillhandahåller Membase MCP-server kärnminnesverktyg och tydliga installationsinstruktioner, men saknar promptmallar, explicita MCP-resurser och omnämnande av sampling- eller roots-stöd. Detta gör den funktionell för minnescentrerade arbetsflöden men begränsad i utbyggbarhet och avancerade MCP-funktioner. Sammantaget är den praktisk men grundläggande.

| Har LICENS | ⛔ (Ingen licensfil finns) |

|---|---|

| Har åtminstone ett verktyg | ✅ |

| Antal forkar | 4 |

| Antal stjärnor | 4 |

Stärk dina AI-flöden med decentraliserat, manipuleringssäkert minne. Installera Membase MCP-server i FlowHunt och lås upp avancerad multi-session funktionalitet.

mem0 MCP-server kopplar AI-assistenter till strukturerad lagring, hämtning och semantisk sökning för kodsnuttar, dokumentation och bästa praxis inom kodning. De...

Memgraph MCP Server fungerar som en brygga mellan grafdatabasen Memgraph och stora språkmodeller, vilket möjliggör realtidsåtkomst till grafdata och AI-drivna a...

Rememberizer MCP-servern fungerar som en brygga mellan AI-assistenter och kunskapshantering, möjliggör semantisk sökning, enhetlig dokumenthämtning och team-sam...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.