Integração do Vectara MCP Server

O Vectara MCP Server é uma ponte open source entre assistentes de IA e a plataforma Trusted RAG da Vectara, permitindo uma Geração Aumentada por Recuperação (RA...

Automação de IA

Conecte o FlowHunt ao Vectorize MCP Server para uma busca baseada em vetores sem interrupções, extração de texto aprimorada e gerenciamento eficiente de dados em suas aplicações de IA.

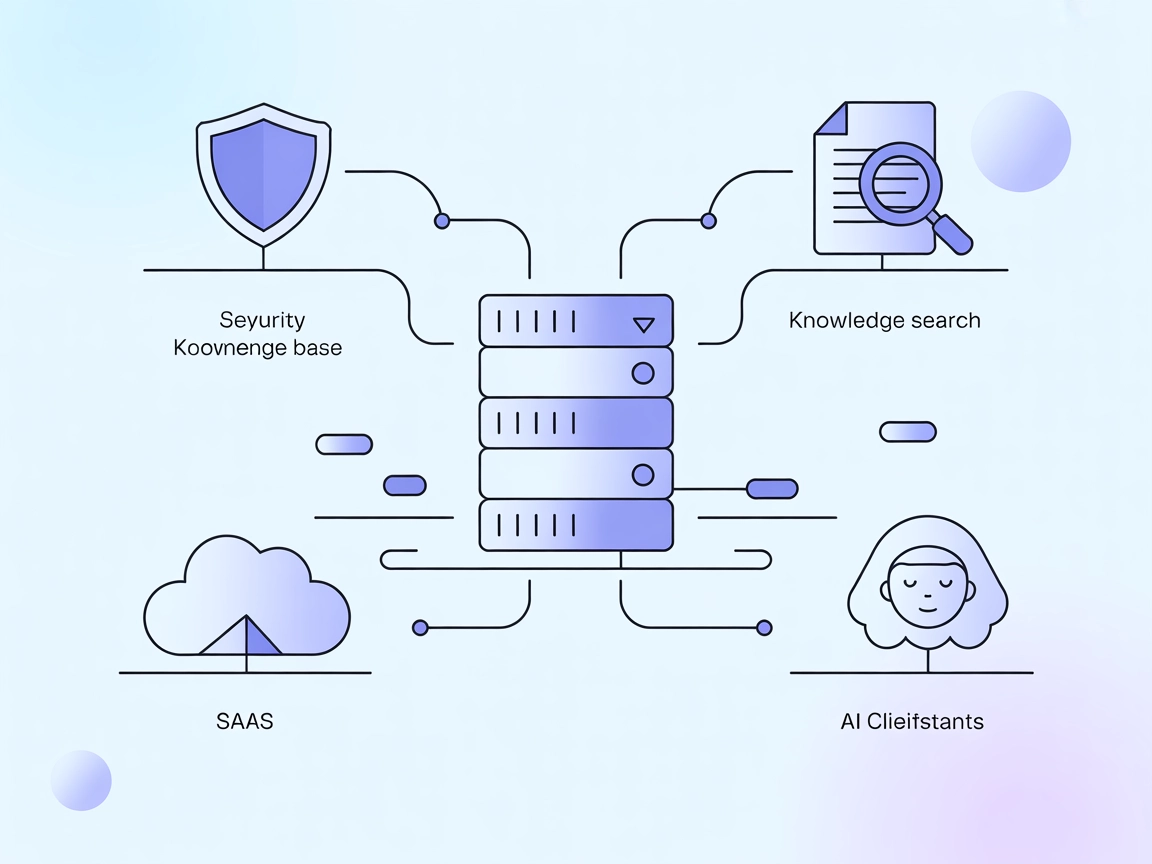

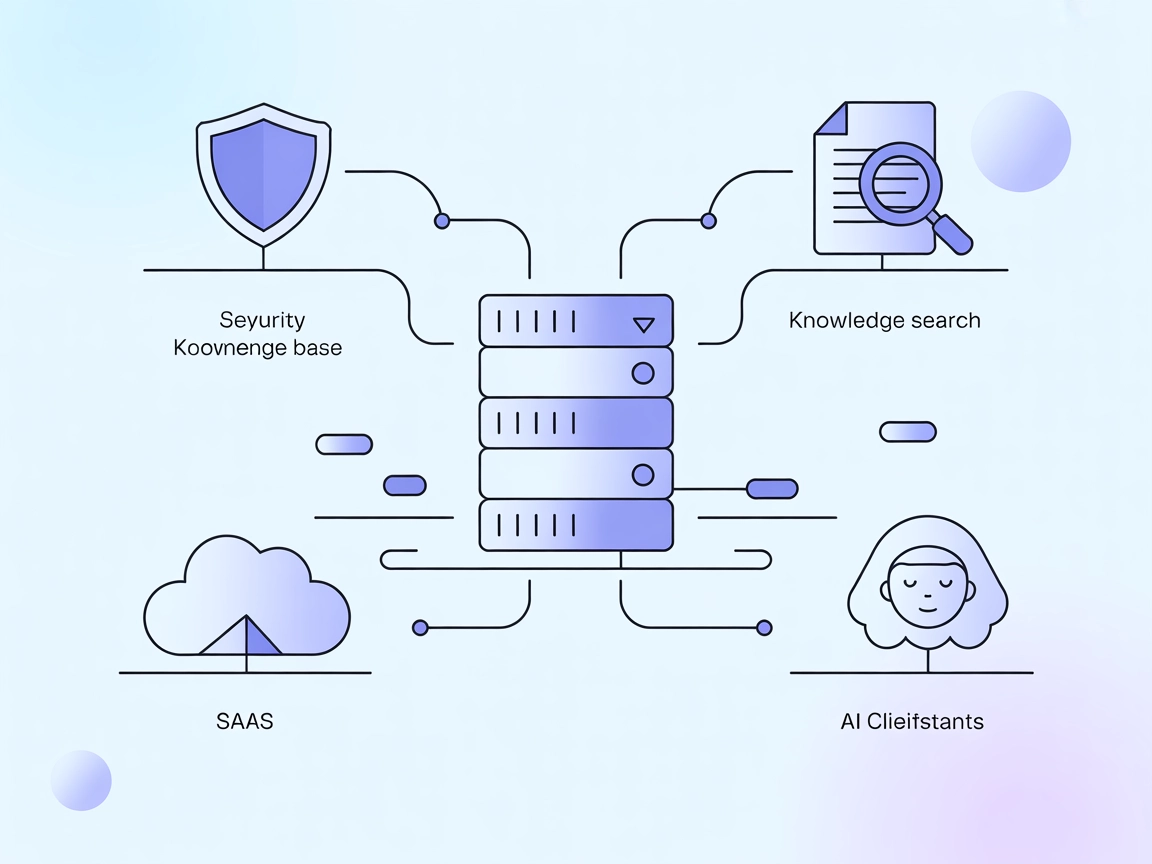

O FlowHunt fornece uma camada de segurança adicional entre seus sistemas internos e ferramentas de IA, dando-lhe controle granular sobre quais ferramentas são acessíveis a partir de seus servidores MCP. Os servidores MCP hospedados em nossa infraestrutura podem ser perfeitamente integrados com o chatbot do FlowHunt, bem como com plataformas de IA populares como ChatGPT, Claude e vários editores de IA.

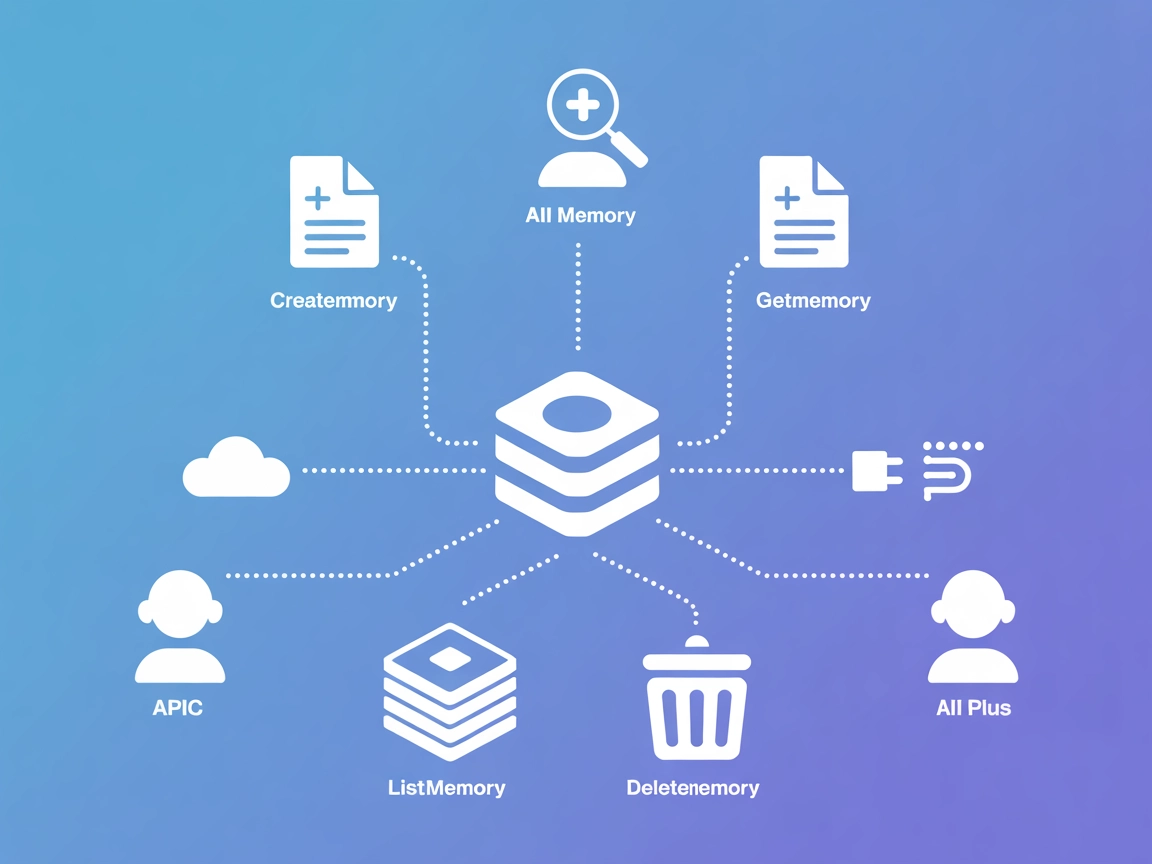

O Vectorize MCP Server é uma implementação do Model Context Protocol (MCP) projetada para integrar-se ao Vectorize para recuperação avançada de vetores e extração de texto. Ao conectar assistentes de IA à plataforma Vectorize, o servidor permite fluxos de desenvolvimento aprimorados, como a obtenção de representações vetoriais dos dados e a extração de informações textuais relevantes. Isso possibilita que clientes e desenvolvedores de IA aproveitem fontes de dados externas de forma eficiente, realizem consultas sofisticadas baseadas em vetores e gerenciem conteúdos para interações posteriores com LLMs. O servidor é especialmente útil para tarefas que exigem busca semântica, recuperação inteligente de contexto e gerenciamento de dados em larga escala, otimizando e potencializando aplicações e fluxos de trabalho baseados em IA.

Não há templates de prompts mencionados no repositório.

Não há recursos explícitos listados ou descritos nos arquivos do repositório.

Não há definições específicas de ferramentas listadas nos arquivos disponíveis do repositório, incluindo o server.py (o repositório utiliza um diretório src, mas o conteúdo não é exibido).

VECTORIZE_ORG_IDVECTORIZE_TOKENVECTORIZE_PIPELINE_ID{

"mcpServers": {

"vectorize": {

"command": "npx",

"args": ["-y", "@vectorize-io/vectorize-mcp-server@latest"],

"env": {

"VECTORIZE_ORG_ID": "${input:org_id}",

"VECTORIZE_TOKEN": "${input:token}",

"VECTORIZE_PIPELINE_ID": "${input:pipeline_id}"

},

"inputs": [

{ "type": "promptString", "id": "org_id", "description": "ID da Organização Vectorize" },

{ "type": "promptString", "id": "token", "description": "Token Vectorize", "password": true },

{ "type": "promptString", "id": "pipeline_id", "description": "ID do Pipeline Vectorize" }

]

}

}

}

{

"mcpServers": {

"vectorize": {

"command": "npx",

"args": ["-y", "@vectorize-io/vectorize-mcp-server@latest"],

"env": {

"VECTORIZE_ORG_ID": "${input:org_id}",

"VECTORIZE_TOKEN": "${input:token}",

"VECTORIZE_PIPELINE_ID": "${input:pipeline_id}"

},

"inputs": [

{ "type": "promptString", "id": "org_id", "description": "ID da Organização Vectorize" },

{ "type": "promptString", "id": "token", "description": "Token Vectorize", "password": true },

{ "type": "promptString", "id": "pipeline_id", "description": "ID do Pipeline Vectorize" }

]

}

}

}

{

"mcpServers": {

"vectorize": {

"command": "npx",

"args": ["-y", "@vectorize-io/vectorize-mcp-server@latest"],

"env": {

"VECTORIZE_ORG_ID": "${input:org_id}",

"VECTORIZE_TOKEN": "${input:token}",

"VECTORIZE_PIPELINE_ID": "${input:pipeline_id}"

},

"inputs": [

{ "type": "promptString", "id": "org_id", "description": "ID da Organização Vectorize" },

{ "type": "promptString", "id": "token", "description": "Token Vectorize", "password": true },

{ "type": "promptString", "id": "pipeline_id", "description": "ID do Pipeline Vectorize" }

]

}

}

}

{

"mcpServers": {

"vectorize": {

"command": "npx",

"args": ["-y", "@vectorize-io/vectorize-mcp-server@latest"],

"env": {

"VECTORIZE_ORG_ID": "${input:org_id}",

"VECTORIZE_TOKEN": "${input:token}",

"VECTORIZE_PIPELINE_ID": "${input:pipeline_id}"

},

"inputs": [

{ "type": "promptString", "id": "org_id", "description": "ID da Organização Vectorize" },

{ "type": "promptString", "id": "token", "description": "Token Vectorize", "password": true },

{ "type": "promptString", "id": "pipeline_id", "description": "ID do Pipeline Vectorize" }

]

}

}

}

Protegendo suas chaves de API:

As chaves de API e credenciais sensíveis devem ser fornecidas por variáveis de ambiente na sua configuração.

Exemplo:

"env": {

"VECTORIZE_ORG_ID": "${input:org_id}",

"VECTORIZE_TOKEN": "${input:token}",

"VECTORIZE_PIPELINE_ID": "${input:pipeline_id}"

}

Entradas podem ser configuradas para solicitar ao usuário, com password: true para campos sensíveis.

Usando MCP no FlowHunt

Para integrar servidores MCP ao seu fluxo do FlowHunt, comece adicionando o componente MCP ao seu fluxo e conectando-o ao seu agente de IA:

Clique no componente MCP para abrir o painel de configuração. Na seção de configuração do MCP do sistema, insira os detalhes do seu servidor MCP usando este formato JSON:

{

"vectorize": {

"transport": "streamable_http",

"url": "https://seudomcpserver.exemplo/caminhoparamcp/url"

}

}

Depois de configurado, o agente de IA poderá usar este MCP como uma ferramenta com acesso a todas as suas funções e capacidades. Lembre-se de alterar "vectorize" para o nome real do seu servidor MCP e substituir a URL pela sua URL do MCP.

| Seção | Disponibilidade | Detalhes/Observações |

|---|---|---|

| Visão geral | ✅ | Visão geral disponível |

| Lista de Prompts | ⛔ | Nenhum template de prompt encontrado |

| Lista de Recursos | ⛔ | Nenhum recurso explícito listado |

| Lista de Ferramentas | ⛔ | Nenhuma definição de ferramenta nos arquivos |

| Proteção de Chaves de API | ✅ | Instruções para variáveis/env e prompts de entrada |

| Suporte a Amostragem (menos relevante na avaliação) | ⛔ | Não mencionado |

O projeto Vectorize MCP Server é bem documentado em termos de configuração e integração, mas carece de documentação clara ou código sobre prompts, recursos ou definições explícitas de ferramentas no repositório público. A configuração para múltiplas plataformas é forte, mas recursos para desenvolvedores e primitivas em nível de código (como ferramentas e recursos) não estão presentes ou não são documentadas. No geral, este MCP é prático para quem utiliza Vectorize, mas faltam detalhes para adoção mais ampla dos recursos do MCP.

| Possui uma LICENSE | ✅ MIT |

|---|---|

| Possui ao menos uma ferramenta | ⛔ |

| Número de Forks | 13 |

| Número de Stars | 67 |

O Vectorize MCP Server conecta fluxos de trabalho de IA à plataforma Vectorize, permitindo recuperação avançada de vetores, busca semântica e extração automatizada de texto. Ele capacita agentes de IA a aproveitarem bancos de dados vetoriais externos para interações contextuais e gerenciamento de dados em larga escala.

Você pode configurar o Vectorize MCP Server adicionando os detalhes do servidor ao arquivo de configuração da sua plataforma (Windsurf, Claude, Cursor ou Cline), definindo as variáveis de ambiente necessárias e reiniciando a plataforma. Instruções detalhadas passo a passo são fornecidas para cada plataforma na documentação.

Os principais casos de uso incluem busca vetorial semântica, extração automatizada de texto de documentos, aumento em tempo real de bases de conhecimento, integração perfeita com assistentes de IA e gerenciamento ágil de dados vetoriais em larga escala.

Sempre forneça credenciais sensíveis como VECTORIZE_TOKEN por variáveis de ambiente ou utilize entradas de configuração com proteção por senha. Evite colocar segredos diretamente nos arquivos de configuração para manter a segurança.

Não há templates de prompts ou definições explícitas de ferramentas incluídas na documentação atual do repositório. O principal valor está em sua capacidade de conectar-se a fontes externas de dados vetoriais para aprimorar fluxos de IA.

Desbloqueie busca vetorial avançada e extração de dados ao integrar o Vectorize MCP Server com o FlowHunt. Impulsione as capacidades do seu agente de IA com acesso em tempo real e contextualizado a fontes de dados externas.

O Vectara MCP Server é uma ponte open source entre assistentes de IA e a plataforma Trusted RAG da Vectara, permitindo uma Geração Aumentada por Recuperação (RA...

O StitchAI MCP Server potencializa a gestão de memória contextual para agentes de IA, permitindo que armazenem, recuperem e organizem conhecimentos estruturados...

O Rememberizer MCP Server faz a ponte entre assistentes de IA e a gestão do conhecimento, permitindo busca semântica, recuperação unificada de documentos e cola...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.