Ce este componenta LLM DeepSeek?

Componenta LLM DeepSeek conectează modelele DeepSeek la Flow-ul tău. În timp ce Generatoarele și Agenții sunt locul unde are loc magia propriu-zisă, componentele LLM îți permit să schimbi și să controlezi modelul folosit.

Ține minte că conectarea unei componente LLM este opțională. Toate componentele care folosesc un LLM vin cu ChatGPT-4o ca implicit. Componentele LLM îți permit să schimbi modelul și să controlezi setările acestuia.

Setări pentru componenta LLM Gemini

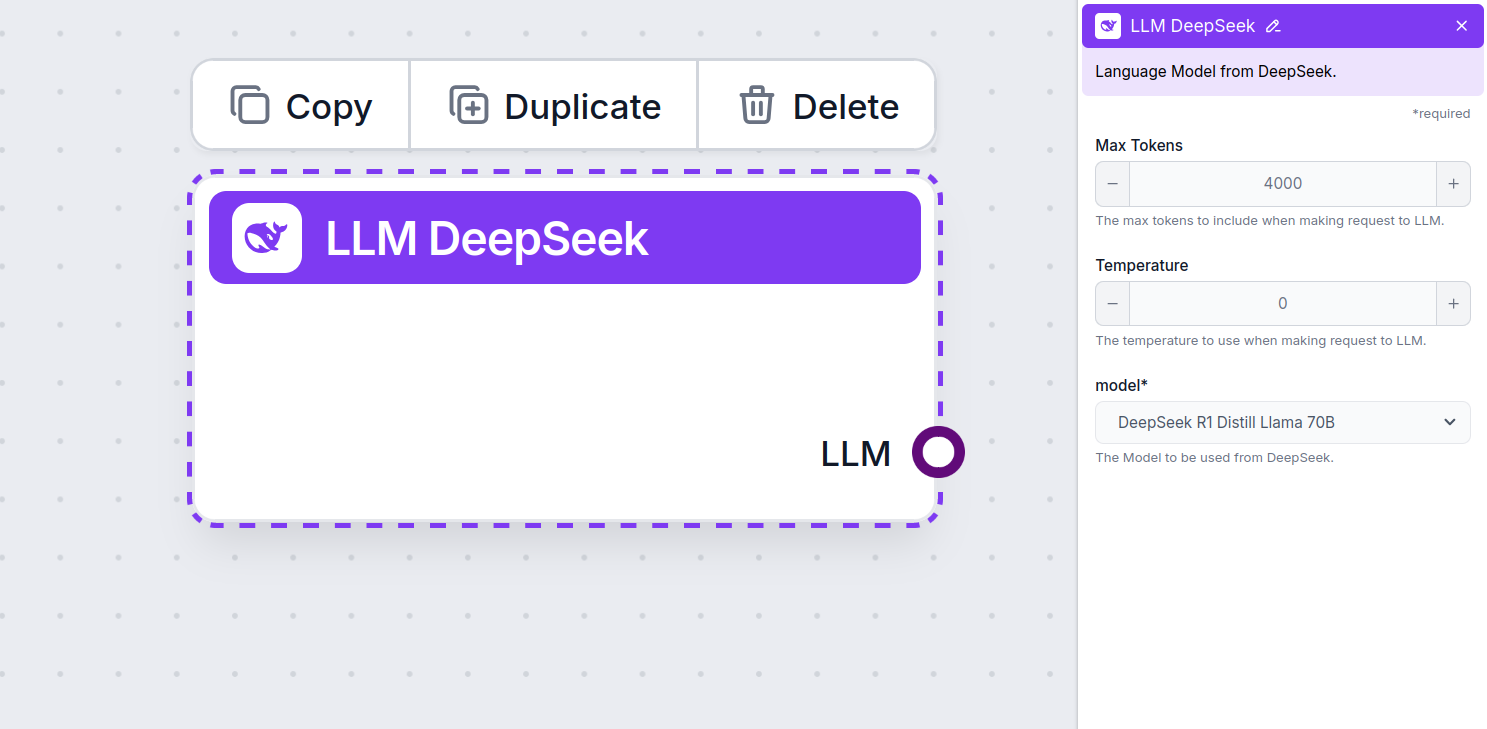

Număr maxim de tokeni

Tokenii reprezintă unitățile individuale de text pe care modelul le procesează și generează. Utilizarea tokenilor variază în funcție de model, iar un token poate însemna orice de la cuvinte sau sub-cuvinte până la un singur caracter. Modelele sunt de obicei tarifate la milioane de tokeni.

Setarea pentru numărul maxim de tokeni limitează numărul total de tokeni care pot fi procesați într-o singură interacțiune sau solicitare, asigurând că răspunsurile sunt generate în limite rezonabile. Limita implicită este de 4.000 de tokeni, dimensiunea optimă pentru rezumarea documentelor și a mai multor surse pentru a genera un răspuns.

Temperatură

Temperatura controlează variabilitatea răspunsurilor, variind de la 0 la 1.

O temperatură de 0,1 va face ca răspunsurile să fie foarte la obiect, dar potențial repetitive și sărace în conținut.

O temperatură ridicată de 1 permite creativitate maximă în răspunsuri, dar crește riscul unor rezultate irelevante sau chiar halucinante.

De exemplu, temperatura recomandată pentru un chatbot de servicii clienți este între 0,2 și 0,5. Acest nivel ar trebui să mențină răspunsurile relevante și la subiect, permițând totodată o variație naturală.

Model

Aceasta este selecția de model. Aici vei găsi toate modelele DeepSeek suportate. Susținem toate cele mai noi modele Gemini:

- DeepSeek R1: Modelul open source ușor în limba chineză care a cucerit lumea la începutul lui 2025. Este în prezent cel mai rapid și performant model DeepSeek, depășind cu ușurință modelul o1 de la OpenAI.

Cum adaugi LLM DeepSeek în Flow-ul tău

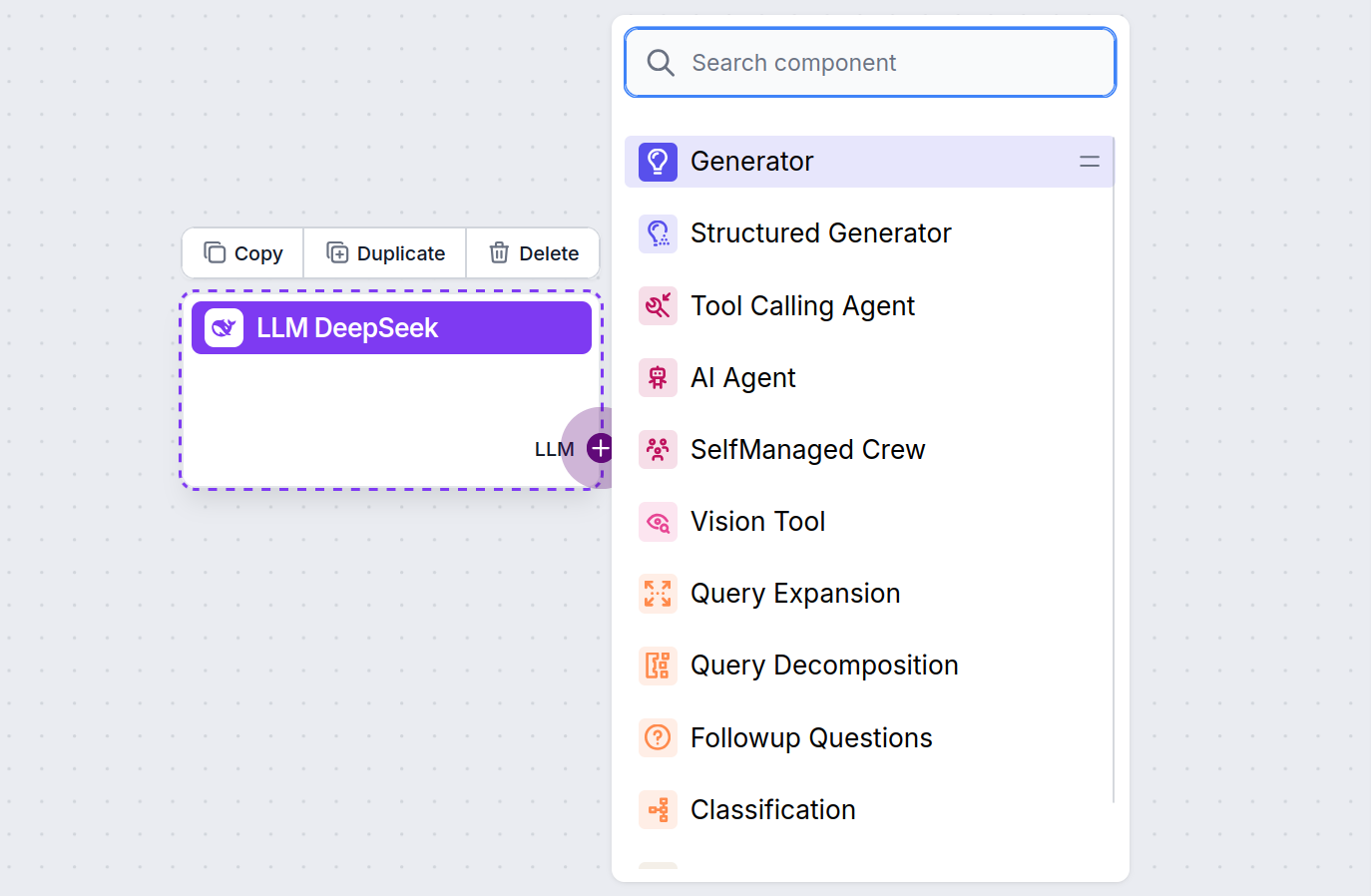

Vei observa că toate componentele LLM au doar un handle de ieșire. Inputul nu trece prin componentă, deoarece aceasta reprezintă doar modelul, în timp ce generarea efectivă se realizează în AI Agenți și Generatoare.

Handle-ul LLM este mereu mov. Handle-ul de input LLM se găsește pe orice componentă care folosește AI pentru generare de text sau procesare de date. Poți vedea opțiunile făcând click pe handle:

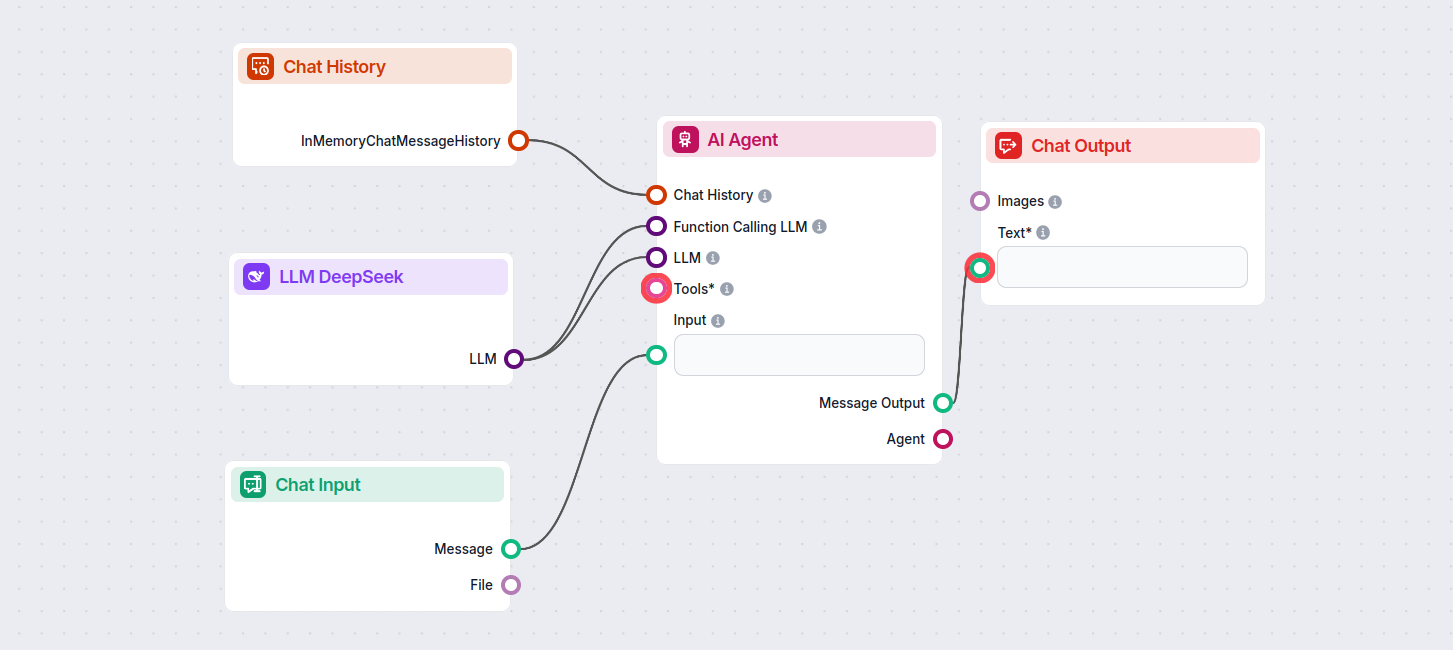

Acest lucru îți permite să creezi tot felul de instrumente. Să vedem componenta în acțiune. Iată un Flow simplu de chatbot AI Agent care folosește DeepSeek R1 pentru generarea răspunsurilor. Îl poți considera un chatbot DeepSeek de bază.

Acest Flow simplu de Chatbot include:

- Input chat: Reprezintă mesajul trimis de utilizator în chat.

- Istoric chat: Asigură că chatbot-ul își poate aminti și lua în considerare răspunsurile anterioare.

- Output chat: Reprezintă răspunsul final al chatbot-ului.

- AI Agent: Un agent AI autonom care generează răspunsuri.

- LLM DeepSeek: Conexiunea la modelele de generare DeepSeek.