Portal Kontekstowy (ConPort)

Zintegruj FlowHunt z Portalem Kontekstowym, aby stworzyć potężny bank pamięci dla swoich projektów programistycznych. Zarządzaj, przechowuj i pobieraj uporządko...

Wzmocnij swoje asystenty AI pamięcią specyficzną dla projektu. ConPort przechowuje i pobiera ustrukturyzowany kontekst projektu, umożliwiając inteligentniejsze, kontekstowe przepływy AI w FlowHunt i IDE.

FlowHunt zapewnia dodatkową warstwę bezpieczeństwa między Twoimi systemami wewnętrznymi a narzędziami AI, dając Ci szczegółową kontrolę nad tym, które narzędzia są dostępne z Twoich serwerów MCP. Serwery MCP hostowane w naszej infrastrukturze można bezproblemowo zintegrować z chatbotem FlowHunt oraz popularnymi platformami AI, takimi jak ChatGPT, Claude i różne edytory AI.

Context Portal (ConPort) to serwer MCP typu memory bank, zaprojektowany do wzmacniania asystentów AI i narzędzi deweloperskich w IDE poprzez zarządzanie ustrukturyzowanym kontekstem projektu. Działając jako projektowy graf wiedzy, ConPort umożliwia wydajne Retrieval Augmented Generation (RAG), pozwalając AI szybko uzyskać dostęp do istotnych informacji projektowych i z nich korzystać. Przechowuje kluczowe dane projektowe, takie jak decyzje, zadania, postępy, wzorce architektoniczne, glosariusze i specyfikacje w ustrukturyzowany sposób. Pomaga to asystentom AI udzielać bardziej precyzyjnych, kontekstowych odpowiedzi, usprawniając przepływy pracy przez łatwe przeszukiwanie i wykorzystywanie wiedzy projektowej.

W dostępnych plikach repozytorium ani dokumentacji nie wymieniono szablonów promptów.

W dostępnych plikach repozytorium ani dokumentacji nie wymieniono jawnych zasobów MCP.

W dostępnych plikach repozytorium ani dokumentacji nie opisano ani nie wymieniono konkretnych narzędzi z server.py ani innej logiki serwera.

Zarządzanie wiedzą projektową

Przechowuj i pobieraj kluczowe decyzje projektowe, glosariusze, specyfikacje oraz wzorce architektoniczne, umożliwiając asystentom AI dostarczanie wskazówek i kontekstu specyficznego dla projektu.

Kontekstowa pomoc AI w kodowaniu

Umożliwiaj asystentom AI w IDE dostęp do ustrukturyzowanej pamięci projektu, poprawiając sugestie kodu i wyjaśnienia poprzez wykorzystanie historii projektu i terminologii.

Retrieval Augmented Generation (RAG)

Wzmacniaj asystentów opartych na LLM, dostarczając im aktualne i relewantne dane projektowe dla dokładniejszych i bogatszych w kontekst odpowiedzi.

Śledzenie postępów projektu

Prowadź ustrukturyzowany rejestr wykonanych zadań, otwartych problemów i bieżących prac, dzięki czemu agenci AI mogą podsumować lub raportować status projektu.

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

Zabezpieczanie kluczy API:

Aby bezpiecznie przekazywać klucze API, używaj zmiennych środowiskowych. Oto przykład, jak je uwzględnić w konfiguracji:

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"],

"env": {

"CONPORT_API_KEY": "${CONPORT_API_KEY}"

},

"inputs": {

"apiKey": "${CONPORT_API_KEY}"

}

}

}

}

Używanie MCP w FlowHunt

Aby zintegrować serwery MCP w przepływie pracy FlowHunt, rozpocznij od dodania komponentu MCP do swojego flow i połącz go z agentem AI:

Kliknij komponent MCP, by otworzyć panel konfiguracji. W sekcji System MCP configuration wstaw dane serwera MCP w tym formacie JSON:

{

"context-portal": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Po zapisaniu konfiguracji agent AI może już korzystać z tego MCP jako narzędzia, mając dostęp do wszystkich jego funkcji i możliwości. Pamiętaj, by nazwę “context-portal” zastąpić faktyczną nazwą swojego serwera MCP i ustawić własny URL MCP servera.

| Sekcja | Dostępność | Szczegóły/Uwagi |

|---|---|---|

| Przegląd | ✅ | |

| Lista promptów | ⛔ | Brak szablonów promptów |

| Lista zasobów | ⛔ | Brak jawnych zasobów |

| Lista narzędzi | ⛔ | Brak narzędzi w logice serwera |

| Zabezpieczanie kluczy API | ✅ | Przykład dla zmiennych środowiskowych |

| Wsparcie Roots | ⛔ | Nie określono |

| Wsparcie Sampling (mniej istotne) | ⛔ | Nie określono |

Context Portal MCP (ConPort) zapewnia jasny przegląd i dobrze opisane zastosowania, jednak brakuje mu szczegółowej dokumentacji technicznej dotyczącej promptów, narzędzi i zasobów w dostępnych publicznych plikach. Instrukcje konfiguracji oraz wskazówki dotyczące kluczy API są pomocne. Ogólnie użyteczność jest widoczna, lecz głębsze szczegóły techniczne serwera podniosłyby ocenę.

Ocena tabeli MCP: 6/10

| Ma LICENCJĘ | ✅ (Apache-2.0) |

|---|---|

| Ma przynajmniej jedno narzędzie | ⛔ |

| Liczba Forków | 47 |

| Liczba Gwiazdek | 352 |

Context Portal to serwer MCP typu memory bank, który zarządza ustrukturyzowanym kontekstem projektu dla asystentów AI i narzędzi deweloperskich. Działa jako projektowy graf wiedzy, umożliwiając Retrieval Augmented Generation (RAG) oraz funkcje kontekstowej AI.

ConPort służy do zarządzania wiedzą projektową, kontekstowej pomocy AI w kodowaniu, Retrieval Augmented Generation (RAG) oraz śledzenia postępów projektu w przepływach deweloperskich.

Użyj zmiennych środowiskowych, aby bezpiecznie przekazywać klucze API w konfiguracji serwera MCP. Przykład: { "env": { "CONPORT_API_KEY": "${CONPORT_API_KEY}" }, "inputs": { "apiKey": "${CONPORT_API_KEY}" } }

Dodaj komponent MCP do swojego flow w FlowHunt, połącz go z agentem AI i określ szczegóły serwera ConPort MCP w panelu konfiguracji, korzystając z podanego formatu JSON. Umożliwia to agentowi AI dostęp do ustrukturyzowanego kontekstu i pamięci projektu.

W dostępnej dokumentacji i logice serwera nie wymieniono szablonów promptów ani wbudowanych narzędzi. Jego główną funkcją jest przechowywanie i pobieranie ustrukturyzowanego kontekstu do wsparcia AI specyficznego dla projektu.

Wyposaż swój zespół deweloperski w kontekstową sztuczną inteligencję, integrując Context Portal MCP Server. Usprawnij zarządzanie wiedzą projektową i popraw przepływy pracy kodowania wspierane przez AI.

Zintegruj FlowHunt z Portalem Kontekstowym, aby stworzyć potężny bank pamięci dla swoich projektów programistycznych. Zarządzaj, przechowuj i pobieraj uporządko...

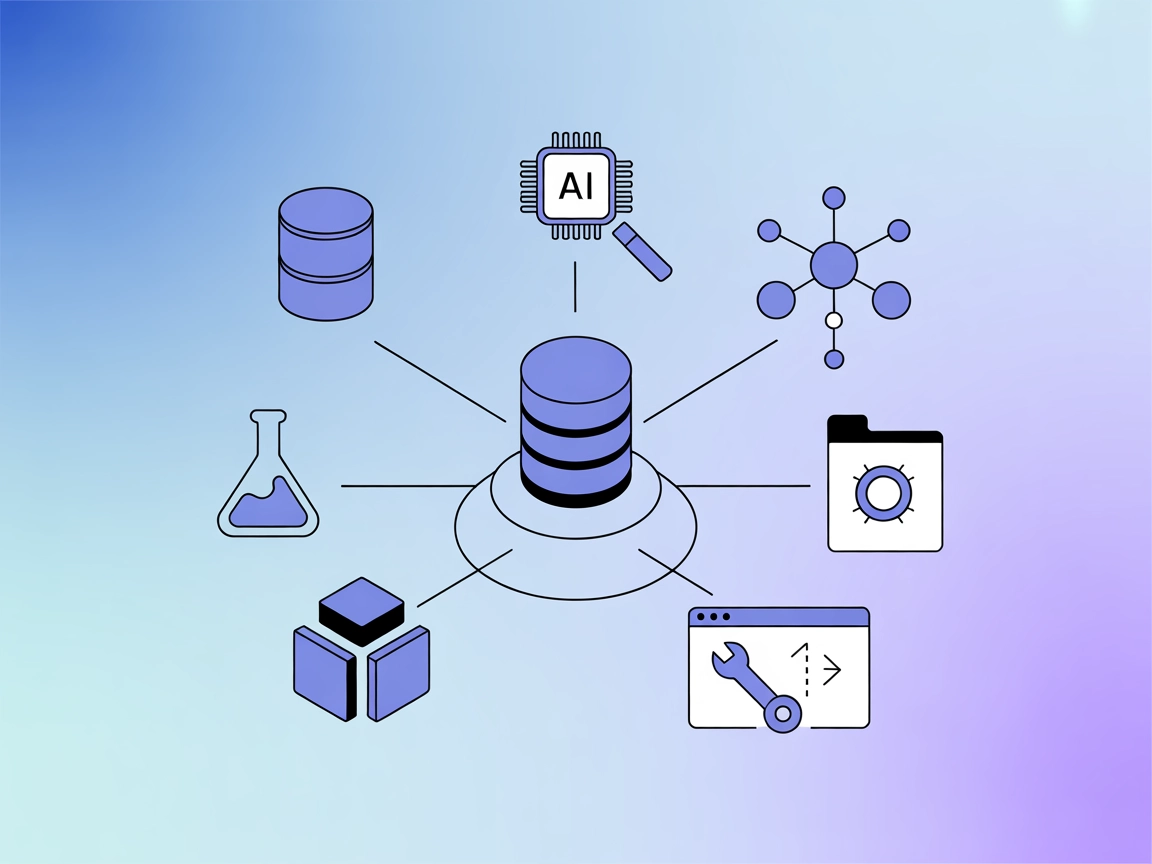

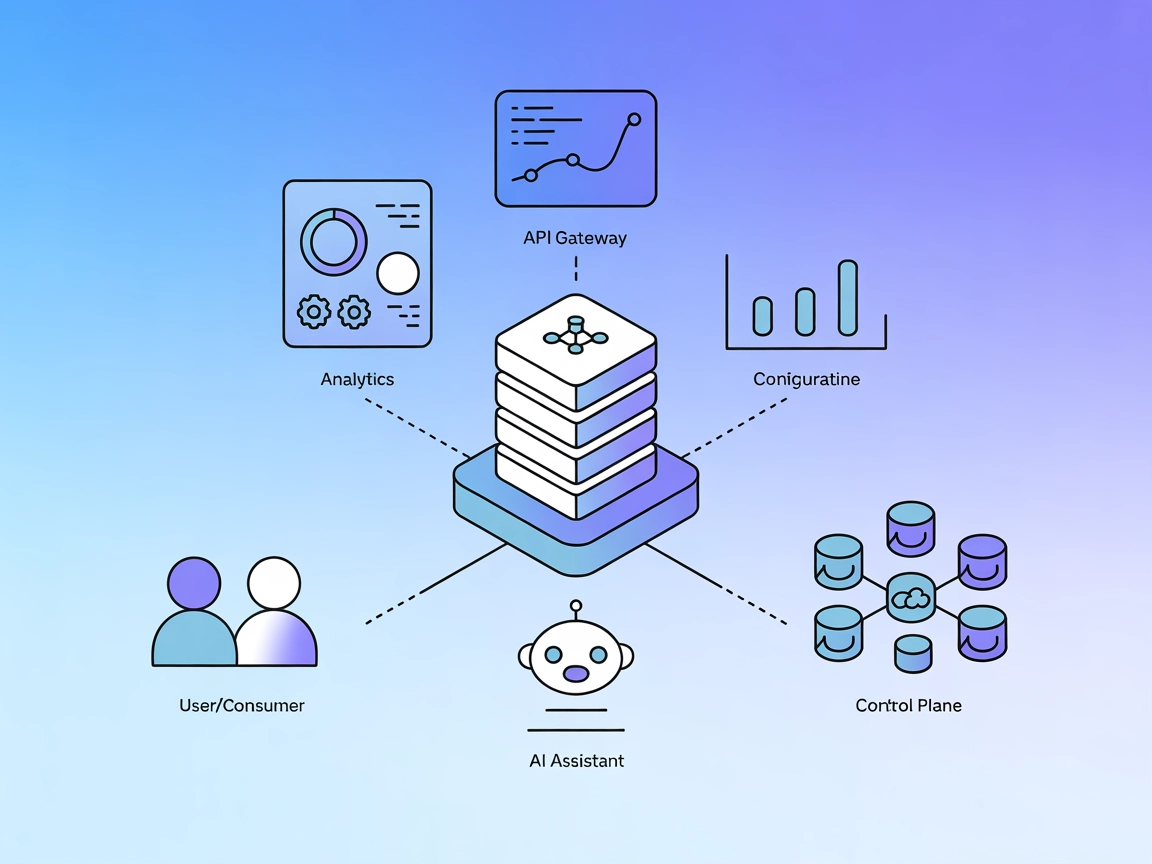

Serwer Kong Konnect MCP integruje asystentów AI z API Gateway Kong Konnect, umożliwiając zapytania w języku naturalnym dotyczące analityki, konfiguracji i zarzą...

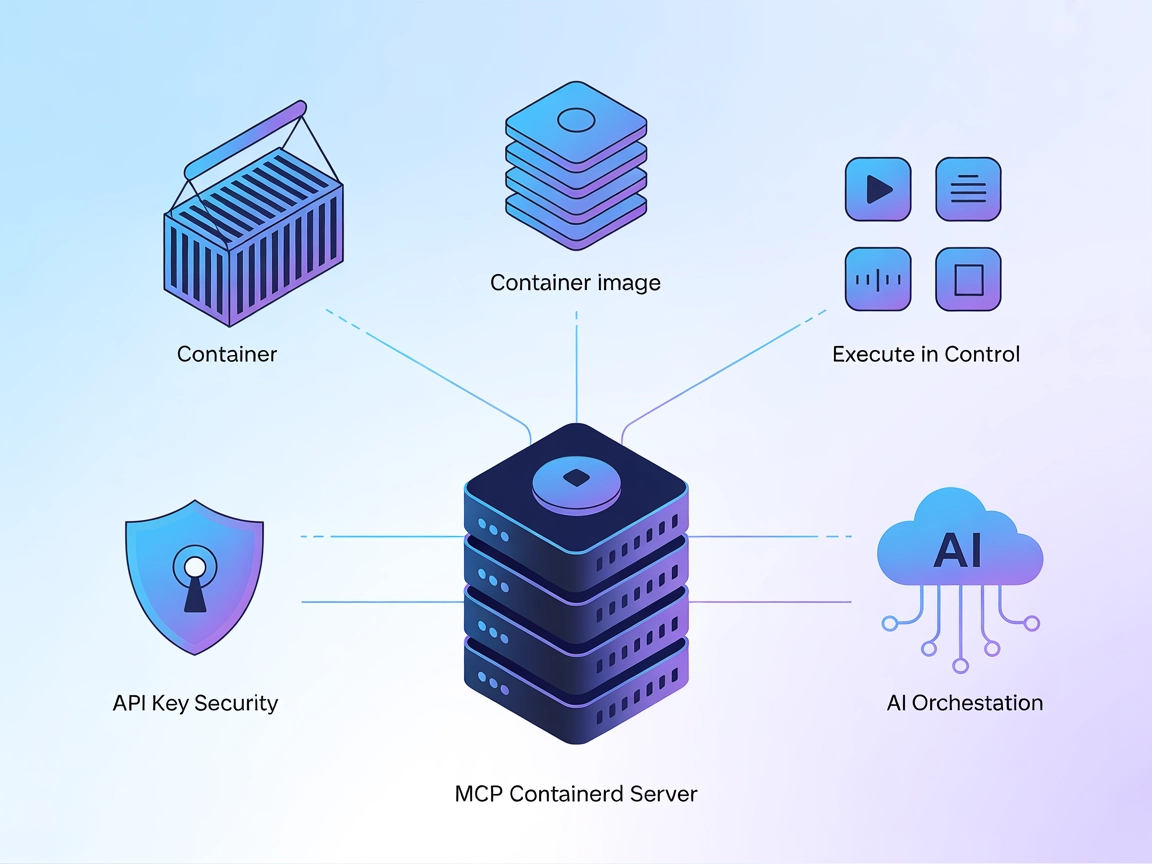

Serwer MCP Containerd łączy środowisko uruchomieniowe Containerd z protokołem Model Context Protocol (MCP), umożliwiając agentom AI i automatycznym przepływom p...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.