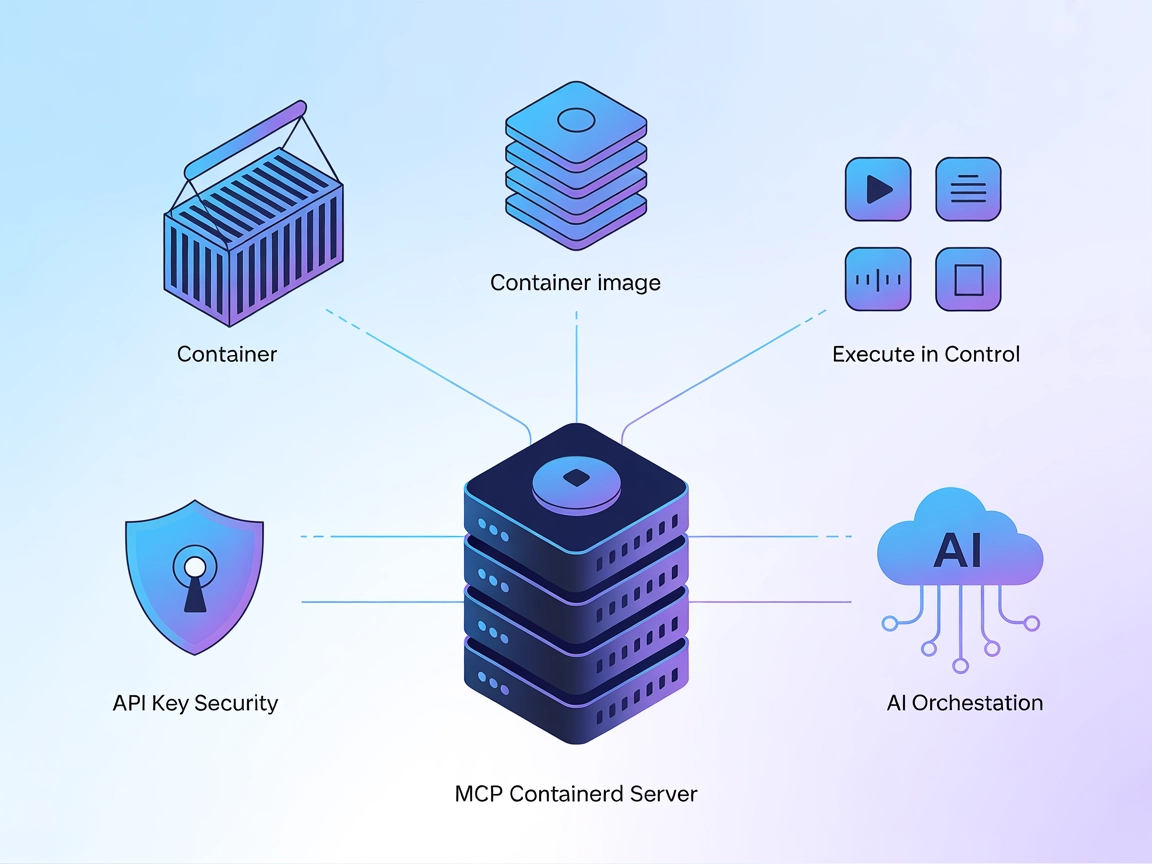

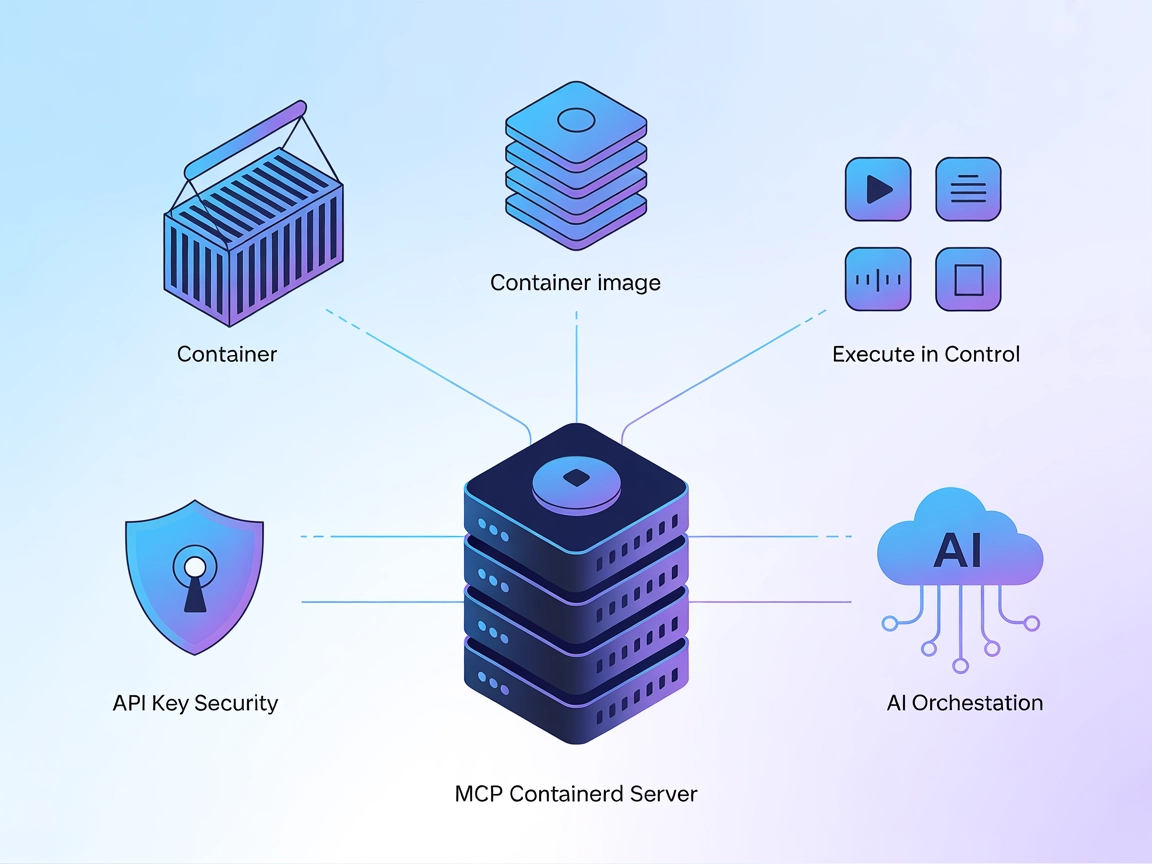

Serveur MCP Containerd

Le serveur MCP Containerd fait le lien entre le runtime de Containerd et le Model Context Protocol (MCP), permettant aux agents IA et aux workflows d'automatisa...

Boostez vos assistants IA avec une mémoire spécifique au projet. ConPort stocke et récupère le contexte structuré du projet, permettant des flux IA plus intelligents et contextuels dans FlowHunt et les IDE.

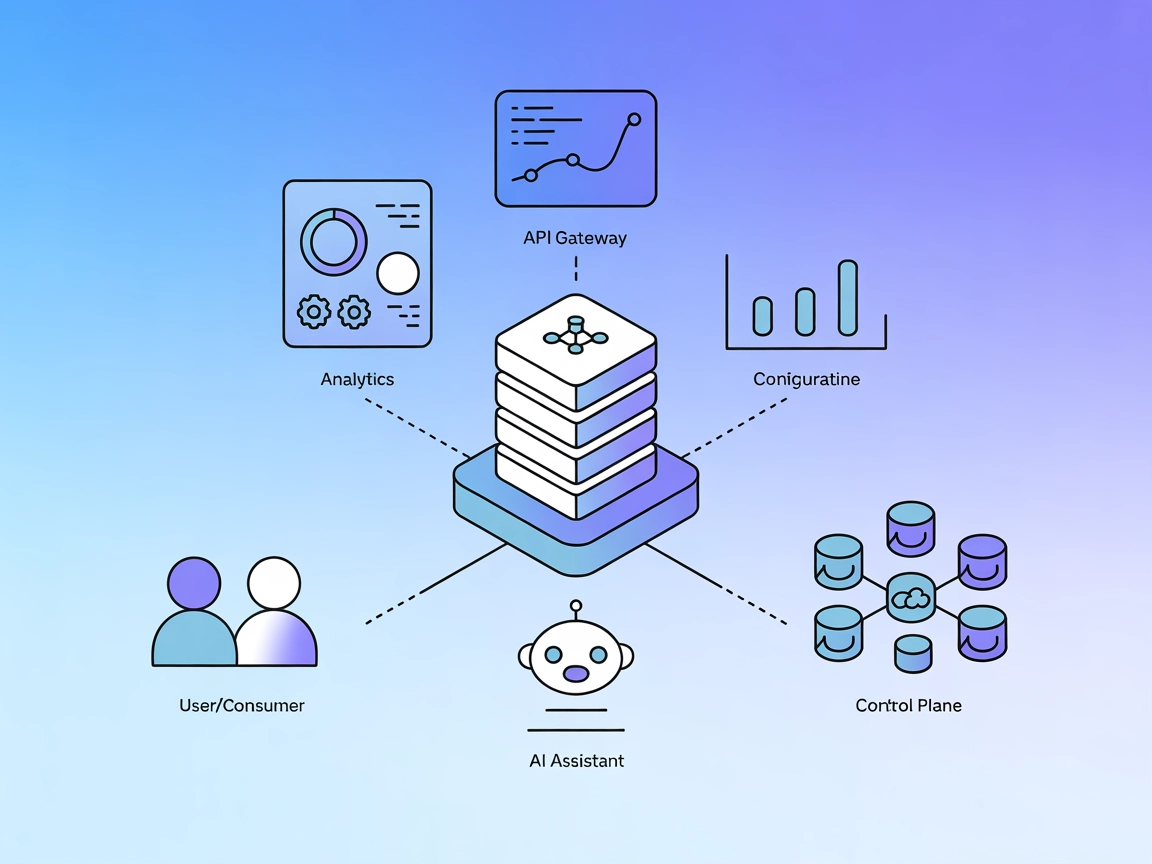

FlowHunt fournit une couche de sécurité supplémentaire entre vos systèmes internes et les outils d'IA, vous donnant un contrôle granulaire sur les outils accessibles depuis vos serveurs MCP. Les serveurs MCP hébergés dans notre infrastructure peuvent être intégrés de manière transparente avec le chatbot de FlowHunt ainsi qu'avec les plateformes d'IA populaires comme ChatGPT, Claude et divers éditeurs d'IA.

Context Portal (ConPort) est un serveur MCP mémoire conçu pour renforcer les assistants IA et les outils pour développeurs dans les IDE en gérant le contexte structuré du projet. Agissant comme un graphe de connaissances propre au projet, ConPort permet une génération augmentée par récupération (RAG) puissante, offrant à l’IA un accès rapide et pertinent à l’information projet. Il stocke des données importantes telles que décisions, tâches, avancement, modèles architecturaux, glossaires et spécifications de façon structurée. Cela aide les assistants IA à fournir des réponses plus précises et contextuelles, et à améliorer les workflows de développement en rendant la connaissance projet facilement exploitable et actionnable.

Aucun modèle de prompt n’est mentionné dans les fichiers du dépôt ou la documentation disponible.

Aucune ressource MCP explicite n’est listée dans les fichiers du dépôt ou la documentation disponible.

Aucun outil spécifique n’est décrit ou listé dans server.py ou d’autres fichiers serveur du dépôt ou de la documentation.

Gestion des connaissances projet

Stockez et récupérez les décisions clés du projet, glossaires, spécifications et modèles architecturaux, pour permettre à l’assistant IA d’apporter un accompagnement et un contexte adaptés à chaque projet.

Assistance au codage IA contextuelle

Permettez aux assistants IA dans les IDE d’accéder à la mémoire structurée du projet, pour améliorer suggestions de code et explications en s’appuyant sur l’historique et la terminologie du projet.

Génération augmentée par récupération (RAG)

Améliorez les assistants LLM en leur fournissant des données projet actualisées et pertinentes pour des réponses plus précises et riches en contexte.

Suivi d’avancement projet

Gardez une trace structurée des tâches terminées, des problèmes en cours et du travail restant, afin que les agents IA puissent synthétiser ou rapporter l’état d’avancement du projet.

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

Sécurisation des clés API :

Pour fournir vos clés API de façon sécurisée, utilisez des variables d’environnement. Voici un exemple d’inclusion dans votre configuration :

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"],

"env": {

"CONPORT_API_KEY": "${CONPORT_API_KEY}"

},

"inputs": {

"apiKey": "${CONPORT_API_KEY}"

}

}

}

}

Utiliser le MCP dans FlowHunt

Pour intégrer des serveurs MCP dans votre workflow FlowHunt, commencez par ajouter le composant MCP à votre flux puis connectez-le à votre agent IA :

Cliquez sur le composant MCP pour ouvrir le panneau de configuration. Dans la section de configuration MCP système, renseignez les détails de votre serveur MCP à l’aide de ce format JSON :

{

"context-portal": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

Une fois configuré, l’agent IA pourra utiliser ce MCP comme outil et accéder à toutes ses fonctions et capacités. Pensez à adapter “context-portal” selon le nom réel de votre serveur MCP et à remplacer l’URL par la vôtre.

| Section | Disponibilité | Détails/Remarques |

|---|---|---|

| Vue d’ensemble | ✅ | |

| Liste des prompts | ⛔ | Aucun modèle de prompt trouvé |

| Liste des ressources | ⛔ | Aucune ressource explicite listée |

| Liste des outils | ⛔ | Aucun outil listé dans la logique |

| Sécurisation des clés API | ✅ | Exemple d’utilisation des env vars |

| Support des racines | ⛔ | Non précisé |

| Support du sampling (moins important ici) | ⛔ | Non précisé |

Context Portal MCP (ConPort) offre une vue d’ensemble claire et des cas d’usage bien définis, mais il manque une documentation technique détaillée sur les prompts, outils et ressources dans les fichiers publics disponibles. Les instructions d’installation et la gestion des clés API sont appréciables. Son utilité est évidente, mais des détails serveur plus poussés augmenteraient sa note.

Évaluation MCP : 6/10

| Dispose d’une LICENCE | ✅ (Apache-2.0) |

|---|---|

| Dispose d’au moins un outil | ⛔ |

| Nombre de Forks | 47 |

| Nombre d’étoiles | 352 |

Donnez à votre équipe de développement une IA contextuelle en intégrant le serveur MCP Context Portal. Simplifiez la gestion des connaissances projet et améliorez les flux de travail pilotés par l’IA.

Le serveur MCP Containerd fait le lien entre le runtime de Containerd et le Model Context Protocol (MCP), permettant aux agents IA et aux workflows d'automatisa...

Découvrez ce que sont les serveurs MCP (Model Context Protocol), comment ils fonctionnent et pourquoi ils révolutionnent l'intégration de l'IA. Découvrez commen...

Le serveur Kong Konnect MCP intègre des assistants IA avec la passerelle API de Kong Konnect, permettant des requêtes en langage naturel pour l’analytique, la c...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.