Serverul Protocolului de Context al Modelului (MCP)

Serverul Protocolului de Context al Modelului (MCP) face legătura între asistenții AI și surse de date externe, API-uri și servicii, permițând integrarea facilă...

Îmbunătățește-ți asistenții AI cu memorie specifică proiectului. ConPort stochează și recuperează context structurat al proiectului, permițând fluxuri de lucru AI mai inteligente și conștiente de context în FlowHunt și IDE-uri.

FlowHunt oferă un strat suplimentar de securitate între sistemele dvs. interne și instrumentele AI, oferindu-vă control granular asupra instrumentelor care sunt accesibile de la serverele dvs. MCP. Serverele MCP găzduite în infrastructura noastră pot fi integrate fără probleme cu chatbotul FlowHunt, precum și cu platforme AI populare precum ChatGPT, Claude și diverși editori AI.

Context Portal (ConPort) este un server MCP de tip bancă de memorie proiectat pentru a îmbunătăți asistenții AI și uneltele pentru dezvoltatori în cadrul IDE-urilor prin gestionarea contextului structurat al proiectului. Acționând ca un knowledge graph specific proiectului, ConPort permite Retrieval Augmented Generation (RAG) puternic, permițând AI-ului să acceseze rapid și să utilizeze informații relevante despre proiect. Stochează date importante ale proiectului, precum decizii, task-uri, progres, modele arhitecturale, glosare și specificații într-un mod structurat. Acest lucru ajută asistenții AI să ofere răspunsuri mai exacte și conștiente de context, îmbunătățind fluxurile de dezvoltare prin transformarea cunoștințelor de proiect în informații ușor de căutat și folosit.

Nu sunt menționate template-uri de prompt în fișierele repository-ului disponibil sau în documentație.

Nu sunt listate resurse MCP explicite în fișierele repository-ului disponibil sau în documentație.

Nu sunt descrise sau listate unelte specifice din server.py sau alte logici de server în fișierele repository-ului disponibil sau în documentație.

Managementul cunoștințelor de proiect

Stochează și recuperează decizii cheie de proiect, glosare, specificații și modele arhitecturale, permițând asistenților AI să ofere ghidaj și context specific proiectului.

Asistență AI contextuală pentru codare

Permite asistenților AI din IDE-uri să acceseze memoria structurată a proiectului, îmbunătățind sugestiile de cod și explicațiile prin valorificarea istoricului și terminologiei proiectului.

Retrieval Augmented Generation (RAG)

Îmbunătățește asistenții bazați pe LLM, oferindu-le date de proiect actualizate și relevante pentru răspunsuri mai precise și bogate în context.

Monitorizarea progresului proiectului

Păstrează o evidență structurată a task-urilor finalizate, problemelor nerezolvate și a lucrului în curs, astfel încât agenții AI să poată sumariza sau raporta starea proiectului.

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"]

}

}

}

Securizarea cheilor API:

Pentru a furniza în siguranță cheile API, folosește variabile de mediu. Iată un exemplu despre cum să le incluzi în configurație:

{

"mcpServers": {

"context-portal": {

"command": "npx",

"args": ["@context-portal/mcp-server@latest"],

"env": {

"CONPORT_API_KEY": "${CONPORT_API_KEY}"

},

"inputs": {

"apiKey": "${CONPORT_API_KEY}"

}

}

}

}

Folosirea MCP în FlowHunt

Pentru a integra serverele MCP în workflow-ul tău FlowHunt, începe prin a adăuga componenta MCP în flow și conecteaz-o la agentul tău AI:

Fă click pe componenta MCP pentru a deschide panoul de configurare. În secțiunea de configurare MCP de sistem, inserează detaliile serverului MCP folosind acest format JSON:

{

"context-portal": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

După configurare, agentul AI poate folosi acest MCP ca un instrument cu acces la toate funcțiile și capabilitățile sale. Nu uita să schimbi “context-portal” cu numele real al serverului tău MCP și să înlocuiești URL-ul cu cel al serverului tău MCP.

| Secțiune | Disponibilitate | Detalii/Note |

|---|---|---|

| Prezentare generală | ✅ | |

| Lista de Prompts | ⛔ | Nu au fost găsite template-uri |

| Lista de Resurse | ⛔ | Nu sunt listate resurse explicite |

| Lista de Unelte | ⛔ | Nu sunt listate unelte în logica serverului |

| Securizarea cheilor API | ✅ | Exemplu pentru variabile de mediu inclus |

| Suport pentru Roots | ⛔ | Nespecificat |

| Suport pentru Sampling (mai puțin relevant) | ⛔ | Nespecificat |

Context Portal MCP (ConPort) oferă o imagine clară și cazuri de utilizare bine definite, dar nu conține documentație tehnică explicită pentru prompts, unelte și resurse în fișierele publice disponibile. Instrucțiunile de configurare și ghidajul pentru chei API sunt utile. Per ansamblu, utilitatea sa este evidentă, dar detaliile suplimentare despre server ar îmbunătăți scorul.

Evaluare tabel MCP: 6/10

| Are o LICENȚĂ | ✅ (Apache-2.0) |

|---|---|

| Are cel puțin o unealtă | ⛔ |

| Număr de Fork-uri | 47 |

| Număr de Stele | 352 |

Context Portal este un server MCP de tip bancă de memorie care gestionează contextul structurat al proiectului pentru asistenți AI și unelte pentru dezvoltatori. Acționează ca un knowledge graph specific proiectului, permițând Retrieval Augmented Generation (RAG) și funcții AI conștiente de context.

ConPort este utilizat pentru managementul cunoștințelor de proiect, asistență AI contextuală pentru codare, Retrieval Augmented Generation (RAG) și monitorizarea progresului proiectului în fluxurile de lucru de dezvoltare.

Folosește variabile de mediu pentru a furniza în siguranță cheile API în configurația serverului MCP. De exemplu: { "env": { "CONPORT_API_KEY": "${CONPORT_API_KEY}" }, "inputs": { "apiKey": "${CONPORT_API_KEY}" } }

Adaugă componenta MCP în flow-ul tău FlowHunt, conecteaz-o la agentul tău AI și specifică detaliile serverului ConPort MCP în panoul de configurare folosind formatul JSON furnizat. Acest lucru permite agentului AI să acceseze context și memorie de proiect structurate.

Nu sunt menționate template-uri de prompt sau unelte încorporate în documentația disponibilă sau logica serverului. Funcția sa principală este stocarea și regăsirea contextului structurat pentru augmentarea AI specifică proiectului.

Oferă echipei tale de dezvoltare AI conștient de context prin integrarea serverului Context Portal MCP. Simplifică gestionarea cunoștințelor de proiect și îmbunătățește fluxurile de lucru de codare asistate de AI.

Serverul Protocolului de Context al Modelului (MCP) face legătura între asistenții AI și surse de date externe, API-uri și servicii, permițând integrarea facilă...

Integrează-ți asistenții AI cu API-ul JFrog Platform folosind serverul JFrog MCP. Automatizează gestionarea depozitelor, urmărirea build-urilor, monitorizarea î...

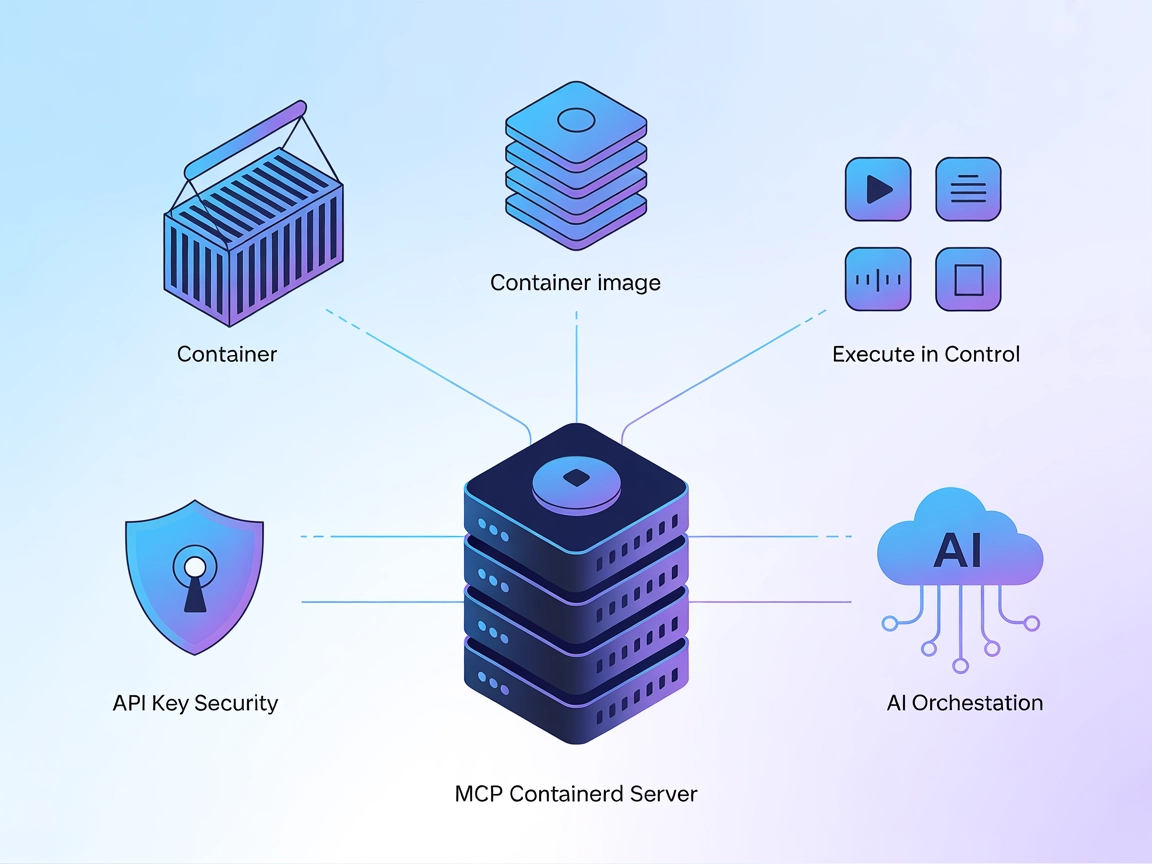

Serverul MCP Containerd face legătura dintre runtime-ul Containerd și Model Context Protocol (MCP), permițând agenților AI și fluxurilor de automatizare să gest...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.