Cách o1 Preview của OpenAI Chinh Phục Những Đề Bài Viết Phức Tạp

Khám phá cách o1 Preview của OpenAI vượt trội hơn GPT-4 khi chinh phục các đề bài viết phức tạp thông qua lập kế hoạch nội bộ, sáng tạo và tuân thủ các ràng buộ...

OpenAI O1 tận dụng học tăng cường và khả năng lý luận chuỗi suy nghĩ gốc để vượt mặt GPT4o trong các tác vụ RAG phức tạp, dù chi phí cao hơn.

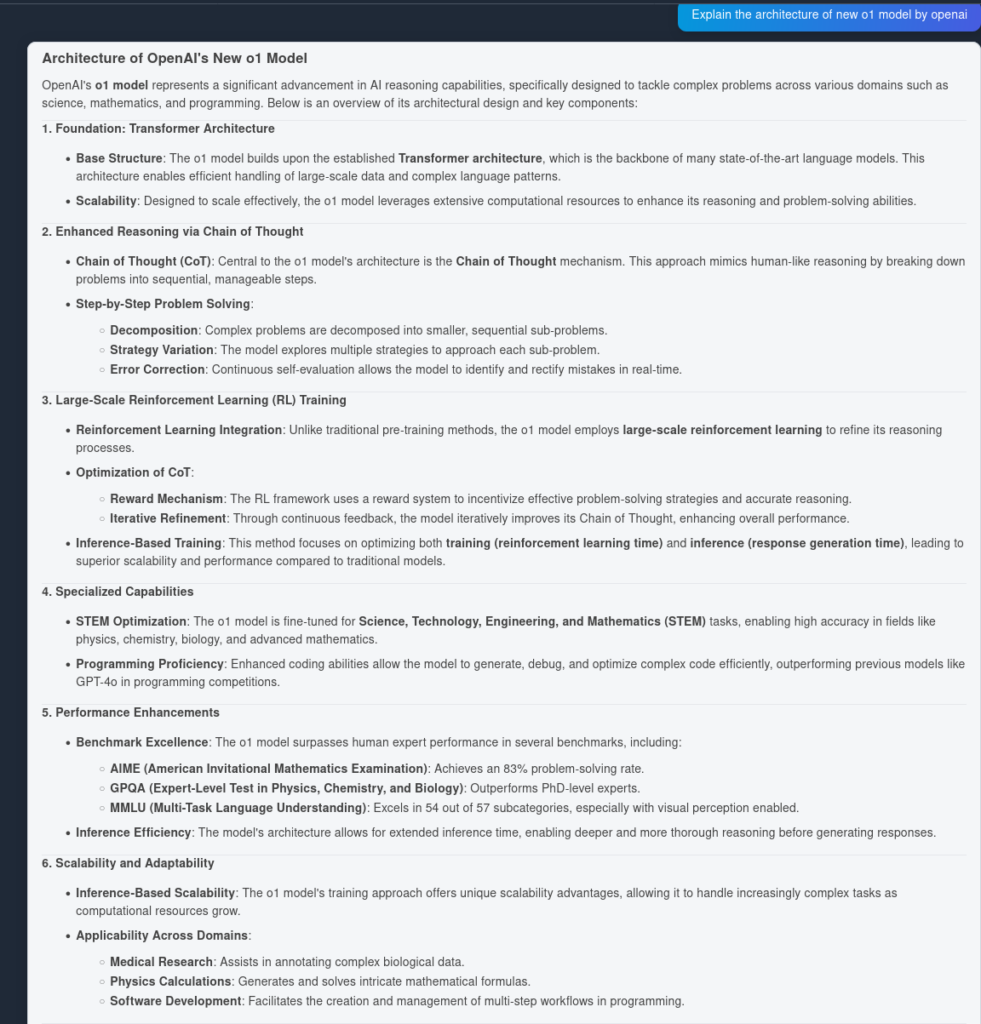

OpenAI vừa ra mắt một mô hình mới mang tên OpenAI O1 thuộc dòng O1. Thay đổi chính về kiến trúc ở các mô hình này là khả năng “suy nghĩ” trước khi trả lời câu hỏi của người dùng. Trong bài viết này, chúng ta sẽ đi sâu vào các thay đổi then chốt của OpenAI O1, những cách tiếp cận mới mà các mô hình này sử dụng, và lý do vì sao mô hình này có thể tăng đáng kể độ chính xác của RAG. Chúng tôi sẽ so sánh một flow RAG đơn giản sử dụng OpenAI GPT4o và OpenAI O1.

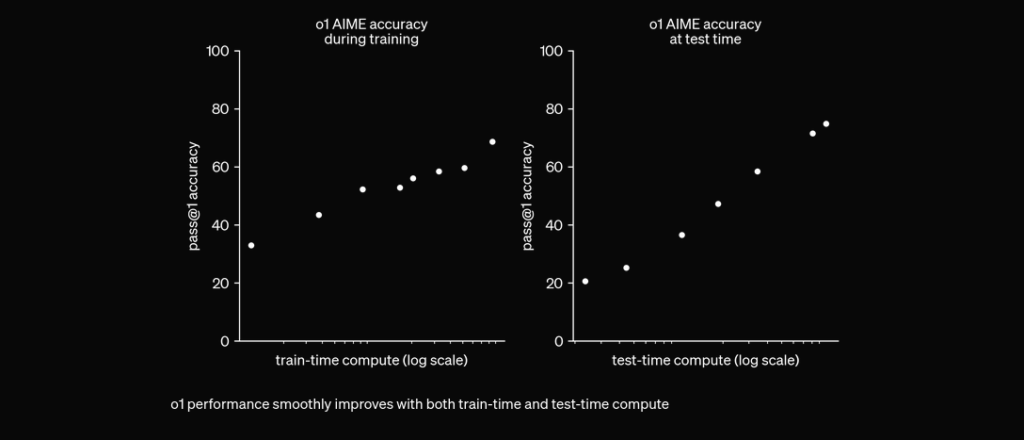

Mô hình O1 tận dụng các thuật toán học tăng cường quy mô lớn trong quá trình huấn luyện. Điều này giúp mô hình phát triển “Chuỗi suy nghĩ” vững chắc, cho phép suy nghĩ sâu và chiến lược hơn về các vấn đề. Bằng cách liên tục tối ưu hóa đường suy luận của mình qua học tăng cường, O1 cải thiện đáng kể khả năng phân tích và giải quyết các tác vụ phức tạp một cách hiệu quả.

Trước đây, chuỗi suy nghĩ đã được chứng minh là một kỹ thuật nhắc lệnh hiệu quả giúp LLM “tự suy nghĩ” và trả lời các câu hỏi phức tạp theo từng bước một. Với các mô hình O1, bước này đã được tích hợp sẵn trong mô hình khi suy luận, cực kỳ hữu ích cho các bài toán toán học và lập trình.

O1 được huấn luyện với RL để “suy nghĩ” trước khi trả lời qua chuỗi suy nghĩ riêng tư. Càng suy nghĩ lâu, khả năng lý luận càng tốt. Điều này mở ra một khía cạnh mới cho việc mở rộng quy mô. Không còn bị giới hạn bởi tiền huấn luyện. Chúng ta có thể mở rộng cả tính toán suy luận. pic.twitter.com/niqRO9hhg1

— Noam Brown (@polynoamial) 12 tháng 9, 2024

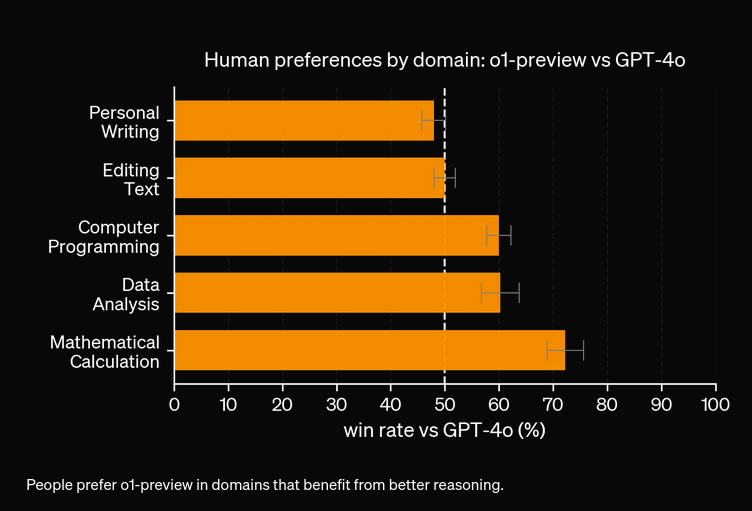

Qua các thử nghiệm rộng rãi, O1 đã thể hiện hiệu suất xuất sắc trên nhiều chỉ số đánh giá:

Để kiểm tra độ chính xác của OpenAI O1 và GPT4o, chúng tôi đã tạo hai flow giống hệt nhau nhưng dùng hai LLM khác nhau. Chúng ta sẽ so sánh khả năng trả lời câu hỏi của các mô hình dựa trên hai nguồn tài liệu đã được lập chỉ mục về báo cáo kỹ thuật của OpenAI O1.

Đầu tiên, chúng tôi tạo một flow RAG đơn giản trên FlowHunt. Flow gồm Chat Input, Document Retriever (truy xuất tài liệu liên quan), Prompt, Generator và Chat Output. Thành phần LLM OpenAI được thêm để chỉ định mô hình (mặc định là GPT4o nếu không chỉ rõ).

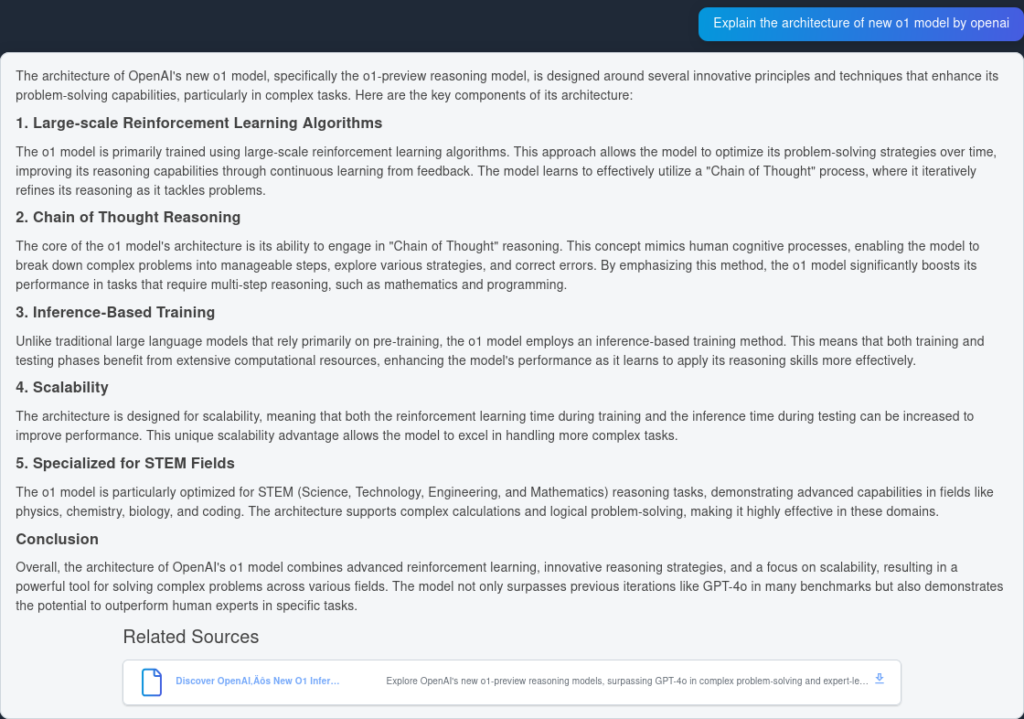

Đây là phản hồi từ GPT4o:

Và đây là kết quả từ OpenAI O1:

Như bạn thấy, OpenAI O1 đã nắm bắt nhiều lợi thế kiến trúc hơn từ bài viết—6 điểm so với 4 điểm của GPT4o. Ngoài ra, O1 còn đưa ra các suy luận logic từ từng điểm, làm giàu cho tài liệu với những phân tích sâu hơn về giá trị của thay đổi kiến trúc.

Qua thử nghiệm, mô hình O1 sẽ có chi phí cao hơn để đổi lại độ chính xác tăng lên. Mô hình mới có 3 loại token: Prompt Token, Completion Token, và Reason Token (loại token mới bổ sung), dẫn tới khả năng chi phí vận hành cao hơn. Trong đa số trường hợp, OpenAI O1 cho ra đáp án hữu ích hơn nếu dựa trên sự thật. Tuy nhiên, vẫn có trường hợp GPT4o vượt trội hơn O1—một số tác vụ đơn giản không cần lý luận.

Yasha là một nhà phát triển phần mềm tài năng, chuyên về Python, Java và học máy. Yasha viết các bài báo kỹ thuật về AI, kỹ thuật prompt và phát triển chatbot.

Trải nghiệm FlowHunt để tận dụng các LLM mới nhất như OpenAI O1 và GPT4o cho lý luận vượt trội và sinh kết quả tăng cường truy xuất.

Khám phá cách o1 Preview của OpenAI vượt trội hơn GPT-4 khi chinh phục các đề bài viết phức tạp thông qua lập kế hoạch nội bộ, sáng tạo và tuân thủ các ràng buộ...

Phân tích chuyên sâu về mô hình suy luận EXAONE Deep 32B của LG được kiểm tra đối đầu với DeepSeek R1 và QwQ của Alibaba, xem xét các tuyên bố về hiệu suất vượt...

GPT-4.1 của OpenAI đánh dấu một bước nhảy vọt lớn về hiệu suất AI. Bài viết này phân tích điểm mạnh và hạn chế của nó qua năm nhiệm vụ AI cốt lõi—tạo nội dung, ...

Đồng Ý Cookie

Chúng tôi sử dụng cookie để cải thiện trải nghiệm duyệt web của bạn và phân tích lưu lượng truy cập của mình. See our privacy policy.