Slack-Integration

Die Slack-Integration von FlowHunt ermöglicht nahtlose KI-Zusammenarbeit direkt in deinem Slack-Workspace. Bringe beliebige Flows in Slack, automatisiere Workfl...

Verbinden Sie jedes LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) mit Slack über den No-Code-Flow-Builder von FlowHunt. Das Setup ist für jedes Modell identisch – wählen Sie das passende Modell für Ihren Anwendungsfall und gehen Sie in Minuten live.

Einen KI-Assistenten in Slack einzubauen bedeutete früher: einen Anbieter wählen, Integrationscode schreiben und alles neu bauen, sobald sechs Monate später ein besseres Modell erscheint. Mit FlowHunt sind Integration und Modell entkoppelt: Sie bauen den Slack-Flow einmal, stecken das LLM Ihrer Wahl ein – Claude, GPT, Gemini, Grok, Llama, Mistral – und tauschen es jederzeit aus, ohne den Rest anzufassen.

Diese Anleitung führt durch das gesamte Setup. Die erste Hälfte ist für jedes Modell identisch. Die zweite Hälfte erklärt, welches Modell für welchen Anwendungsfall passt, mit Hinweisen pro LLM-Familie. Springen Sie zum passenden Abschnitt oder lesen Sie von Anfang an.

Slack ist der Ort, an dem Teams Fragen stellen. Ein KI-Agent dort beantwortet sie sofort – ohne Wechsel zu einem separaten Chat-Tool, Dashboard oder einer Knowledge Base. Häufige Einsatzfälle:

Der Bot lebt in Slack – die Akzeptanz ist automatisch, niemand muss ein neues Tool lernen.

Das Setup ist identisch, unabhängig vom gewählten KI-Modell. Wählen Sie Ihr Modell in Schritt 4; alles andere bleibt gleich.

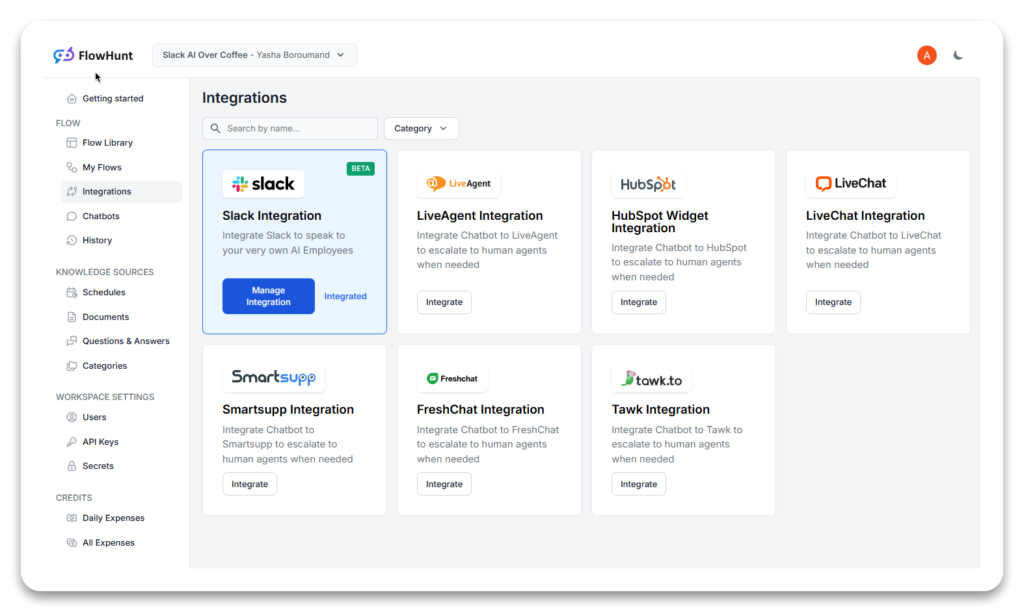

Melden Sie sich bei FlowHunt an und öffnen Sie den Tab Integrations. Wählen Sie Slack, klicken Sie auf Connect und autorisieren Sie die App auf der OAuth-Seite von Slack. Erteilen Sie die von FlowHunt angeforderten Lese-/Schreibberechtigungen – damit kann der Bot Nachrichten empfangen und Antworten in Ihrem Workspace posten.

Ihre Workspace-URL finden Sie oben links in der Slack-Desktop- oder Web-App. Sobald autorisiert, ist Slack verbunden und in jedem Flow nutzbar.

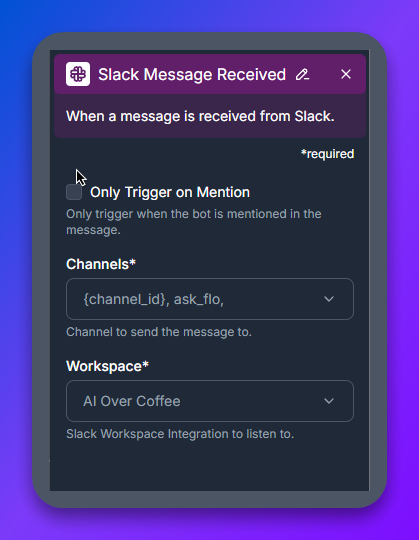

Im FlowHunt-Flow-Builder ziehen Sie die Komponente Slack Message Received auf die Arbeitsfläche. Dieser Block lauscht auf eingehende Slack-Nachrichten und löst den Rest des Flows aus.

Konfigurieren Sie zwei Einstellungen:

#ai-assistant-Kanal ist die sauberste Lösung.

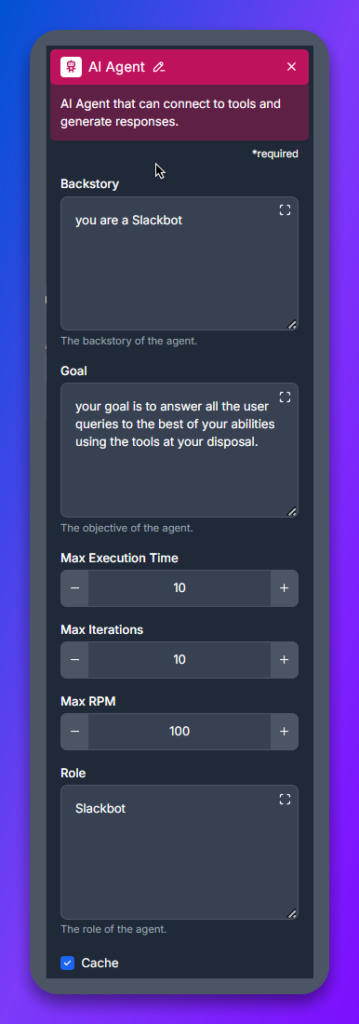

Der AI Agent-Block ist die Reasoning-Schicht des Bots. Er nimmt die Nachricht des Nutzers, entscheidet, welche Tools verwendet werden, und formuliert die Antwort.

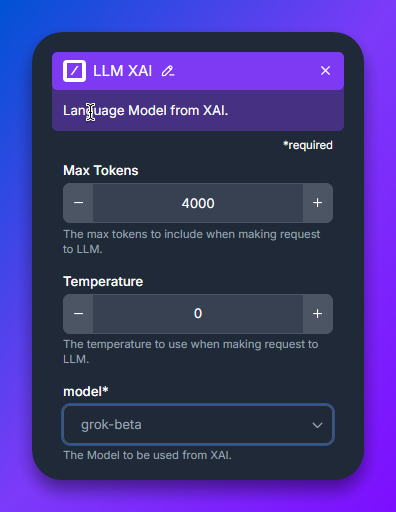

Verbinden Sie eine LLM-Komponente mit dem AI Agent. Hier wählen Sie, welches KI-Modell den Bot antreibt. FlowHunt hat eine separate LLM-Komponente pro Anbieter – LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI – und in jeder wählen Sie die genaue Modellvariante.

Dies ist der einzige modellabhängige Schritt. Springen Sie zu Das richtige KI-Modell wählen für einen Vergleich und Hinweise pro Familie.

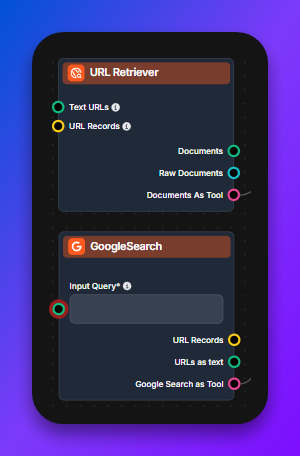

Der AI Agent wird deutlich nützlicher, wenn er Tools nutzen kann. Häufige Tools:

Tools sind modellunabhängig. Jedes in Schritt 4 gewählte LLM kann jedes verdrahtete Tool verwenden.

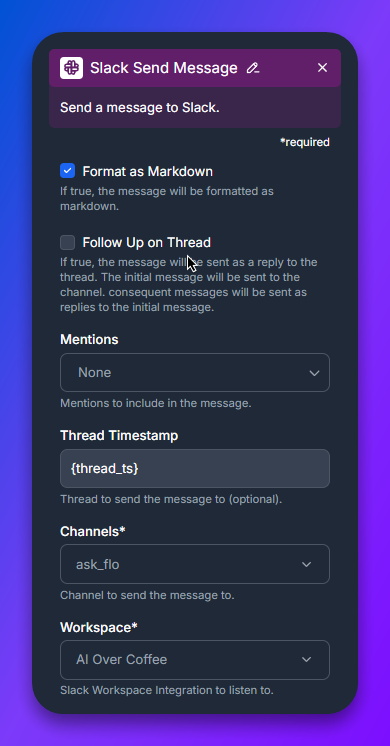

Schließen Sie den Flow mit einer Slack Send Message-Komponente ab, konfiguriert für denselben Kanal und Workspace wie in Schritt 2. Speichern Sie den Flow, öffnen Sie Slack und @-erwähnen Sie den Bot in Ihrem Test-Kanal. Der Bot sollte mit dem in Schritt 4 gewählten Modell antworten.

Das ist das gesamte Setup. Modellwechsel später ist eine Ein-Klick-Änderung in Schritt 4 – keine Code-Änderungen, kein Flow-Neubau.

Jede große LLM-Familie funktioniert in FlowHunts Slack-Flow. Die Unterschiede liegen in Kosten, Latenz, Kontextfenster, Reasoning-Tiefe und Tool-Calling-Qualität. Verwenden Sie die Tabelle zum Eingrenzen, dann lesen Sie den familienspezifischen Abschnitt für Setup-Hinweise.

| Modellfamilie | Stärken | Latenz | Kosten | Hinweise |

|---|---|---|---|---|

| Claude (Anthropic) | Long-Context-Analyse, sorgfältiges Reasoning, Code-Review | Mittel | Mittel–Hoch | Folgt nuancierten Anweisungen sehr gut; ideal für interne Q&A über Dokumente |

| GPT / o-Serie (OpenAI) | Allzweck, breites Tool-Ökosystem, multimodal | Niedrig–Mittel | Niedrig (Mini) – Hoch (o-Serie) | GPT-4o Mini ist der Standard-Sweetspot; o1/o3 für harte Reasoning-Aufgaben |

| Gemini (Google) | Riesige Kontextfenster, schnell, multimodal, Web-grounded | Niedrig | Niedrig–Mittel | 1.5 Pro verarbeitet 1M+ Tokens; ideal für Whole-Doc-Slack-Q&A |

| Grok (xAI) | Echtzeit-/News-Wissen, X (Twitter)-Daten, lockerer Ton | Niedrig | Mittel | Beste Wahl, wenn der Bot aktuelles Wissen braucht |

| Llama (Meta) | Self-Hosting / private Deployments, kostensensitive Workloads | Hostingabhängig | Niedrig (self-hosted) | Open Weights – wenn Datenresidenz wichtig ist |

| Mistral | Open-Weight, gute Kosten/Qualität, EU-freundliches Hosting | Niedrig | Niedrig–Mittel | Mistral Large konkurriert mit GPT-4o zu niedrigeren Kosten |

Wählen Sie eines, um zu starten. Modellwechsel in FlowHunt ist eine Ein-Klick-Änderung in der LLM-Komponente, daher lohnt sich Overthinking nicht – mit sinnvoller Default-Wahl ausliefern, Qualität an echtem Slack-Traffic messen, iterieren.

Jeder Abschnitt unten ist eigenständig. Wählen Sie den Abschnitt für die Modellfamilie, die Sie verbinden, und folgen Sie den Hinweisen.

Claude ist Anthropics LLM-Familie, ideal für Slackbots, die nuancierte interne Q&A, Dokumentzusammenfassung, Code-Review und sorgfältige Anweisungsbefolgung übernehmen. Um Claude an Slack anzubinden, ziehen Sie in Schritt 4 die Komponente LLM Anthropic und wählen Sie die Variante:

Für interne Knowledge-Base-Slackbots über Notion oder Confluence ist Claude 3.5 Sonnet plus Document Retriever der zuverlässigste Startpunkt.

OpenAIs GPT- und o-Serie-Modelle sind die breiteste Wahl für Slack – starke Allzweck-Performance, das ausgereifteste Tool-Calling und multimodaler Input (Vision, Audio). Ziehen Sie in Schritt 4 die Komponente LLM OpenAI und wählen Sie die Variante:

Für die meisten Teams: mit GPT-4o Mini starten. Auf GPT-4o oder o1 nur dort hochstufen, wo Nutzer über Antwortqualität klagen.

Google Gemini ist die stärkste Wahl, wenn das Kontextfenster zählt – Gemini 1.5 Pro verarbeitet über 1M Tokens, genug, um ganze Codebasen oder Dokumentensätze in eine einzige Slack-Anfrage zu packen. Ziehen Sie in Schritt 4 die Komponente LLM Google und wählen Sie die Variante:

Wenn Ihr Slackbot über Ihre gesamte Wissensbasis in einem Durchgang nachdenken soll (kein Retrieval-Schritt), ist Geminis Pro-Kontextfenster die sauberste Antwort.

xAI Grok wird in FlowHunts Slack-Flow genauso eingebunden wie die anderen Modelle – ziehen Sie die Komponente LLM xAI (oder die LLM-OpenAI-Komponente, je nach FlowHunt-Version) und wählen Sie die Grok-Variante. Groks Stärke ist Echtzeit-Wissen – Zugriff auf Live-Informationen einschließlich X-(Twitter)-Daten – ideal, wenn der Slackbot aktuelle Kontexte braucht: Nachrichten, Marktdaten, Breaking News. Kombinieren Sie es mit dem Google Search Tool für noch breiteren Web-Zugriff.

Metas Llama-Familie ist die Open-Weight-Option – nutzen Sie sie, wenn Datenresidenz, Self-Hosting oder Kosten pro Token Hosted-APIs ausschließen. Ziehen Sie in Schritt 4 die Komponente LLM Meta und wählen Sie die Variante:

Llama ist die richtige Antwort, wenn Security oder Compliance verlangen, dass das Modell auf eigener Infrastruktur läuft, oder wenn hohe Nachrichtenmengen Hosted-API-Kosten unwirtschaftlich machen.

Mistral ist der europäische Open-Weight-Konkurrent – starke Modelle, EU-freundliches Hosting, gutes Preis-Leistungs-Verhältnis. Ziehen Sie in Schritt 4 die Komponente LLM Mistral und wählen Sie die Variante:

Wählen Sie Mistral, wenn EU-Datenresidenz wichtig ist oder Sie Open-Weight-Flexibilität mit Frontier-naher Qualität wünschen.

Drei Flow-Muster decken die meisten Slack-Deployments ab. Bauen Sie eines davon auf das Setup oben, indem Sie Tools und Prompt des AI Agent anpassen:

Diese Muster lassen sich kombinieren: ein einziger Slack-Flow vereint Knowledge-Base-Retrieval, Live-Websuche und interne API-Aufrufe – das LLM wählt das passende Tool pro Anfrage.

Der Bot antwortet nicht. Prüfen Sie, dass „Only Trigger on Mention" zur Testweise passt – wenn aktiviert, müssen Sie den Bot @-erwähnen. Bestätigen Sie, dass der Kanal in Slack Message Received dem Test-Kanal entspricht.

Der Bot antwortet, aber die Qualität ist schlecht. Iterieren Sie zuerst über Backstory und Goal des AI Agent – das wirkt stärker als ein Modellwechsel. Wenn Qualität nach Prompt-Iteration noch schlecht ist, in der LLM-Komponente auf ein stärkeres Modell hochstufen (Mini → Standard → Top-Tier).

Permission-Fehler nach Slack-Auth. Slack-Integration in FlowHunts Integrations-Tab neu verbinden und Berechtigungen erneut erteilen. Slack invalidiert gelegentlich Tokens nach Owner-Wechseln.

Lange Antworten werden in Slack abgeschnitten. Slack hat ein Zeichenlimit pro Nachricht. Fügen Sie einen Post-Processing-Schritt zum Splitten langer Antworten hinzu oder weisen Sie den AI Agent im Goal an, Antworten unter 3.000 Zeichen zu halten.

Das gesamte Setup – Slack verbinden, Flow bauen, Modell wählen – ist in FlowHunt ein Abend-Projekt. Der heute gebaute Flow funktioniert mit jedem zukünftigen Modell: wenn GPT-6 oder Claude 5 erscheinen, tauschen Sie die LLM-Komponente und der Rest läuft weiter.

Starten Sie mit dem kostenlosen Tarif von FlowHunt , verbinden Sie Slack und liefern Sie einen funktionierenden KI-Slackbot vor dem Mittagessen aus.

Arshia ist eine AI Workflow Engineerin bei FlowHunt. Mit einem Hintergrund in Informatik und einer Leidenschaft für KI spezialisiert sie sich darauf, effiziente Arbeitsabläufe zu entwickeln, die KI-Tools in alltägliche Aufgaben integrieren und so Produktivität und Kreativität steigern.

Der No-Code-Flow-Builder von FlowHunt verbindet Slack mit jedem großen LLM – Claude, GPT, Gemini, Grok, Llama, Mistral – über einen einheitlichen Flow. Ohne Code, ohne Infrastruktur.

Die Slack-Integration von FlowHunt ermöglicht nahtlose KI-Zusammenarbeit direkt in deinem Slack-Workspace. Bringe beliebige Flows in Slack, automatisiere Workfl...

FlowHunt 2.6.12 führt die Slack-Integration, Intent-Klassifizierung und das Gemini-Modell ein und erweitert so die Funktionen des KI-Chatbots, Kunden-Insights u...

Integrieren Sie FlowHunt mit Slack, um Nachrichten zu automatisieren, Workflows auszulösen und Ihr Team mit KI-gestützten Flows auf dem Laufenden zu halten.

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.