Integração com o Slack

A integração do FlowHunt com o Slack permite colaboração com IA de forma fluida diretamente no seu workspace do Slack. Traga qualquer Flow para o Slack, automat...

Automação de IA

Conecte qualquer LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) ao Slack usando o construtor de fluxos no-code do FlowHunt. A configuração é a mesma para todo modelo — escolha o que se encaixa no seu caso de uso e coloque no ar em minutos.

Adicionar um assistente de IA ao Slack costumava significar escolher um fornecedor, escrever código de integração e reconstruir tudo quando um modelo melhor surgisse seis meses depois. Com o FlowHunt, a integração é desacoplada do modelo: você constrói o fluxo do Slack uma vez, conecta o LLM que quiser — Claude, GPT, Gemini, Grok, Llama, Mistral — e troca a qualquer momento sem mexer no resto.

Este guia mostra a configuração completa. A primeira metade é igual para todo modelo. A segunda detalha qual modelo escolher para cada caso de uso, com observações específicas para cada família de LLM. Pule para a seção que combina com seu stack ou leia do início ao fim se estiver começando do zero.

O Slack é onde as equipes fazem perguntas. Um agente de IA que vive ali responde instantaneamente — sem precisar trocar de contexto para uma ferramenta de chat, dashboard ou base de conhecimento separada. Implantações comuns:

O bot vive no Slack, então a adoção é automática — ninguém precisa aprender uma ferramenta nova.

A configuração é idêntica independentemente do modelo de IA escolhido. Você escolhe o modelo no passo 4; tudo o mais permanece igual.

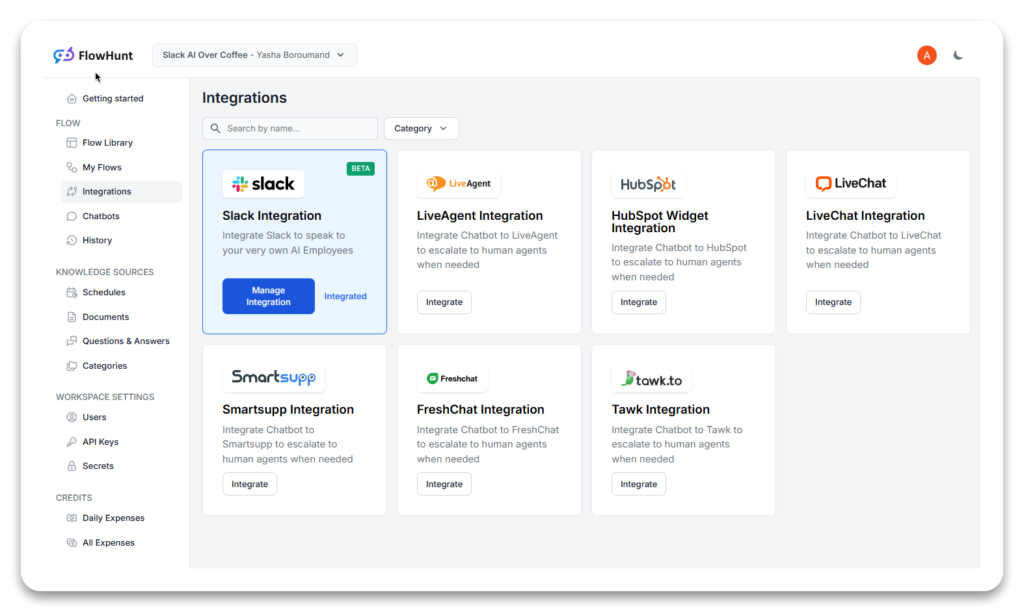

Faça login na sua conta FlowHunt e abra a aba Integrations. Selecione Slack, clique em Connect e autorize o app na tela de OAuth do Slack. Conceda as permissões de leitura/escrita que o FlowHunt solicita — elas permitem que o bot receba mensagens e poste respostas no seu workspace.

A URL do seu workspace aparece no canto superior esquerdo do Slack desktop ou web — copie de lá se o FlowHunt pedir. Depois de autorizado, o Slack está conectado e pronto para uso em qualquer fluxo.

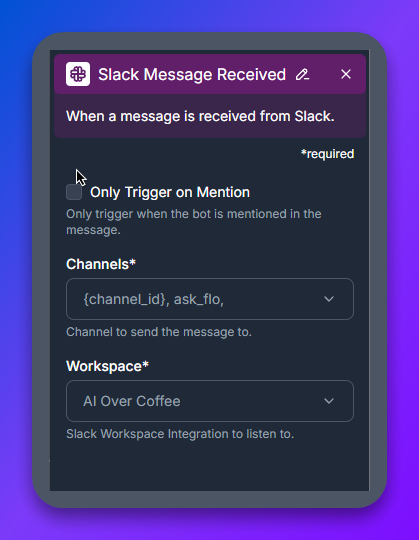

No construtor de fluxos do FlowHunt, arraste um componente Slack Message Received para o canvas. Esse bloco escuta mensagens recebidas no Slack e dispara o restante do fluxo.

Configure dois ajustes:

#ai-assistant é a configuração mais limpa.

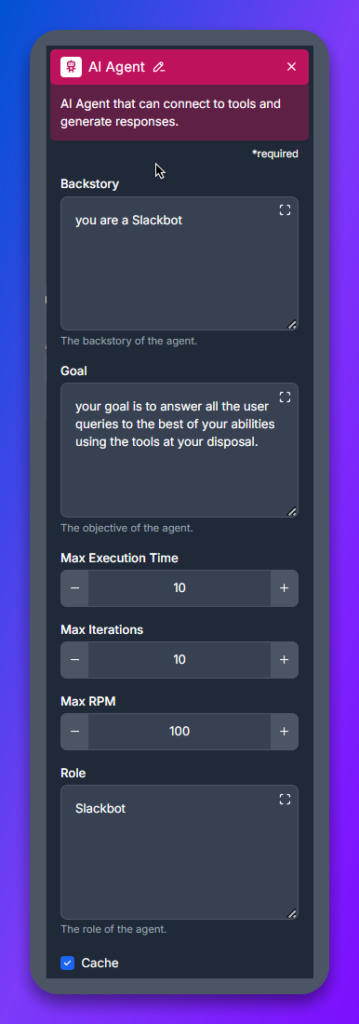

O bloco AI Agent é a camada de raciocínio do bot. Ele recebe a mensagem do usuário, decide quais ferramentas usar e formula a resposta.

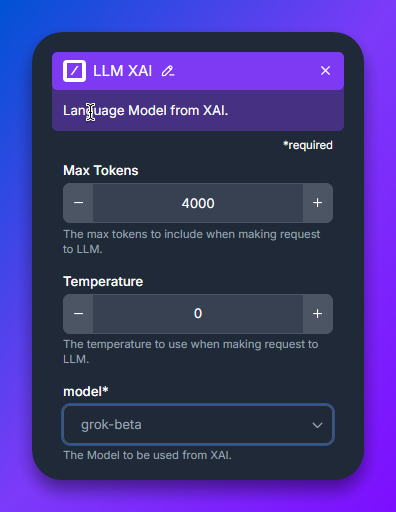

Conecte um componente LLM ao AI Agent. É aqui que você escolhe qual modelo de IA alimenta o bot. O FlowHunt tem um componente LLM separado para cada provedor — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — e dentro de cada um você seleciona a variante específica.

Esta é a única etapa que muda por modelo. Pule para a seção Escolha o modelo de IA certo abaixo para uma comparação e notas por família.

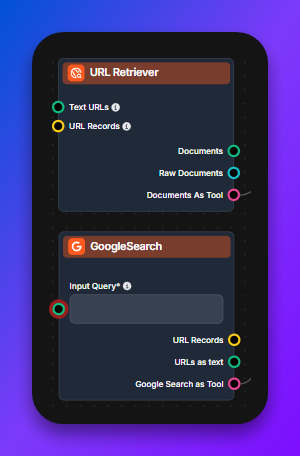

O AI Agent fica drasticamente mais útil quando pode usar ferramentas. As mais comuns:

As ferramentas são agnósticas de modelo. Qualquer LLM escolhido no passo 4 pode usar qualquer ferramenta que você conectar.

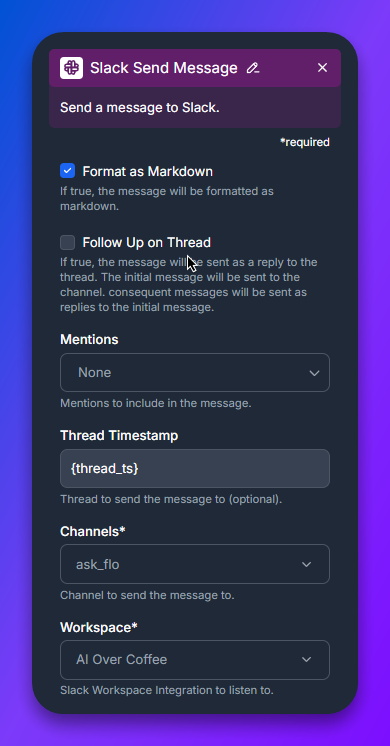

Finalize o fluxo com um componente Slack Send Message, configurado para o mesmo canal e workspace do passo 2. Salve o fluxo, abra o Slack e mencione o bot com @ no seu canal de teste. O bot deve responder usando o modelo escolhido no passo 4.

Essa é toda a configuração. Trocar de modelo depois é uma mudança de um clique no passo 4 — sem edição de código, sem reconstrução de fluxo.

Toda família principal de LLM funciona no fluxo do Slack do FlowHunt. As diferenças se resumem a custo, latência, janela de contexto, profundidade de raciocínio e qualidade de chamada de ferramentas. Use a tabela para fazer uma triagem inicial e depois leia a seção específica da família para notas de configuração.

| Família de modelos | Melhor para | Latência | Custo | Notas |

|---|---|---|---|---|

| Claude (Anthropic) | Análise de contexto longo, raciocínio cuidadoso, revisão de código | Média | Média–Alta | Forte em seguir instruções nuançadas; excelente para Q&A interno sobre documentos |

| GPT / série o (OpenAI) | Uso geral, ecossistema amplo de ferramentas, multimodal | Baixa–Média | Baixa (mini) – Alta (série o) | GPT-4o Mini é o ponto ideal padrão; o1 / o3 para raciocínio difícil |

| Gemini (Google) | Janelas de contexto enormes, multimodal rápido, ancorado em busca | Baixa | Baixa–Média | 1.5 Pro lida com 1M+ tokens; ótimo para Q&A de documento inteiro no Slack |

| Grok (xAI) | Consultas em tempo real / com noção de notícias, dados do X (Twitter), tom casual | Baixa | Média | Melhor quando o bot precisa de noção de eventos atuais |

| Llama (Meta) | Implantações auto-hospedadas / privadas, cargas sensíveis a custo | Depende do host | Baixo (auto-hospedado) | Pesos abertos — use quando residência de dados importa |

| Mistral | Pesos abertos, equilíbrio de custo/qualidade, hospedagem amigável à UE | Baixa | Baixa–Média | Mistral Large compete com GPT-4o a custo menor |

Escolha um para começar. Trocar modelos no FlowHunt é uma mudança de um clique no componente LLM, então pensar demais na escolha inicial não compensa — entregue com um padrão sensato, meça a qualidade no tráfego real do Slack e itere.

Cada seção abaixo é independente. Escolha a seção da família do modelo que você está conectando e siga as notas dela.

Claude é a família de LLMs da Anthropic, bem adequada para Slackbots que lidam com Q&A interno nuançado, sumarização de documentos, revisão de código e seguimento cuidadoso de instruções. Para conectar Claude ao Slack, arraste o componente LLM Anthropic no passo 4 e escolha a variante:

Para Slackbots de conhecimento interno sobre Notion ou Confluence, Claude 3.5 Sonnet com um Document Retriever é o ponto de partida mais confiável.

Os modelos GPT e série o da OpenAI são a escolha mais ampla para o Slack — desempenho de uso geral forte, a chamada de ferramentas mais madura e entrada multimodal (visão, áudio). Arraste o componente LLM OpenAI no passo 4 e escolha a variante:

Para a maioria das equipes, comece com o GPT-4o Mini. Promova para GPT-4o ou o1 apenas em fluxos onde os usuários reclamam da qualidade da resposta.

O Google Gemini é a escolha mais forte quando a janela de contexto importa — o Gemini 1.5 Pro lida com mais de 1M tokens, suficiente para colocar bases de código inteiras ou conjuntos de documentos em uma única consulta no Slack. Arraste o componente LLM Google no passo 4 e escolha a variante:

Se seu Slackbot precisa raciocinar sobre toda a sua base de conhecimento em uma única passagem (sem etapa de retrieval), a janela de contexto do Gemini Pro é a resposta mais limpa.

O xAI Grok é integrado ao fluxo do Slack do FlowHunt da mesma forma que os outros modelos — arraste o componente LLM xAI (ou use o componente LLM OpenAI apontando para o endpoint do Grok, dependendo da sua versão do FlowHunt) e escolha a variante do Grok. A característica distintiva do Grok é a consciência em tempo real — ele tem acesso a informações ao vivo, incluindo dados do X (Twitter), tornando-se a melhor escolha quando o Slackbot precisa de contexto de eventos atuais: notícias, dados de mercado, desenvolvimentos de última hora. Combine-o com a Google Search Tool para um acesso ainda mais amplo à web.

A família Llama da Meta é a opção de pesos abertos — use quando residência de dados, auto-hospedagem ou custo por token descartam APIs hospedadas. Arraste o componente LLM Meta no passo 4 e escolha a variante:

Llama é a resposta certa quando sua equipe de segurança ou conformidade exige que o modelo rode em infraestrutura controlada por você, ou quando o alto volume de mensagens torna os custos de API hospedada proibitivos.

Mistral é o concorrente europeu de pesos abertos — modelos fortes, hospedagem amigável à UE e boa relação preço-desempenho. Arraste o componente LLM Mistral no passo 4 e escolha a variante:

Escolha Mistral quando a residência de dados na UE for relevante, ou quando você quiser flexibilidade de pesos abertos com qualidade mais próxima da fronteira do que Llama 3.x em alguns benchmarks.

Três padrões de fluxo cobrem a maioria das implantações no Slack. Construa qualquer um deles em cima da configuração acima ajustando as ferramentas e o prompt do AI Agent:

Esses padrões se sobrepõem de forma limpa: um único fluxo do Slack pode combinar retrieval de base de conhecimento, busca web ao vivo e chamadas de API internas, com o LLM escolhendo a ferramenta certa para cada consulta.

O bot não responde a mensagens. Verifique se “Only Trigger on Mention” está condizente com sua forma de testar — se ativada, você precisa mencionar o bot com @. Confirme se o canal em Slack Message Received corresponde ao canal onde você está postando.

O bot responde, mas a resposta é ruim. Itere primeiro no backstory e no goal do AI Agent — eles têm mais impacto do que trocar de modelo. Se a qualidade ainda estiver ruim depois da iteração no prompt, promova para um modelo mais forte no componente LLM (Mini → padrão → top de linha).

Erros de permissão após a autenticação no Slack. Reconecte a integração do Slack na aba Integrations do FlowHunt e conceda novamente as permissões. O Slack ocasionalmente invalida tokens após mudanças de proprietário do workspace.

Respostas longas são truncadas no Slack. O Slack tem um limite de caracteres por mensagem. Adicione uma etapa de pós-processamento no fluxo para dividir respostas longas, ou instrua o AI Agent no goal a manter as respostas abaixo de 3.000 caracteres ao postar no Slack.

Toda a configuração — conectar o Slack, construir o fluxo, escolher um modelo — é um projeto de uma noite no FlowHunt. O fluxo que você constrói hoje funciona com qualquer modelo futuro: quando o GPT-6 ou o Claude 5 forem lançados, você troca o componente LLM e o resto do fluxo continua rodando.

Comece com o plano gratuito do FlowHunt , conecte o Slack e coloque um Slackbot com IA funcionando antes do almoço.

Arshia é Engenheira de Fluxos de Trabalho de IA na FlowHunt. Com formação em ciência da computação e paixão por IA, ela se especializa em criar fluxos de trabalho eficientes que integram ferramentas de IA em tarefas do dia a dia, aumentando a produtividade e a criatividade.

O construtor de fluxos no-code do FlowHunt conecta o Slack a todos os principais LLMs — Claude, GPT, Gemini, Grok, Llama, Mistral — por meio de um único fluxo consistente. Sem código, sem infraestrutura para gerenciar.

A integração do FlowHunt com o Slack permite colaboração com IA de forma fluida diretamente no seu workspace do Slack. Traga qualquer Flow para o Slack, automat...

O FlowHunt 2.6.12 apresenta a integração com Slack, classificação de intenções e o modelo Gemini, aprimorando a funcionalidade do chatbot de IA, percepções sobr...

O Servidor MCP do Slack permite uma integração perfeita entre ferramentas de IA e o Slack, possibilitando fluxos de trabalho automatizados para enviar, organiza...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.