Integración con Slack

La integración de Slack de FlowHunt permite una colaboración con IA sin interrupciones directamente en tu espacio de trabajo de Slack. Lleva cualquier Flow a Sl...

Conecta cualquier LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) a Slack con el constructor de flujos no-code de FlowHunt. La configuración es la misma para cada modelo — elige el que se ajuste a tu caso de uso y despliega en minutos.

Añadir un asistente de IA a Slack solía implicar elegir un proveedor, escribir código de integración y reconstruir todo cuando seis meses después aparecía un mejor modelo. Con FlowHunt, la integración está desacoplada del modelo: construyes el flujo de Slack una vez, conectas el LLM que quieras — Claude, GPT, Gemini, Grok, Llama, Mistral — y lo cambias en cualquier momento sin tocar el resto.

Esta guía cubre toda la configuración. La primera mitad es igual para cada modelo. La segunda mitad explica qué modelo elegir para qué caso de uso, con notas específicas por familia de LLM. Salta a la sección que se ajuste a tu stack o léela completa si empiezas desde cero.

Slack es donde los equipos hacen preguntas. Un agente de IA que vive ahí las responde al instante — sin cambiar a una herramienta de chat separada, dashboard o base de conocimiento. Despliegues comunes:

El bot vive en Slack, así que la adopción es automática — nadie tiene que aprender una nueva herramienta.

La configuración es idéntica sin importar qué modelo de IA elijas. Elige tu modelo en el paso 4; todo lo demás permanece igual.

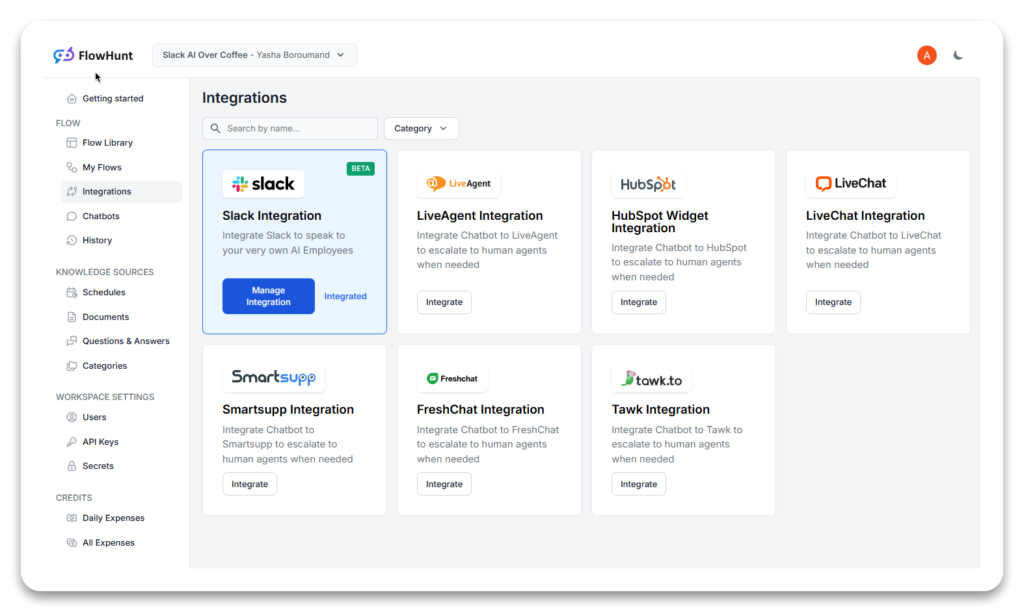

Inicia sesión en tu cuenta de FlowHunt y abre la pestaña Integrations. Selecciona Slack, haz clic en Connect y autoriza la app en la pantalla OAuth de Slack. Concede los permisos de lectura/escritura que solicita FlowHunt — permiten al bot recibir mensajes y publicar respuestas en tu workspace.

Tu URL de workspace aparece en la esquina superior izquierda de la app de Slack. Una vez autorizado, Slack queda conectado y listo para usar en cualquier flujo.

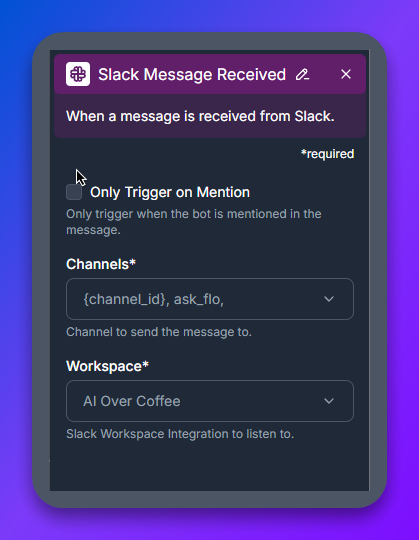

En el constructor de flujos de FlowHunt, arrastra un componente Slack Message Received al lienzo. Este bloque escucha mensajes entrantes de Slack y dispara el resto del flujo.

Configura dos ajustes:

#ai-assistant es la configuración más limpia.

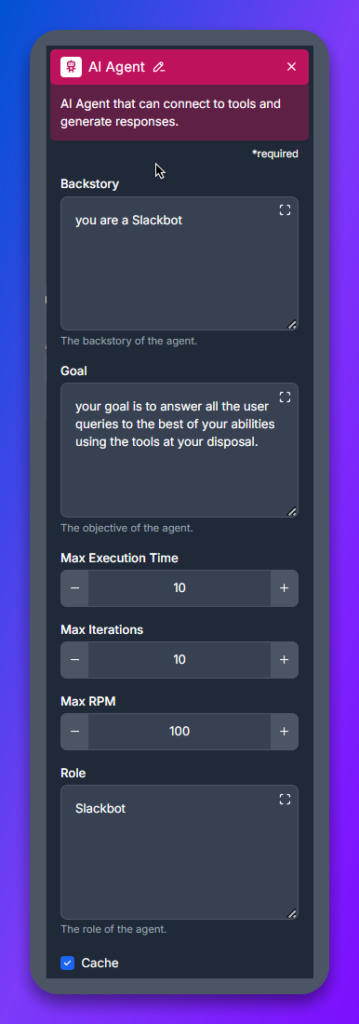

El bloque AI Agent es la capa de razonamiento del bot. Toma el mensaje del usuario, decide qué herramientas usar y elabora la respuesta.

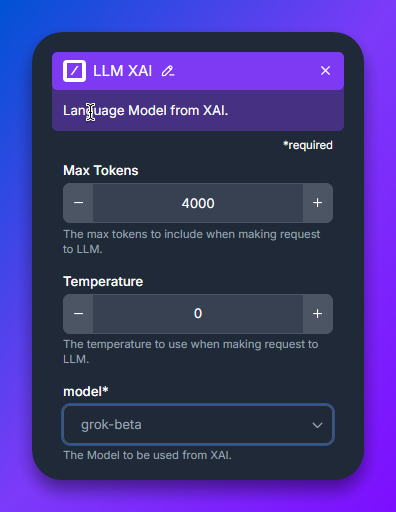

Conecta un componente LLM al AI Agent. Aquí eliges qué modelo de IA impulsa el bot. FlowHunt tiene un componente LLM separado por proveedor — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — y dentro de cada uno seleccionas la variante exacta del modelo.

Este es el único paso que difiere por modelo. Salta a Elige el modelo de IA correcto para una comparación y notas por familia.

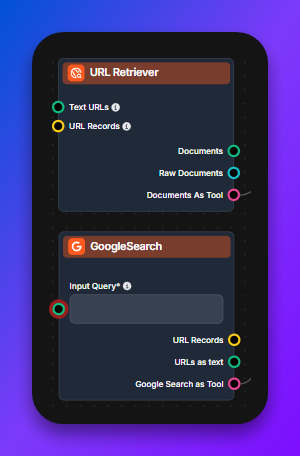

El AI Agent se vuelve mucho más útil cuando puede usar herramientas. Las comunes:

Las herramientas son agnósticas al modelo. Cualquier LLM elegido en el paso 4 puede usar cualquier herramienta conectada.

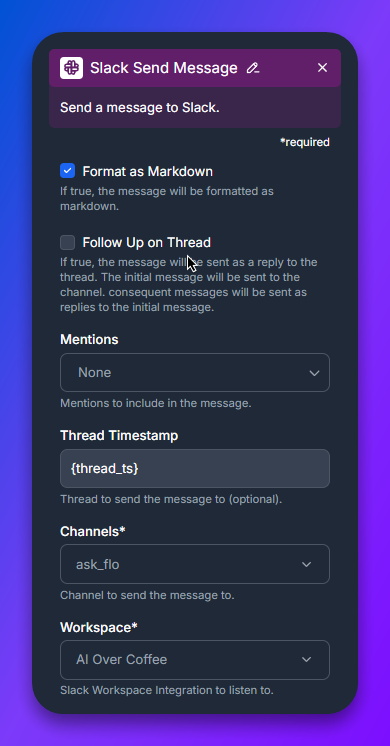

Cierra el flujo con un componente Slack Send Message, configurado para el mismo canal y workspace que en el paso 2. Guarda el flujo, abre Slack y haz @-mención al bot en tu canal de prueba. El bot debería responder usando el modelo elegido en el paso 4.

Esa es toda la configuración. Cambiar de modelo después es un cambio de un clic en el paso 4 — sin ediciones de código, sin reconstruir el flujo.

Cada gran familia de LLM funciona en el flujo de Slack de FlowHunt. Las diferencias se reducen a coste, latencia, ventana de contexto, profundidad de razonamiento y calidad de tool-calling. Usa la tabla para hacer una preselección, luego lee la sección específica de la familia para notas de configuración.

| Familia de modelo | Mejor para | Latencia | Coste | Notas |

|---|---|---|---|---|

| Claude (Anthropic) | Análisis de contexto largo, razonamiento cuidadoso, revisión de código | Media | Media–Alta | Excelente siguiendo instrucciones matizadas; ideal para Q&A interna sobre documentos |

| GPT / serie o (OpenAI) | Propósito general, ecosistema amplio de herramientas, multimodal | Baja–Media | Baja (mini) – Alta (serie o) | GPT-4o Mini es el sweet spot por defecto; o1/o3 para razonamiento difícil |

| Gemini (Google) | Ventanas de contexto enormes, rápido, multimodal, basado en búsqueda | Baja | Baja–Media | 1.5 Pro maneja 1M+ tokens; ideal para Q&A sobre documentos completos |

| Grok (xAI) | Consultas en tiempo real / con noticias, datos de X (Twitter), tono casual | Baja | Media | Mejor cuando el bot necesita conocimiento de eventos actuales |

| Llama (Meta) | Despliegues self-hosted/privados, cargas sensibles al coste | Depende del host | Bajo (self-hosted) | Pesos abiertos — cuando importa la residencia de datos |

| Mistral | Pesos abiertos, buen coste/calidad, hosting EU-friendly | Baja | Baja–Media | Mistral Large compite con GPT-4o a menor coste |

Elige uno para empezar. Cambiar de modelo en FlowHunt es un cambio de un clic en el componente LLM, así que sobrepensar la elección inicial no compensa — despliega con un default razonable, mide calidad sobre tráfico real de Slack, itera.

Cada sección abajo es autocontenida. Elige la sección de la familia que vas a conectar y sigue las notas.

Claude es la familia de LLM de Anthropic, ideal para Slackbots que manejan Q&A interna matizada, resumen de documentos, revisión de código y seguimiento cuidadoso de instrucciones. Para conectar Claude a Slack, arrastra el componente LLM Anthropic en el paso 4 y elige la variante:

Para Slackbots de conocimiento interno sobre Notion o Confluence, Claude 3.5 Sonnet más Document Retriever es el punto de partida más fiable.

Los modelos GPT y serie o de OpenAI son la opción más amplia para Slack — fuerte rendimiento general, el tool-calling más maduro, e input multimodal (visión, audio). Arrastra el componente LLM OpenAI en el paso 4 y elige la variante:

Para la mayoría de equipos: empieza con GPT-4o Mini. Sube a GPT-4o u o1 solo en flujos donde los usuarios se quejan de la calidad de respuesta.

Google Gemini es la opción más fuerte cuando importa la ventana de contexto — Gemini 1.5 Pro maneja más de 1M de tokens, suficiente para volcar bases de código completas o conjuntos de documentos en una única consulta de Slack. Arrastra el componente LLM Google en el paso 4 y elige la variante:

Si tu Slackbot necesita razonar sobre toda tu base de conocimiento en una sola pasada (sin paso de retrieval), la ventana de contexto de Gemini Pro es la respuesta más limpia.

xAI Grok se integra en el flujo de Slack de FlowHunt igual que los otros modelos — arrastra el componente LLM xAI (o el componente LLM OpenAI según tu versión de FlowHunt) y elige la variante de Grok. La fortaleza distintiva de Grok es el conocimiento en tiempo real — acceso a información en vivo incluyendo datos de X (Twitter) — ideal cuando el Slackbot necesita contexto de eventos actuales: noticias, datos de mercado, novedades. Combínalo con Google Search Tool para acceso web aún más amplio.

La familia Llama de Meta es la opción de pesos abiertos — úsala cuando residencia de datos, self-hosting o coste por token descarten APIs hospedadas. Arrastra el componente LLM Meta en el paso 4 y elige la variante:

Llama es la respuesta correcta cuando seguridad o cumplimiento exigen que el modelo corra en infraestructura propia, o cuando el alto volumen de mensajes hace prohibitivos los costes de API hospedada.

Mistral es el contendiente europeo de pesos abiertos — modelos fuertes, hosting EU-friendly y buena relación precio-rendimiento. Arrastra el componente LLM Mistral en el paso 4 y elige la variante:

Elige Mistral cuando importa la residencia de datos UE, o cuando quieres flexibilidad de pesos abiertos con calidad cercana a frontier.

Tres patrones de flujo cubren la mayoría de despliegues en Slack. Construye cualquiera sobre la configuración de arriba ajustando las herramientas y prompt del AI Agent:

Estos patrones se combinan: un único flujo de Slack puede unir retrieval de base de conocimiento, búsqueda web en vivo y llamadas a APIs internas, con el LLM eligiendo la herramienta correcta por consulta.

El bot no responde a los mensajes. Verifica que “Only Trigger on Mention” coincida con cómo pruebas — si está activado, debes hacerle @-mención. Confirma que el canal en Slack Message Received coincida con el canal donde publicas.

El bot responde pero la calidad es pobre. Itera primero sobre backstory y goal del AI Agent — son más impactantes que cambiar de modelo. Si la calidad sigue siendo mala tras iterar, sube a un modelo más fuerte en el componente LLM (Mini → estándar → top-tier).

Errores de permisos tras autenticación de Slack. Reconecta la integración de Slack en la pestaña Integrations de FlowHunt y vuelve a conceder permisos. Slack invalida tokens ocasionalmente tras cambios de propietario del workspace.

Las respuestas largas se truncan en Slack. Slack tiene límite de caracteres por mensaje. Añade un paso de post-procesamiento al flujo para dividir respuestas largas, o instruye al AI Agent en su goal para mantener respuestas bajo 3.000 caracteres al publicar en Slack.

Toda la configuración — conectar Slack, construir el flujo, elegir un modelo — es un proyecto de una tarde en FlowHunt. El flujo que construyes hoy funciona con cualquier modelo futuro: cuando salgan GPT-6 o Claude 5, cambias el componente LLM y el resto sigue funcionando.

Empieza con el tier gratuito de FlowHunt , conecta Slack y despliega un Slackbot con IA funcional antes del almuerzo.

Arshia es ingeniera de flujos de trabajo de IA en FlowHunt. Con formación en ciencias de la computación y una pasión por la IA, se especializa en crear flujos de trabajo eficientes que integran herramientas de IA en las tareas cotidianas, mejorando la productividad y la creatividad.

El constructor de flujos no-code de FlowHunt conecta Slack con cada gran LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — a través de un único flujo coherente. Sin código, sin infraestructura que mantener.

La integración de Slack de FlowHunt permite una colaboración con IA sin interrupciones directamente en tu espacio de trabajo de Slack. Lleva cualquier Flow a Sl...

FlowHunt 2.6.12 introduce la integración con Slack, la clasificación de intenciones y el modelo Gemini, mejorando la funcionalidad del chatbot de IA, la compren...

Integra FlowHunt con Slack para automatizar mensajes, activar flujos de trabajo y mantener a tu equipo informado con flujos impulsados por IA.

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.