Slack 연동

FlowHunt의 Slack 연동을 통해 여러분의 Slack 워크스페이스 내에서 AI 협업을 원활하게 진행할 수 있습니다. 어떤 Flow든 Slack으로 가져오고, 워크플로우를 자동화하며, 실시간 AI 지원을 제공하고, 고객 서비스 채팅을 모니터링하고, 생산성을 높이세요—여러분 팀이 이...

FlowHunt의 노코드 플로우 빌더로 어떤 LLM(Claude, GPT, Gemini, Grok, Llama, Mistral)이라도 Slack에 연결하세요. 셋업은 모든 모델에 동일합니다. 사용 사례에 맞는 모델을 고른 뒤 몇 분 안에 배포하세요.

기존에는 Slack에 AI 어시스턴트를 추가하려면 벤더를 선택하고 통합 코드를 작성한 다음, 6개월 후 더 좋은 모델이 출시될 때마다 모든 것을 다시 만들어야 했습니다. FlowHunt를 사용하면 통합과 모델이 분리됩니다. Slack 플로우를 한 번만 구축한 뒤 원하는 LLM(Claude, GPT, Gemini, Grok, Llama, Mistral)을 꽂아 사용하고, 나머지를 건드리지 않고 언제든 교체할 수 있습니다.

이 가이드는 전체 셋업 과정을 안내합니다. 전반부는 모든 모델에 동일하게 적용됩니다. 후반부에서는 어떤 사용 사례에 어떤 모델이 적합한지, 각 LLM 패밀리별 참고 사항과 함께 다룹니다. 사용 중인 스택에 맞는 섹션으로 바로 이동하거나, 처음부터 끝까지 읽으셔도 됩니다.

Slack은 팀이 질문을 던지는 곳입니다. 그 안에 살아 있는 AI 에이전트는 별도의 채팅 도구, 대시보드, 지식 베이스로 컨텍스트를 전환하지 않고도 즉시 답변합니다. 일반적인 활용 사례:

봇이 Slack 안에 머무르므로 도입은 자동으로 이루어집니다 — 누구도 새 도구를 배울 필요가 없습니다.

선택한 AI 모델과 관계없이 셋업은 동일합니다. 모델은 4단계에서 선택하며 나머지는 모두 같습니다.

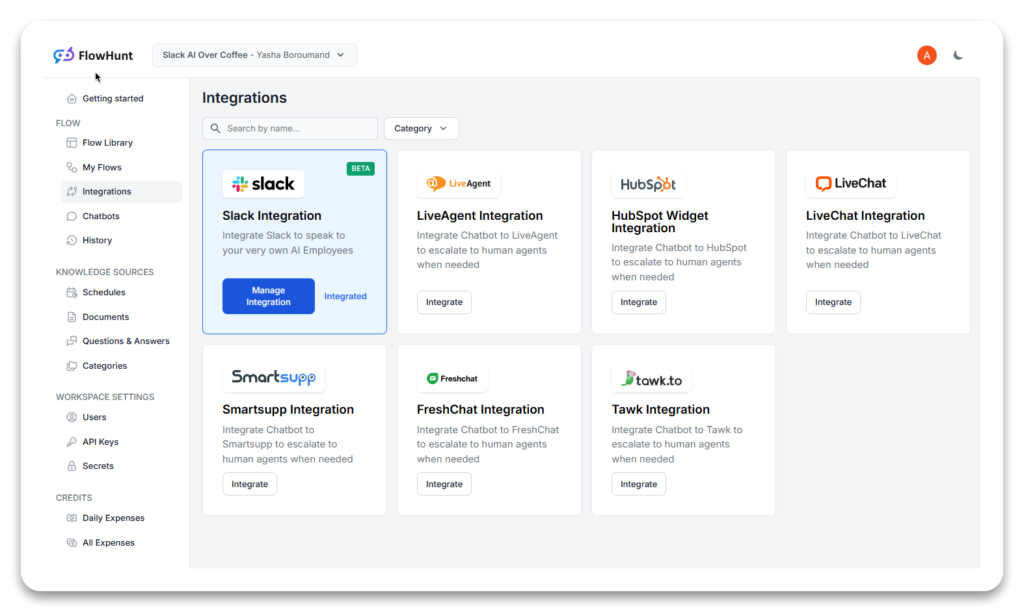

FlowHunt 계정에 로그인한 뒤 Integrations 탭을 엽니다. Slack을 선택하고 Connect를 클릭한 다음, Slack의 OAuth 화면에서 앱을 승인합니다. FlowHunt가 요청하는 읽기/쓰기 권한을 부여하세요. 이 권한이 있어야 봇이 메시지를 수신하고 워크스페이스에서 응답을 게시할 수 있습니다.

워크스페이스 URL은 Slack 데스크톱 또는 웹 앱의 좌측 상단에 표시됩니다. FlowHunt가 요청하면 그곳에서 복사하세요. 권한 부여가 끝나면 Slack은 연결되어 어떤 플로우에서도 사용할 준비가 됩니다.

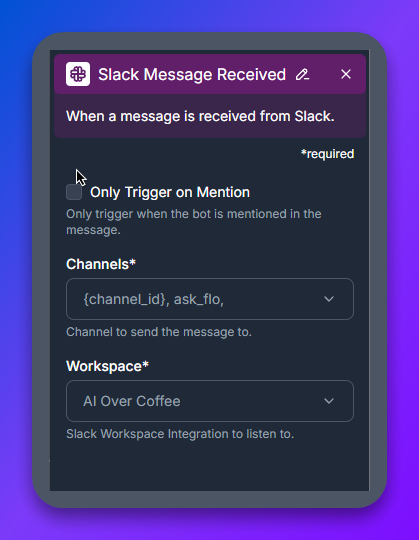

FlowHunt 플로우 빌더에서 Slack Message Received 컴포넌트를 캔버스에 드롭합니다. 이 블록은 들어오는 Slack 메시지를 수신하고 나머지 플로우를 트리거합니다.

두 가지 설정을 구성합니다:

#ai-assistant 채널이 가장 깔끔한 구성입니다.

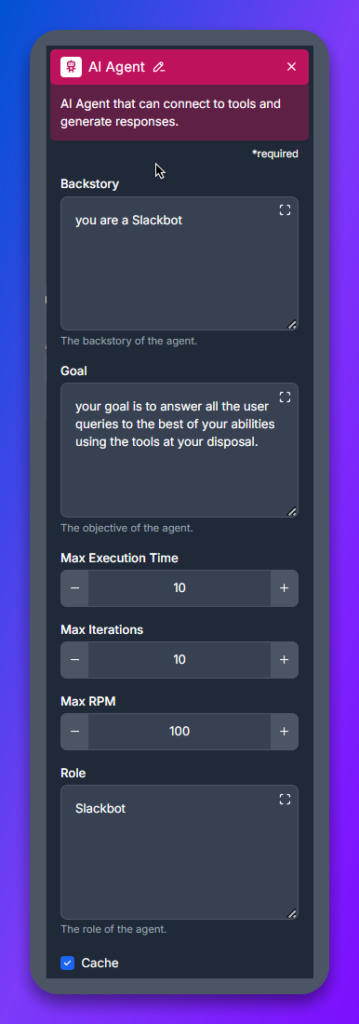

AI Agent 블록은 봇의 추론 계층입니다. 사용자 메시지를 받아 어떤 도구를 사용할지 결정하고 응답을 작성합니다.

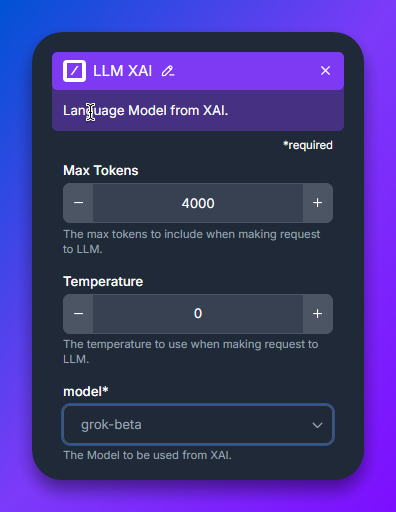

LLM 컴포넌트를 AI Agent에 연결합니다. 여기서 봇을 구동할 AI 모델을 선택합니다. FlowHunt는 제공자별로 별도의 LLM 컴포넌트(LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI)를 제공하며, 각 컴포넌트 내에서 구체적인 모델 변형을 선택할 수 있습니다.

이 단계만 모델별로 다릅니다. 비교와 패밀리별 참고 사항은 아래의 적합한 AI 모델 선택하기 섹션을 참고하세요.

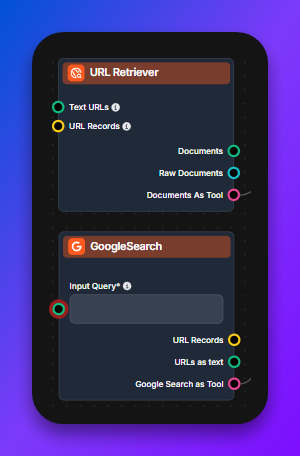

AI Agent는 도구를 사용할 수 있을 때 훨씬 유용해집니다. 자주 쓰이는 도구:

도구는 모델에 종속되지 않습니다. 4단계에서 선택한 어떤 LLM이든 연결한 어떤 도구든 사용할 수 있습니다.

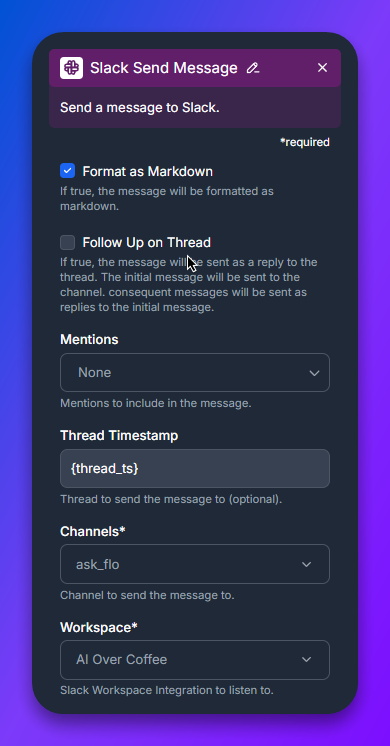

플로우를 Slack Send Message 컴포넌트로 마무리하고, 2단계와 동일한 채널 및 워크스페이스로 구성합니다. 플로우를 저장하고 Slack을 연 다음 테스트 채널에서 봇을 @멘션하세요. 봇은 4단계에서 선택한 모델을 사용해 응답해야 합니다.

이것으로 셋업이 완료됩니다. 나중에 모델을 전환하는 것은 4단계에서의 원클릭 변경입니다 — 코드 수정도, 플로우 재구축도 필요 없습니다.

모든 주요 LLM 패밀리가 FlowHunt의 Slack 플로우에서 작동합니다. 차이는 비용, 지연 시간, 컨텍스트 윈도우, 추론 깊이, 도구 호출 품질로 귀결됩니다. 표를 사용해 후보를 추린 뒤 패밀리별 섹션에서 셋업 노트를 확인하세요.

| 모델 패밀리 | 강점 | 지연 | 비용 | 비고 |

|---|---|---|---|---|

| Claude (Anthropic) | 롱컨텍스트 분석, 신중한 추론, 코드 리뷰 | 중간 | 중간~높음 | 미묘한 지시 따르기에 강함; 문서 기반 사내 Q&A에 우수 |

| GPT / o-시리즈 (OpenAI) | 범용, 광범위한 도구 생태계, 멀티모달 | 낮음~중간 | 낮음(mini)~높음(o-시리즈) | GPT-4o Mini가 기본 스위트 스팟; 어려운 추론에는 o1/o3 |

| Gemini (Google) | 거대한 컨텍스트 윈도우, 빠른 멀티모달, 검색 그라운딩 | 낮음 | 낮음~중간 | 1.5 Pro는 100만 이상의 토큰 처리; 문서 전체 Slack Q&A에 적합 |

| Grok (xAI) | 실시간/뉴스 인지 쿼리, X(트위터) 데이터, 캐주얼한 톤 | 낮음 | 중간 | 봇이 시사 인지가 필요할 때 최적 |

| Llama (Meta) | 셀프 호스팅/사설 배포, 비용 민감 워크로드 | 호스팅에 의존 | 낮음(셀프 호스팅) | 오픈 웨이트 — 데이터 레지던시가 중요할 때 |

| Mistral | 오픈 웨이트, 균형 잡힌 비용/품질, EU 친화적 호스팅 | 낮음 | 낮음~중간 | Mistral Large가 더 낮은 비용으로 GPT-4o와 경쟁 |

하나를 골라 시작하세요. FlowHunt에서 모델 전환은 LLM 컴포넌트의 원클릭 변경이므로 초기 선택을 너무 고민할 필요는 없습니다. 합리적인 기본값으로 출시하고, 실제 Slack 트래픽으로 품질을 측정한 뒤 반복 개선하세요.

아래 각 섹션은 독립적입니다. 연결할 모델 패밀리의 섹션을 골라 그 노트를 따르세요.

Claude는 Anthropic의 LLM 패밀리로, 미묘한 사내 Q&A, 문서 요약, 코드 리뷰, 신중한 지시 따르기를 처리하는 Slackbot에 적합합니다. Claude를 Slack에 연결하려면 4단계에서 LLM Anthropic 컴포넌트를 드롭하고 변형을 선택하세요:

Notion이나 Confluence 위의 사내 지식 Slackbot에는 Claude 3.5 Sonnet과 Document Retriever 조합이 가장 신뢰할 수 있는 출발점입니다.

OpenAI의 GPT 및 o-시리즈 모델은 Slack에서 가장 폭넓은 선택지입니다 — 강력한 범용 성능, 가장 성숙한 도구 호출, 멀티모달 입력(비전, 오디오)을 갖추고 있습니다. 4단계에서 LLM OpenAI 컴포넌트를 드롭하고 변형을 선택하세요:

대부분의 팀은 GPT-4o Mini로 시작하는 것이 좋습니다. 사용자가 답변 품질에 불만을 표시하는 플로우에 한해서만 GPT-4o나 o1로 승격하세요.

Google Gemini는 컨텍스트 윈도우가 중요할 때 가장 강력한 선택입니다 — Gemini 1.5 Pro는 100만 토큰 이상을 처리할 수 있어 전체 코드베이스나 문서 세트를 단일 Slack 쿼리에 넣기에 충분합니다. 4단계에서 LLM Google 컴포넌트를 드롭하고 변형을 선택하세요:

Slackbot이 전체 지식 베이스를 한 번에 추론해야 한다면(검색 단계 없이) Gemini Pro의 컨텍스트 윈도우가 가장 깔끔한 답입니다.

xAI Grok은 다른 모델과 같은 방식으로 FlowHunt의 Slack 플로우에 통합됩니다 — LLM xAI 컴포넌트(또는 FlowHunt 버전에 따라 Grok 엔드포인트를 가리키는 LLM OpenAI 컴포넌트)를 드롭하고 Grok 변형을 선택합니다. Grok의 차별점은 실시간 인지입니다 — X(트위터) 데이터를 포함한 라이브 정보에 접근할 수 있어 Slackbot이 시사적 컨텍스트(뉴스, 시장 데이터, 속보)가 필요한 경우 최선의 선택입니다. Google Search Tool과 결합하면 더 폭넓은 웹 액세스가 가능합니다.

Meta의 Llama 패밀리는 오픈 웨이트 옵션입니다 — 데이터 레지던시, 셀프 호스팅, 토큰당 비용이 호스팅된 API를 배제하는 경우에 사용하세요. 4단계에서 LLM Meta 컴포넌트를 드롭하고 변형을 선택하세요:

Llama는 보안 또는 컴플라이언스 팀이 관리 가능한 인프라에서 모델 실행을 요구하거나, 메시지 볼륨이 많아 호스팅 API 비용이 과도한 경우의 정답입니다.

Mistral은 유럽의 오픈 웨이트 경쟁자입니다 — 강력한 모델, EU 친화적 호스팅, 우수한 가성비. 4단계에서 LLM Mistral 컴포넌트를 드롭하고 변형을 선택하세요:

EU 데이터 레지던시가 중요하거나 일부 벤치마크에서 Llama 3.x보다 프런티어에 더 가까운 품질의 오픈 웨이트 유연성을 원할 때 Mistral을 선택하세요.

세 가지 플로우 패턴으로 대부분의 Slack 배포를 다룰 수 있습니다. AI Agent의 도구와 프롬프트를 조정하여 위 셋업 위에 어느 것이든 구축할 수 있습니다:

이 패턴들은 깔끔하게 결합됩니다. 단일 Slack 플로우가 지식 베이스 검색, 라이브 웹 검색, 내부 API 호출을 결합할 수 있고, LLM이 쿼리마다 적합한 도구를 선택합니다.

봇이 메시지에 응답하지 않습니다. ‘Only Trigger on Mention’이 테스트 방식과 일치하는지 확인하세요. 활성화되어 있다면 봇을 @멘션해야 합니다. Slack Message Received의 채널이 게시 중인 채널과 일치하는지 확인하세요.

봇이 응답하지만 품질이 낮습니다. 먼저 AI Agent의 backstory와 goal을 반복 개선하세요 — 모델 교체보다 영향력이 큽니다. 프롬프트 반복 후에도 품질이 좋지 않다면 LLM 컴포넌트에서 더 강력한 모델로 승격하세요(Mini → 표준 → 최상위).

Slack 인증 후 권한 오류. FlowHunt의 Integrations 탭에서 Slack 통합을 다시 연결하고 권한을 다시 부여하세요. Slack은 워크스페이스 소유자 변경 후 토큰을 종종 무효화합니다.

긴 답변이 Slack에서 잘립니다. Slack에는 메시지당 글자 수 제한이 있습니다. 플로우에 긴 응답을 분할하는 후처리 단계를 추가하거나, AI Agent의 goal에 ‘Slack에 게시할 때 응답을 3,000자 이하로 유지’하도록 지시하세요.

전체 셋업(Slack 연결, 플로우 구축, 모델 선택)은 FlowHunt에서 하룻저녁이면 끝나는 프로젝트입니다. 오늘 만든 플로우는 미래의 어떤 모델에서도 작동합니다. GPT-6이나 Claude 5가 출시되면 LLM 컴포넌트를 교체하고 나머지 플로우는 계속 동작합니다.

FlowHunt의 무료 플랜 으로 시작해 Slack을 연결하고 점심 전에 작동하는 AI Slackbot을 배포하세요.

아르시아는 FlowHunt의 AI 워크플로우 엔지니어입니다. 컴퓨터 과학 배경과 AI에 대한 열정을 바탕으로, 그는 AI 도구를 일상 업무에 통합하여 생산성과 창의성을 높이는 효율적인 워크플로우를 설계하는 데 전문성을 가지고 있습니다.

FlowHunt의 노코드 플로우 빌더는 Slack을 모든 주요 LLM(Claude, GPT, Gemini, Grok, Llama, Mistral)과 일관된 하나의 플로우로 연결합니다. 코드 작성도, 인프라 관리도 필요 없습니다.

FlowHunt의 Slack 연동을 통해 여러분의 Slack 워크스페이스 내에서 AI 협업을 원활하게 진행할 수 있습니다. 어떤 Flow든 Slack으로 가져오고, 워크플로우를 자동화하며, 실시간 AI 지원을 제공하고, 고객 서비스 채팅을 모니터링하고, 생산성을 높이세요—여러분 팀이 이...

FlowHunt를 슬랙과 연동하여 메시지 자동화, 워크플로우 트리거, AI 기반의 플로우로 팀 커뮤니케이션을 실시간으로 관리하세요....

FlowHunt 2.6.12에서는 슬랙 통합, 의도 분류, 그리고 Gemini 모델을 도입하여 AI 챗봇 기능, 고객 인사이트, 팀 워크플로우를 강화합니다....

쿠키 동의

당사는 귀하의 브라우징 경험을 향상시키고 트래픽을 분석하기 위해 쿠키를 사용합니다. See our privacy policy.