Integrazione con Slack

L’integrazione di Slack con FlowHunt consente una collaborazione AI senza soluzione di continuità direttamente all’interno del tuo workspace Slack. Porta qualsi...

Collega qualsiasi LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) a Slack con il flow builder no-code di FlowHunt. La configurazione è la stessa per ogni modello — scegli quello adatto al tuo caso d’uso e vai live in pochi minuti.

Aggiungere un assistente IA a Slack significava un tempo scegliere un fornitore, scrivere codice di integrazione e ricostruire tutto quando sei mesi dopo usciva un modello migliore. Con FlowHunt, l’integrazione è disaccoppiata dal modello: costruisci il flow Slack una volta sola, colleghi l’LLM che vuoi — Claude, GPT, Gemini, Grok, Llama, Mistral — e lo cambi in qualsiasi momento senza toccare il resto.

Questa guida copre l’intera configurazione. La prima metà è identica per ogni modello. La seconda metà spiega quale modello scegliere per quale caso d’uso, con note specifiche per famiglia di LLM. Salta alla sezione che corrisponde al tuo stack o leggila tutta dall’inizio.

Slack è dove i team fanno domande. Un agente IA che vive lì le risponde all’istante — senza passare a un altro tool di chat, dashboard o knowledge base. Distribuzioni comuni:

Il bot vive in Slack — l’adozione è automatica, nessuno deve imparare un nuovo strumento.

La configurazione è identica indipendentemente dal modello di IA scelto. Scegli il modello al passo 4; tutto il resto rimane uguale.

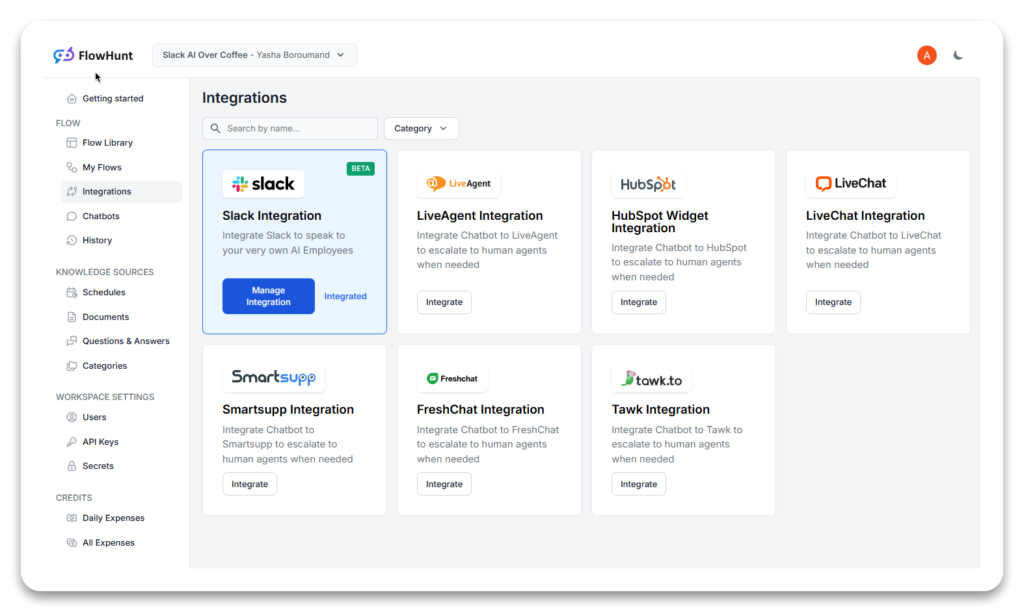

Accedi al tuo account FlowHunt e apri la scheda Integrations. Seleziona Slack, clicca Connect e autorizza l’app sulla schermata OAuth di Slack. Concedi i permessi di lettura/scrittura richiesti da FlowHunt — permettono al bot di ricevere messaggi e pubblicare risposte nel tuo workspace.

L’URL del workspace appare in alto a sinistra dell’app Slack. Una volta autorizzato, Slack è collegato e pronto all’uso in qualsiasi flow.

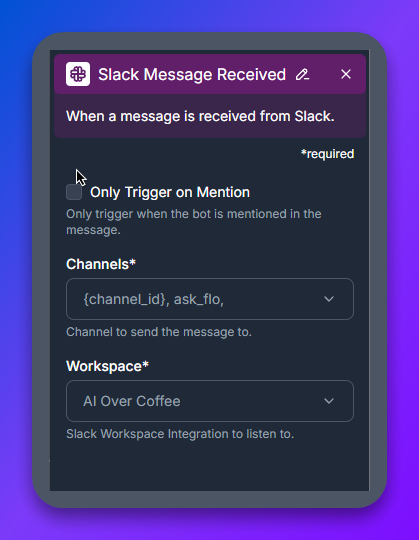

Nel flow builder di FlowHunt trascina un componente Slack Message Received sul canvas. Questo blocco ascolta i messaggi Slack in entrata e attiva il resto del flow.

Configura due impostazioni:

#ai-assistant è la configurazione più pulita.

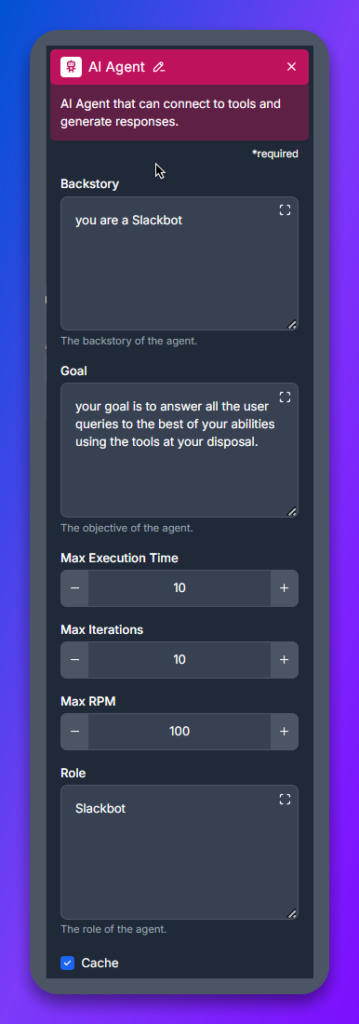

Il blocco AI Agent è il livello di ragionamento del bot. Prende il messaggio dell’utente, decide quali tool usare e formula la risposta.

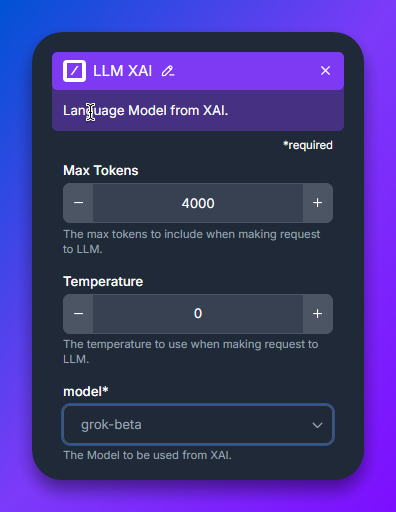

Collega un componente LLM all’AI Agent. Qui scegli quale modello di IA alimenta il bot. FlowHunt ha un componente LLM separato per provider — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — e dentro ognuno selezioni la variante esatta del modello.

Questo è l’unico passo che differisce per modello. Salta a Scegli il modello di IA giusto per un confronto e note per famiglia.

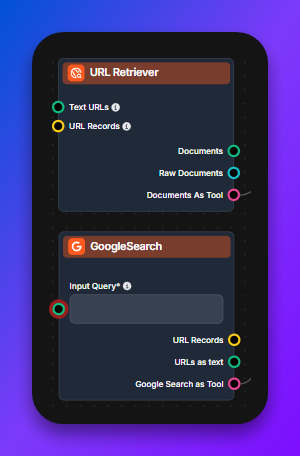

L’AI Agent diventa molto più utile quando può usare tool. Quelli comuni:

I tool sono agnostici rispetto al modello. Qualsiasi LLM scelto al passo 4 può usare qualsiasi tool collegato.

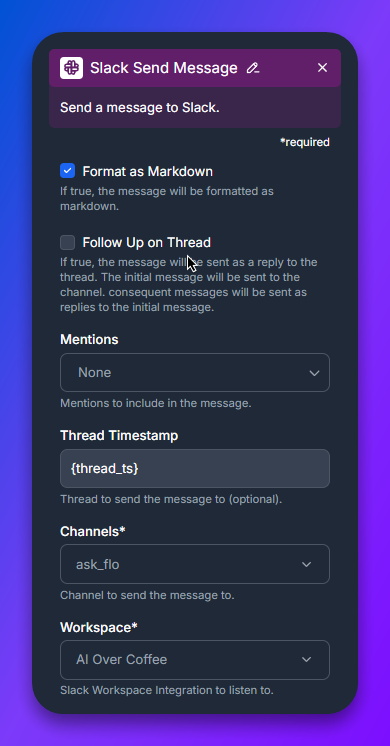

Chiudi il flow con un componente Slack Send Message, configurato per lo stesso canale e workspace del passo 2. Salva il flow, apri Slack e @-menziona il bot nel canale di test. Il bot dovrebbe rispondere usando il modello scelto al passo 4.

Questa è tutta la configurazione. Cambiare modello in seguito è un cambio in un click al passo 4 — niente modifiche di codice, niente ricostruzione del flow.

Ogni grande famiglia di LLM funziona nel flow Slack di FlowHunt. Le differenze si riducono a costo, latenza, finestra di contesto, profondità di ragionamento e qualità del tool-calling. Usa la tabella per fare una shortlist, poi leggi la sezione specifica della famiglia per le note di setup.

| Famiglia di modello | Ideale per | Latenza | Costo | Note |

|---|---|---|---|---|

| Claude (Anthropic) | Analisi long-context, ragionamento accurato, code review | Media | Medio–Alto | Eccelle nel seguire istruzioni sfumate; ideale per Q&A interna su documenti |

| GPT / serie o (OpenAI) | Generale, ampio ecosistema di tool, multimodale | Bassa–Media | Basso (mini) – Alto (serie o) | GPT-4o Mini è il sweet spot di default; o1/o3 per ragionamento difficile |

| Gemini (Google) | Finestre di contesto enormi, veloce, multimodale, basato su ricerca | Bassa | Basso–Medio | 1.5 Pro gestisce 1M+ token; ideale per Q&A su documenti interi |

| Grok (xAI) | Query in tempo reale / news, dati X (Twitter), tono casual | Bassa | Medio | Migliore quando il bot ha bisogno di consapevolezza degli eventi attuali |

| Llama (Meta) | Distribuzioni self-hosted/private, carichi sensibili ai costi | Dipende dall’host | Basso (self-hosted) | Pesi aperti — quando conta la residenza dei dati |

| Mistral | Open-weight, buon costo/qualità, hosting EU-friendly | Bassa | Basso–Medio | Mistral Large compete con GPT-4o a costi inferiori |

Sceglierne uno per iniziare. Cambiare modello in FlowHunt è un cambio in un click nel componente LLM, quindi pensarci troppo all’inizio non paga — distribuisci con una scelta di default sensata, misura la qualità sul traffico Slack reale, itera.

Ogni sezione qui sotto è autocontenuta. Scegli la sezione della famiglia che stai collegando e segui le note.

Claude è la famiglia di LLM di Anthropic, ideale per Slackbot che gestiscono Q&A interna sfumata, riassunto di documenti, code review e accurata aderenza alle istruzioni. Per collegare Claude a Slack, trascina il componente LLM Anthropic al passo 4 e scegli la variante:

Per Slackbot di knowledge base interna su Notion o Confluence, Claude 3.5 Sonnet più Document Retriever è il punto di partenza più affidabile.

I modelli GPT e serie o di OpenAI sono la scelta più ampia per Slack — performance generaliste forti, il tool-calling più maturo e input multimodale (vision, audio). Trascina il componente LLM OpenAI al passo 4 e scegli la variante:

Per la maggior parte dei team: inizia con GPT-4o Mini. Promuovi a GPT-4o o o1 solo nei flow dove gli utenti si lamentano della qualità delle risposte.

Google Gemini è la scelta più forte quando conta la finestra di contesto — Gemini 1.5 Pro gestisce oltre 1M token, sufficienti per inserire intere codebase o set di documenti in una singola query Slack. Trascina il componente LLM Google al passo 4 e scegli la variante:

Se il tuo Slackbot deve ragionare su tutta la tua knowledge base in un singolo passaggio (senza step di retrieval), la finestra di contesto di Gemini Pro è la risposta più pulita.

xAI Grok si integra nel flow Slack di FlowHunt come gli altri modelli — trascina il componente LLM xAI (o il componente LLM OpenAI a seconda della tua versione di FlowHunt) e scegli la variante Grok. La forza distintiva di Grok è la consapevolezza in tempo reale — accesso a informazioni live inclusi i dati X (Twitter) — ideale quando lo Slackbot ha bisogno di contesto attuale: notizie, dati di mercato, novità. Combinalo con Google Search Tool per accesso web ancora più ampio.

La famiglia Llama di Meta è l’opzione open-weight — usala quando residenza dei dati, self-hosting o costo per token escludono le API hosted. Trascina il componente LLM Meta al passo 4 e scegli la variante:

Llama è la risposta giusta quando sicurezza o compliance richiedono che il modello giri su infrastruttura propria, o quando l’alto volume di messaggi rende proibitivi i costi delle API hosted.

Mistral è il contendente europeo open-weight — modelli forti, hosting EU-friendly e buon rapporto prezzo-prestazioni. Trascina il componente LLM Mistral al passo 4 e scegli la variante:

Scegli Mistral quando conta la residenza dei dati UE o quando vuoi flessibilità open-weight con qualità vicina al frontier.

Tre pattern di flow coprono la maggior parte delle distribuzioni Slack. Costruisci uno di essi sopra la configurazione di sopra regolando tool e prompt dell’AI Agent:

Questi pattern si combinano: un singolo flow Slack può unire retrieval su knowledge base, ricerca web in tempo reale e chiamate ad API interne, con l’LLM che sceglie il tool giusto per query.

Il bot non risponde ai messaggi. Verifica che “Only Trigger on Mention” corrisponda a come stai testando — se attivo, devi @-menzionare il bot. Conferma che il canale in Slack Message Received corrisponda al canale in cui posti.

Il bot risponde ma la qualità è scarsa. Itera prima su backstory e goal dell’AI Agent — sono più impattanti del cambio di modello. Se la qualità rimane scarsa dopo l’iterazione del prompt, promuovi a un modello più forte nel componente LLM (Mini → standard → top-tier).

Errori di permesso dopo l’auth Slack. Riconnetti l’integrazione Slack nella scheda Integrations di FlowHunt e ri-concedi i permessi. Slack a volte invalida i token dopo cambi di proprietario del workspace.

Le risposte lunghe vengono troncate in Slack. Slack ha un limite di caratteri per messaggio. Aggiungi uno step di post-processing al flow per dividere risposte lunghe, o istruisci l’AI Agent nel suo goal a mantenere le risposte sotto i 3.000 caratteri quando posta in Slack.

L’intera configurazione — collegare Slack, costruire il flow, scegliere un modello — è un progetto di una sera in FlowHunt. Il flow che costruisci oggi funziona con qualsiasi modello futuro: quando usciranno GPT-6 o Claude 5, cambi il componente LLM e il resto continua a funzionare.

Inizia con il tier gratuito di FlowHunt , collega Slack e distribuisci uno Slackbot IA funzionante prima di pranzo.

Arshia è una AI Workflow Engineer presso FlowHunt. Con una formazione in informatica e una passione per l'IA, è specializzata nella creazione di workflow efficienti che integrano strumenti di intelligenza artificiale nelle attività quotidiane, migliorando produttività e creatività.

Il flow builder no-code di FlowHunt collega Slack con ogni grande LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — tramite un unico flow coerente. Senza codice, senza infrastruttura da gestire.

L’integrazione di Slack con FlowHunt consente una collaborazione AI senza soluzione di continuità direttamente all’interno del tuo workspace Slack. Porta qualsi...

FlowHunt 2.6.12 introduce l'integrazione con Slack, la classificazione delle intenzioni e il modello Gemini, migliorando le funzionalità del chatbot AI, la comp...

Integra FlowHunt con Slack per automatizzare la messaggistica, avviare workflow e mantenere il tuo team aggiornato con flussi alimentati dall'IA.

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.