Intégration Slack

L’intégration Slack de FlowHunt permet une collaboration IA fluide directement dans votre espace de travail Slack. Ajoutez n’importe quel Flow dans Slack, autom...

Connectez n’importe quel LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) à Slack avec le constructeur de flows no-code de FlowHunt. La configuration est la même pour chaque modèle — choisissez celui qui convient à votre cas d’usage et déployez en quelques minutes.

Ajouter un assistant IA à Slack signifiait autrefois choisir un fournisseur, écrire du code d’intégration et tout reconstruire quand un meilleur modèle apparaissait six mois plus tard. Avec FlowHunt, l’intégration est découplée du modèle : vous bâtissez le flow Slack une seule fois, branchez le LLM voulu — Claude, GPT, Gemini, Grok, Llama, Mistral — et le changez à tout moment sans toucher au reste.

Ce guide couvre toute la configuration. La première moitié est identique pour chaque modèle. La seconde moitié explique quel modèle choisir pour quel cas d’usage, avec des notes spécifiques par famille de LLM. Sautez à la section qui correspond à votre stack ou lisez tout depuis le début.

Slack est l’endroit où les équipes posent leurs questions. Un agent IA qui y vit y répond instantanément — sans changer pour un autre outil de chat, dashboard ou base de connaissances. Déploiements courants :

Le bot vit dans Slack — l’adoption est automatique, personne n’a à apprendre un nouvel outil.

La configuration est identique quel que soit le modèle d’IA choisi. Choisissez votre modèle à l’étape 4 ; tout le reste est identique.

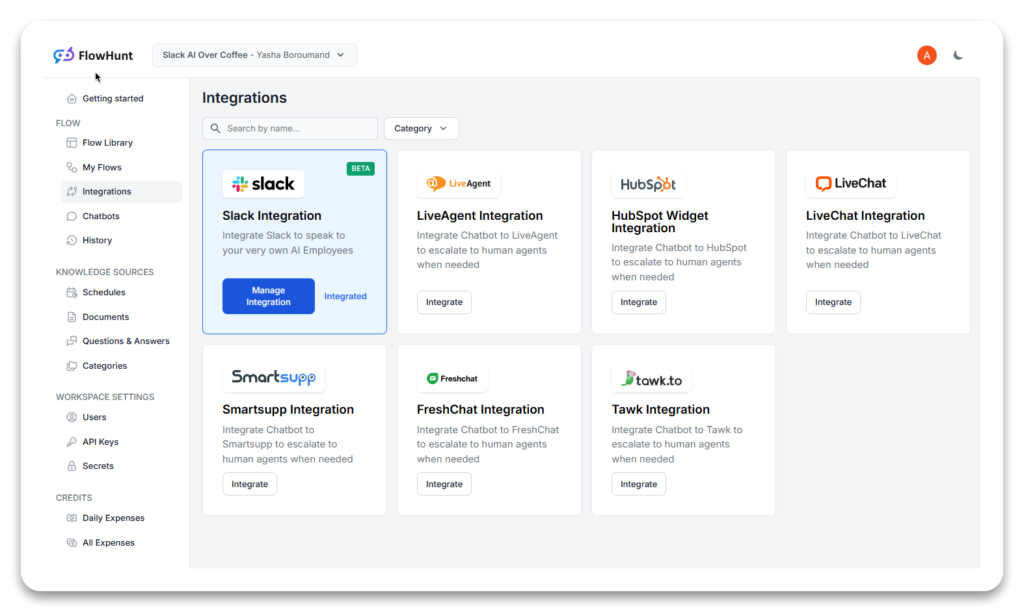

Connectez-vous à votre compte FlowHunt et ouvrez l’onglet Integrations. Sélectionnez Slack, cliquez sur Connect et autorisez l’app sur l’écran OAuth de Slack. Accordez les permissions de lecture/écriture demandées par FlowHunt — elles permettent au bot de recevoir les messages et de poster des réponses dans votre workspace.

L’URL de votre workspace apparaît en haut à gauche de l’app Slack. Une fois autorisé, Slack est connecté et utilisable dans n’importe quel flow.

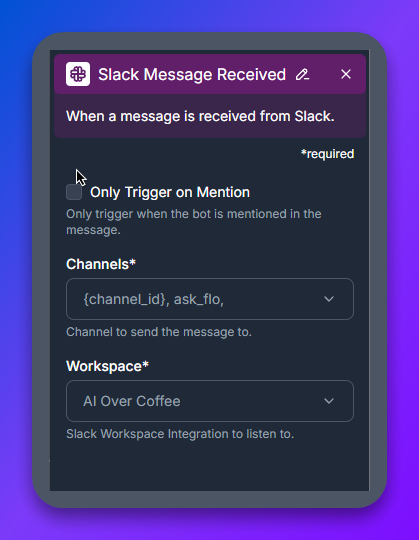

Dans le constructeur de flows FlowHunt, glissez un composant Slack Message Received sur le canvas. Ce bloc écoute les messages Slack entrants et déclenche le reste du flow.

Configurez deux paramètres :

#ai-assistant est la configuration la plus propre.

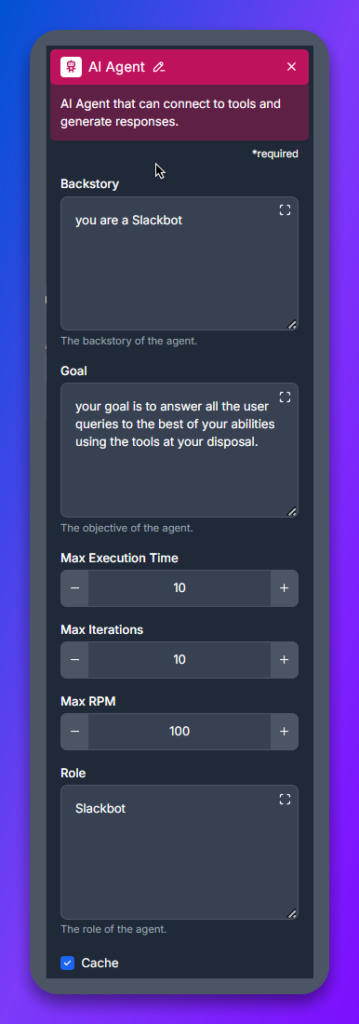

Le bloc AI Agent est la couche de raisonnement du bot. Il prend le message de l’utilisateur, décide des outils à utiliser et formule la réponse.

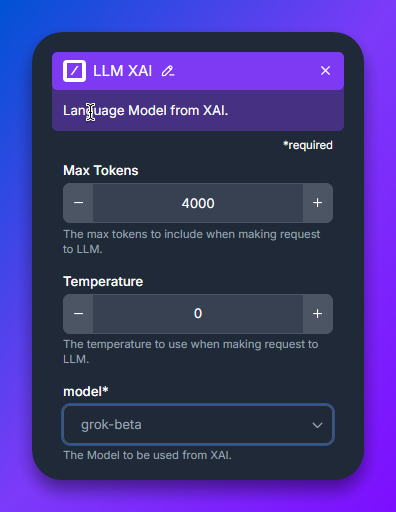

Connectez un composant LLM à l’AI Agent. C’est ici que vous choisissez quel modèle d’IA alimente le bot. FlowHunt a un composant LLM séparé par fournisseur — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — et dans chacun vous sélectionnez la variante précise du modèle.

C’est la seule étape qui diffère selon le modèle. Sautez à Choisissez le bon modèle d’IA pour une comparaison et des notes par famille.

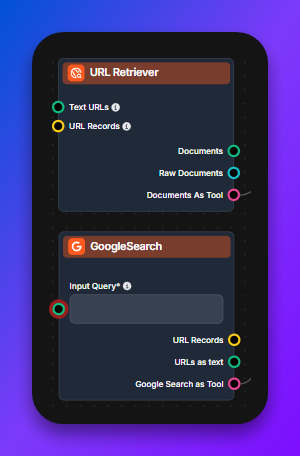

L’AI Agent devient nettement plus utile quand il peut utiliser des outils. Les courants :

Les outils sont indépendants du modèle. N’importe quel LLM choisi à l’étape 4 peut utiliser n’importe quel outil branché.

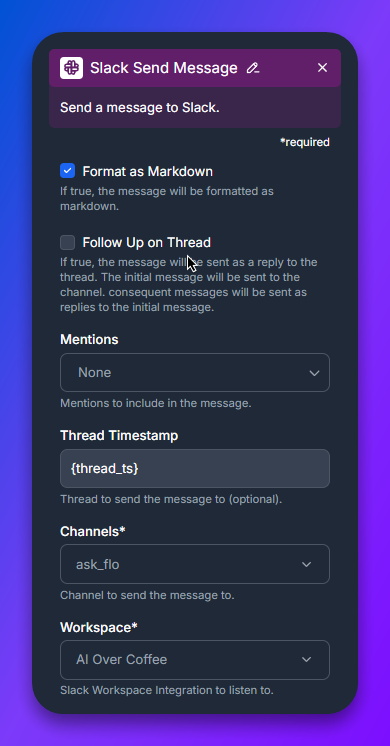

Terminez le flow avec un composant Slack Send Message, configuré pour le même canal et workspace qu’à l’étape 2. Sauvegardez le flow, ouvrez Slack et @-mentionnez le bot dans votre canal de test. Le bot devrait répondre en utilisant le modèle choisi à l’étape 4.

C’est toute la configuration. Changer de modèle plus tard est un changement en un clic à l’étape 4 — pas d’édition de code, pas de reconstruction de flow.

Chaque grande famille de LLM fonctionne dans le flow Slack de FlowHunt. Les différences se résument au coût, à la latence, à la fenêtre de contexte, à la profondeur de raisonnement et à la qualité du tool-calling. Utilisez le tableau pour pré-sélectionner, puis lisez la section spécifique à la famille pour les notes de configuration.

| Famille de modèle | Idéal pour | Latence | Coût | Notes |

|---|---|---|---|---|

| Claude (Anthropic) | Analyse long-contexte, raisonnement soigné, revue de code | Moyenne | Moyen–Élevé | Excellent pour suivre des instructions nuancées ; idéal Q&R interne sur docs |

| GPT / série o (OpenAI) | Polyvalent, écosystème d’outils large, multimodal | Faible–Moyen | Faible (mini) – Élevé (série o) | GPT-4o Mini est le sweet spot par défaut ; o1/o3 pour raisonnement difficile |

| Gemini (Google) | Énormes fenêtres de contexte, rapide, multimodal, ancré recherche | Faible | Faible–Moyen | 1.5 Pro gère 1M+ tokens ; idéal Q&R sur documents entiers |

| Grok (xAI) | Requêtes temps réel / actu, données X (Twitter), ton décontracté | Faible | Moyen | Meilleur quand le bot doit connaître l’actualité |

| Llama (Meta) | Déploiements self-hosted/privés, charges sensibles aux coûts | Selon hébergement | Faible (self-hosted) | Poids ouverts — quand la résidence des données compte |

| Mistral | Open-weight, bon coût/qualité, hébergement EU-friendly | Faible | Faible–Moyen | Mistral Large concurrence GPT-4o à moindre coût |

Choisissez-en un pour démarrer. Changer de modèle dans FlowHunt est un changement en un clic dans le composant LLM, donc trop réfléchir au choix initial ne paie pas — déployez avec un défaut sensé, mesurez la qualité sur du trafic Slack réel, itérez.

Chaque section ci-dessous est autonome. Choisissez la section de la famille que vous connectez et suivez les notes.

Claude est la famille de LLM d’Anthropic, idéale pour des Slackbots gérant Q&R interne nuancée, résumé de documents, revue de code et suivi soigné d’instructions. Pour connecter Claude à Slack, glissez le composant LLM Anthropic à l’étape 4 et choisissez la variante :

Pour des Slackbots de connaissance interne sur Notion ou Confluence, Claude 3.5 Sonnet plus Document Retriever est le point de départ le plus fiable.

Les modèles GPT et série o d’OpenAI sont le choix le plus large pour Slack — performances généralistes solides, le tool-calling le plus mature et input multimodal (vision, audio). Glissez le composant LLM OpenAI à l’étape 4 et choisissez la variante :

Pour la plupart des équipes : démarrez avec GPT-4o Mini. Promouvez vers GPT-4o ou o1 uniquement sur les flows où les utilisateurs se plaignent de la qualité.

Google Gemini est le choix le plus fort quand la fenêtre de contexte compte — Gemini 1.5 Pro gère plus d'1M tokens, suffisant pour passer des bases de code entières ou des jeux de documents en une seule requête Slack. Glissez le composant LLM Google à l’étape 4 et choisissez la variante :

Si votre Slackbot doit raisonner sur toute votre base de connaissances en une seule passe (sans étape de retrieval), la fenêtre de contexte de Gemini Pro est la réponse la plus propre.

xAI Grok s’intègre dans le flow Slack de FlowHunt comme les autres modèles — glissez le composant LLM xAI (ou le composant LLM OpenAI selon votre version FlowHunt) et choisissez la variante de Grok. La force distinctive de Grok est la connaissance temps réel — accès à l’information en direct y compris les données X (Twitter) — idéal quand le Slackbot a besoin de contexte d’actualité : actualités, données de marché, nouveautés. Combinez-le avec Google Search Tool pour un accès web encore plus large.

La famille Llama de Meta est l’option open-weight — utilisez-la quand résidence des données, self-hosting ou coût par token excluent les API hébergées. Glissez le composant LLM Meta à l’étape 4 et choisissez la variante :

Llama est la bonne réponse quand sécurité ou conformité exigent que le modèle tourne sur votre infrastructure, ou quand un fort volume de messages rend les coûts d’API hébergée prohibitifs.

Mistral est le concurrent européen open-weight — modèles forts, hébergement EU-friendly et bon rapport prix-performance. Glissez le composant LLM Mistral à l’étape 4 et choisissez la variante :

Choisissez Mistral quand la résidence des données UE compte, ou quand vous voulez la flexibilité open-weight avec une qualité proche du frontier.

Trois schémas de flow couvrent la plupart des déploiements Slack. Construisez l’un d’eux par-dessus la configuration ci-dessus en ajustant les outils et le prompt de l’AI Agent :

Ces schémas se combinent : un seul flow Slack peut combiner retrieval base de connaissances, recherche web en direct et appels API internes, le LLM choisissant l’outil adapté à chaque requête.

Le bot ne répond pas aux messages. Vérifiez que « Only Trigger on Mention » correspond à la façon dont vous testez — s’il est activé, vous devez @-mentionner le bot. Confirmez que le canal dans Slack Message Received correspond au canal où vous postez.

Le bot répond mais la réponse est mauvaise. Itérez d’abord sur backstory et goal de l’AI Agent — c’est plus impactant que changer de modèle. Si la qualité reste mauvaise après itération de prompt, promouvez vers un modèle plus fort dans le composant LLM (Mini → standard → top-tier).

Erreurs de permissions après l’auth Slack. Reconnectez l’intégration Slack dans l’onglet Integrations de FlowHunt et ré-accordez les permissions. Slack invalide parfois les tokens après changements de propriétaire de workspace.

Les longues réponses sont tronquées dans Slack. Slack a une limite de caractères par message. Ajoutez une étape de post-traitement au flow pour découper les réponses longues, ou instruisez l’AI Agent dans son goal de garder les réponses sous 3 000 caractères en postant dans Slack.

Toute la configuration — connecter Slack, bâtir le flow, choisir un modèle — est un projet d’une soirée dans FlowHunt. Le flow que vous bâtissez aujourd’hui fonctionne avec n’importe quel modèle futur : quand GPT-6 ou Claude 5 sortiront, vous changez le composant LLM et le reste continue.

Démarrez avec le tier gratuit de FlowHunt , connectez Slack et déployez un Slackbot IA fonctionnel avant le déjeuner.

Arshia est ingénieure en workflows d'IA chez FlowHunt. Avec une formation en informatique et une passion pour l’IA, elle se spécialise dans la création de workflows efficaces intégrant des outils d'IA aux tâches quotidiennes, afin d’accroître la productivité et la créativité.

Le constructeur de flows no-code de FlowHunt connecte Slack à chaque grand LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — via un flow unique et cohérent. Sans code, sans infrastructure à maintenir.

L’intégration Slack de FlowHunt permet une collaboration IA fluide directement dans votre espace de travail Slack. Ajoutez n’importe quel Flow dans Slack, autom...

Intégrez FlowHunt à Slack pour automatiser la messagerie, déclencher des workflows et garder votre équipe informée grâce à des flux alimentés par l'IA.

FlowHunt 2.6.12 introduit l'intégration Slack, la classification d'intentions et le modèle Gemini, améliorant la fonctionnalité du chatbot IA, les insights clie...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.