Slack-integratie

De Slack-integratie van FlowHunt maakt naadloze AI-samenwerking mogelijk, direct binnen je Slack-werkruimte. Haal elke Flow naar Slack, automatiseer workflows, ...

Verbind elke LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) met Slack via FlowHunt’s no-code flowbuilder. De setup is hetzelfde voor elk model — kies het model dat past bij jouw use case en lanceer in minuten.

Een AI-assistent aan Slack toevoegen betekende vroeger: een leverancier kiezen, integratiecode schrijven en alles opnieuw bouwen wanneer er zes maanden later een beter model uitkwam. Met FlowHunt is de integratie ontkoppeld van het model: je bouwt de Slack-flow één keer, plugt de gewenste LLM in — Claude, GPT, Gemini, Grok, Llama, Mistral — en wisselt deze op elk moment zonder de rest aan te raken.

Deze gids loopt door de volledige setup. De eerste helft is hetzelfde voor elk model. De tweede helft beschrijft welk model je voor welke use case kiest, met opmerkingen per LLM-familie. Spring naar het onderdeel dat bij jouw stack past, of lees van begin tot eind als je vanaf nul start.

Slack is waar teams vragen stellen. Een AI-agent die daar leeft beantwoordt ze direct — zonder context te wisselen naar een aparte chattool, dashboard of kennisbank. Veelvoorkomende implementaties:

De bot leeft in Slack, dus adoptie is automatisch — niemand hoeft een nieuwe tool te leren.

De setup is identiek, ongeacht welk AI-model je kiest. Je kiest het model in stap 4; al het andere blijft hetzelfde.

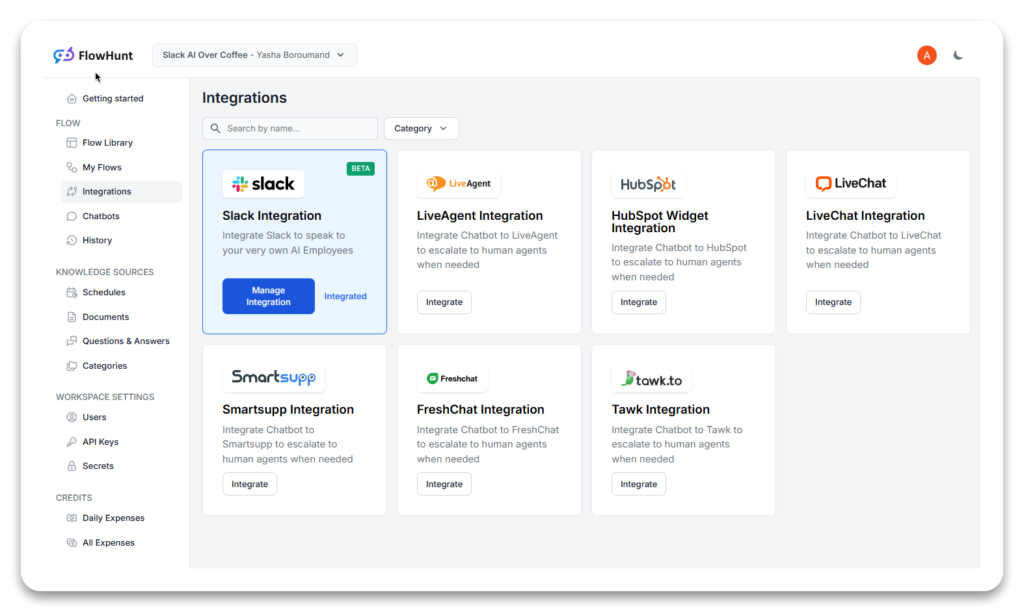

Log in op je FlowHunt -account en open het tabblad Integrations. Selecteer Slack, klik op Connect en autoriseer de app via het OAuth-scherm van Slack. Verleen de lees-/schrijfrechten die FlowHunt vraagt — die laten de bot berichten ontvangen en antwoorden plaatsen in jouw werkruimte.

De URL van je werkruimte verschijnt linksboven in de Slack-desktop- of webapp — kopieer die daar als FlowHunt erom vraagt. Eenmaal geautoriseerd is Slack verbonden en klaar voor gebruik in elke flow.

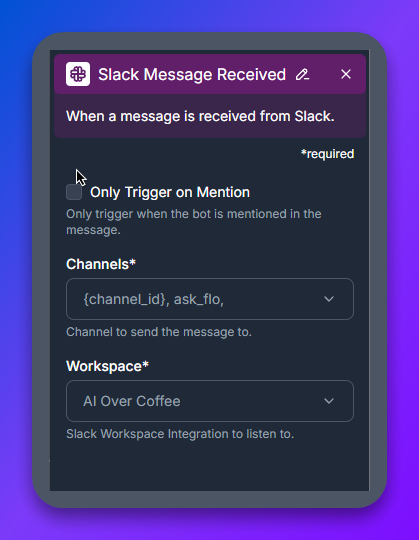

Sleep in de flowbuilder van FlowHunt een Slack Message Received-component op het canvas. Dit blok luistert naar binnenkomende Slack-berichten en triggert de rest van de flow.

Configureer twee instellingen:

#ai-assistant-kanaal is de schoonste opzet.

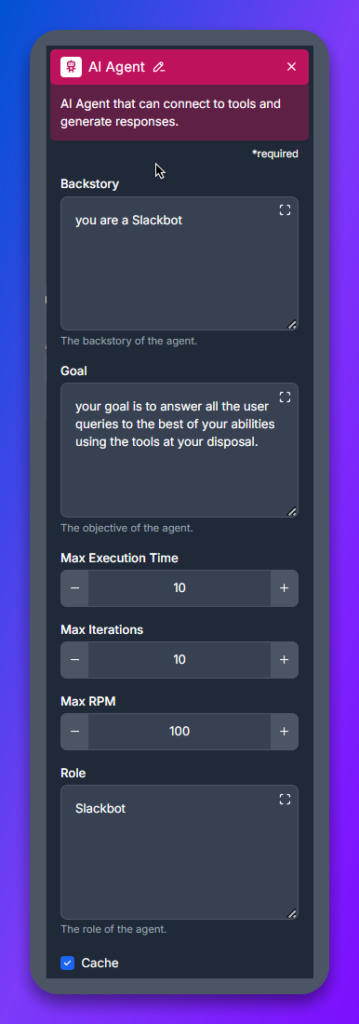

Het AI Agent-blok is de redeneerlaag van de bot. Het neemt het bericht van de gebruiker, beslist welke tools te gebruiken en formuleert het antwoord.

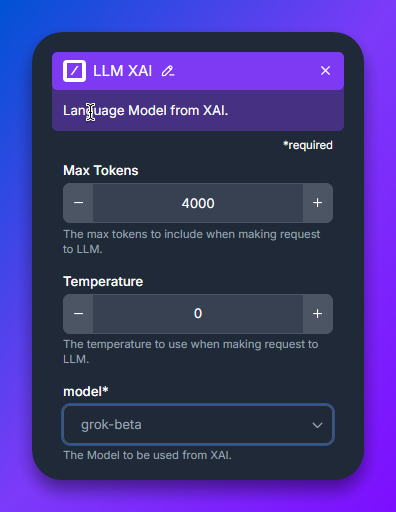

Verbind een LLM-component met de AI Agent. Hier kies je welk AI-model de bot aandrijft. FlowHunt heeft een aparte LLM-component voor elke provider — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — en binnen elk daarvan selecteer je de specifieke modelvariant.

Dit is de enige stap die per model verschilt. Spring naar het onderdeel Kies het juiste AI-model hieronder voor een vergelijking en notities per familie.

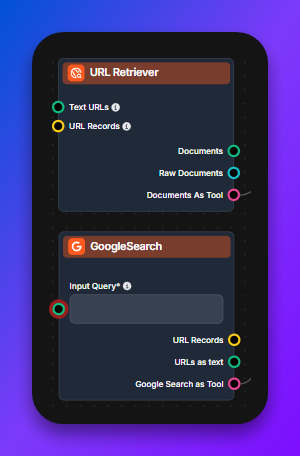

De AI Agent wordt aanzienlijk nuttiger wanneer hij tools kan gebruiken. Veelgebruikte:

Tools zijn modelonafhankelijk. Elke LLM die je in stap 4 kiest, kan elke tool gebruiken die je aansluit.

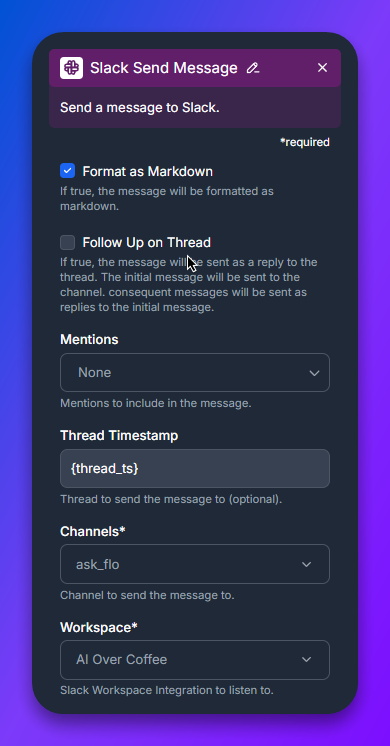

Sluit de flow af met een Slack Send Message-component, geconfigureerd voor hetzelfde kanaal en dezelfde werkruimte als in stap 2. Sla de flow op, open Slack en @-mention de bot in je testkanaal. De bot zou moeten reageren met het model dat je in stap 4 hebt gekozen.

Dat is de volledige setup. Modellen later wisselen is een wijziging van één klik in stap 4 — geen code-edits, geen flow-rebuild.

Elke grote LLM-familie werkt in de Slack-flow van FlowHunt. De verschillen zitten in kosten, latentie, contextvenster, redeneerdiepte en kwaliteit van tool-calling. Gebruik de tabel om een shortlist te maken en lees daarna het familiespecifieke onderdeel voor setupnotities.

| Modelfamilie | Beste voor | Latentie | Kosten | Notities |

|---|---|---|---|---|

| Claude (Anthropic) | Analyse met lange context, zorgvuldig redeneren, codereview | Gemiddeld | Gemiddeld–Hoog | Sterk in het volgen van genuanceerde instructies; uitstekend voor interne Q&A over documenten |

| GPT / o-serie (OpenAI) | Algemeen gebruik, breed tool-ecosysteem, multimodaal | Laag–Gemiddeld | Laag (mini) – Hoog (o-serie) | GPT-4o Mini is de standaard sweet spot; o1 / o3 voor zware redeneertaken |

| Gemini (Google) | Enorme contextvensters, snel multimodaal, search-grounded | Laag | Laag–Gemiddeld | 1.5 Pro verwerkt 1M+ tokens; uitstekend voor Slack-Q&A over hele documenten |

| Grok (xAI) | Realtime / nieuwsbewuste vragen, X (Twitter)-data, casual toon | Laag | Gemiddeld | Beste keuze als de bot besef nodig heeft van actuele gebeurtenissen |

| Llama (Meta) | Self-hosted / private deployments, kostengevoelige workloads | Afhankelijk van host | Laag (self-hosted) | Open weights — gebruik wanneer dataresidentie van belang is |

| Mistral | Open weights, balans tussen kosten/kwaliteit, EU-vriendelijke hosting | Laag | Laag–Gemiddeld | Mistral Large concurreert met GPT-4o tegen lagere kosten |

Kies er één om te beginnen. Modellen wisselen in FlowHunt is een wijziging van één klik in de LLM-component, dus te veel nadenken over de eerste keuze loont niet — lanceer met een verstandige standaard, meet de kwaliteit op echt Slack-verkeer, itereer.

Elk onderdeel hieronder staat op zichzelf. Kies het onderdeel voor de modelfamilie die je verbindt en volg de notities ervan.

Claude is Anthropic’s familie van LLM’s, goed geschikt voor Slackbots die genuanceerde interne Q&A, documentsamenvatting, codereview en zorgvuldig instructies volgen aankunnen. Om Claude met Slack te verbinden, sleep je het LLM Anthropic-component in stap 4 en kies je de variant:

Voor interne-kennis-Slackbots over Notion of Confluence is Claude 3.5 Sonnet plus een Document Retriever het meest betrouwbare startpunt.

De GPT- en o-seriemodellen van OpenAI zijn de breedste keuze voor Slack — sterke algemene prestaties, de meest volwassen tool-calling en multimodale invoer (vision, audio). Sleep het LLM OpenAI-component in stap 4 en kies de variant:

Voor de meeste teams: begin met GPT-4o Mini. Promoveer alleen tot GPT-4o of o1 op flows waar gebruikers klagen over de antwoordkwaliteit.

Google Gemini is de sterkste keuze wanneer het contextvenster ertoe doet — Gemini 1.5 Pro verwerkt meer dan 1M tokens, genoeg om hele codebases of documentsets in één Slack-vraag te stoppen. Sleep het LLM Google-component in stap 4 en kies de variant:

Als je Slackbot in één keer over je hele kennisbank moet redeneren (zonder retrieval-stap), is het contextvenster van Gemini Pro het schoonste antwoord.

xAI Grok is op dezelfde manier in de Slack-flow van FlowHunt ingebouwd als de andere modellen — sleep het LLM xAI-component (of gebruik het LLM OpenAI-component dat naar de Grok-endpoint wijst, afhankelijk van je FlowHunt-versie) en kies de Grok-variant. Het onderscheidende kenmerk van Grok is realtime-bewustzijn — het heeft toegang tot live-informatie, inclusief X (Twitter)-data, wat het de beste keuze maakt wanneer de Slackbot context van actuele gebeurtenissen nodig heeft: nieuws, marktdata, breaking developments. Combineer het met de Google Search Tool voor nog bredere webtoegang.

De Llama-familie van Meta is de open-weight optie — gebruik deze wanneer dataresidentie, self-hosting of kosten per token gehoste API’s uitsluiten. Sleep het LLM Meta-component in stap 4 en kies de variant:

Llama is het juiste antwoord wanneer je security- of compliance-team eist dat het model draait op infrastructuur die jij beheert, of wanneer een hoog berichtvolume de kosten van gehoste API’s prohibitief maakt.

Mistral is de Europese open-weight uitdager — sterke modellen, EU-vriendelijke hosting en een goede prijs-prestatieverhouding. Sleep het LLM Mistral-component in stap 4 en kies de variant:

Kies Mistral wanneer EU-dataresidentie ertoe doet, of wanneer je open-weight flexibiliteit wilt met dichter-bij-frontier kwaliteit dan Llama 3.x op sommige benchmarks.

Drie flowpatronen dekken de meeste Slack-deployments. Bouw elk ervan bovenop de bovenstaande setup door de tools en prompt van de AI Agent aan te passen:

Deze patronen stapelen netjes: één enkele Slack-flow kan kennisbank-retrieval, live webzoekopdrachten en interne API-calls combineren, waarbij de LLM per query de juiste tool kiest.

De bot reageert niet op berichten. Controleer of “Only Trigger on Mention” overeenkomt met hoe je test — als deze aanstaat, moet je de bot @-mentionen. Bevestig dat het kanaal in Slack Message Received overeenkomt met het kanaal waarin je post.

De bot reageert maar het antwoord is matig. Itereer eerst op de backstory en goal van de AI Agent — die hebben meer impact dan modellen wisselen. Als de kwaliteit na promptiteratie nog niet op orde is, promoveer dan naar een sterker model in de LLM-component (Mini → standaard → top).

Permission-fouten na Slack-auth. Verbind de Slack-integratie opnieuw in het tabblad Integrations van FlowHunt en geef opnieuw rechten. Slack invalideert af en toe tokens na wijzigingen van de werkruimte-eigenaar.

Lange antwoorden worden in Slack afgekapt. Slack heeft een tekenlimiet per bericht. Voeg een nabewerkingsstap in de flow toe om lange antwoorden op te splitsen, of instrueer de AI Agent in zijn goal om antwoorden onder de 3.000 tekens te houden bij plaatsing in Slack.

De hele setup — Slack koppelen, de flow bouwen, een model kiezen — is een avondprojectje in FlowHunt. De flow die je vandaag bouwt werkt met elk toekomstig model: wanneer GPT-6 of Claude 5 uitkomt, wissel je het LLM-component en de rest van de flow blijft draaien.

Begin met FlowHunt’s gratis abonnement , koppel Slack en lanceer een werkende AI-Slackbot vóór de lunch.

Arshia is een AI Workflow Engineer bij FlowHunt. Met een achtergrond in computerwetenschappen en een passie voor AI, specialiseert zij zich in het creëren van efficiënte workflows die AI-tools integreren in dagelijkse taken, waardoor productiviteit en creativiteit worden verhoogd.

FlowHunt's no-code flowbuilder verbindt Slack met elke grote LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — via één consistente flow. Geen code, geen infrastructuur om te beheren.

De Slack-integratie van FlowHunt maakt naadloze AI-samenwerking mogelijk, direct binnen je Slack-werkruimte. Haal elke Flow naar Slack, automatiseer workflows, ...

FlowHunt 2.6.12 introduceert de Slack-integratie, intentieclassificatie en het Gemini-model, waarmee de functionaliteit van AI-chatbots, klantinzichten en teamw...

Integreer FlowHunt met Slack om berichten te automatiseren, workflows te triggeren en je team op de hoogte te houden met AI-gestuurde flows.

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.