Integrare Slack

Integrarea Slack a FlowHunt permite colaborare AI fără întreruperi direct în workspace-ul tău Slack. Adu orice Flow în Slack, automatizează fluxuri de lucru, of...

Conectați orice LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) la Slack folosind constructorul de fluxuri no-code de la FlowHunt. Configurarea este aceeași pentru orice model — alegeți modelul potrivit cazului dvs. de utilizare și lansați în câteva minute.

Adăugarea unui asistent AI în Slack însemna până acum alegerea unui furnizor, scrierea de cod de integrare și reconstruirea totală atunci când apărea un model mai bun șase luni mai târziu. Cu FlowHunt, integrarea este decuplată de model: construiți o singură dată fluxul Slack, conectați LLM-ul dorit — Claude, GPT, Gemini, Grok, Llama, Mistral — și schimbați-l oricând fără să atingeți restul.

Acest ghid parcurge configurarea completă. Prima jumătate este aceeași pentru orice model. A doua jumătate detaliază ce model să alegeți pentru fiecare caz de utilizare, cu note specifice fiecărei familii de LLM-uri. Săriți la secțiunea care se potrivește stack-ului dvs. sau citiți de la capăt la coadă dacă porniți de la zero.

Slack este locul în care echipele pun întrebări. Un agent AI care trăiește acolo le răspunde instantaneu — fără a comuta contextul către un alt instrument de chat, dashboard sau bază de cunoștințe. Implementări frecvente:

Botul trăiește în Slack, deci adopția este automată — nimeni nu trebuie să învețe un instrument nou.

Configurarea este identică indiferent de modelul AI ales. Selectați modelul la pasul 4; restul rămâne neschimbat.

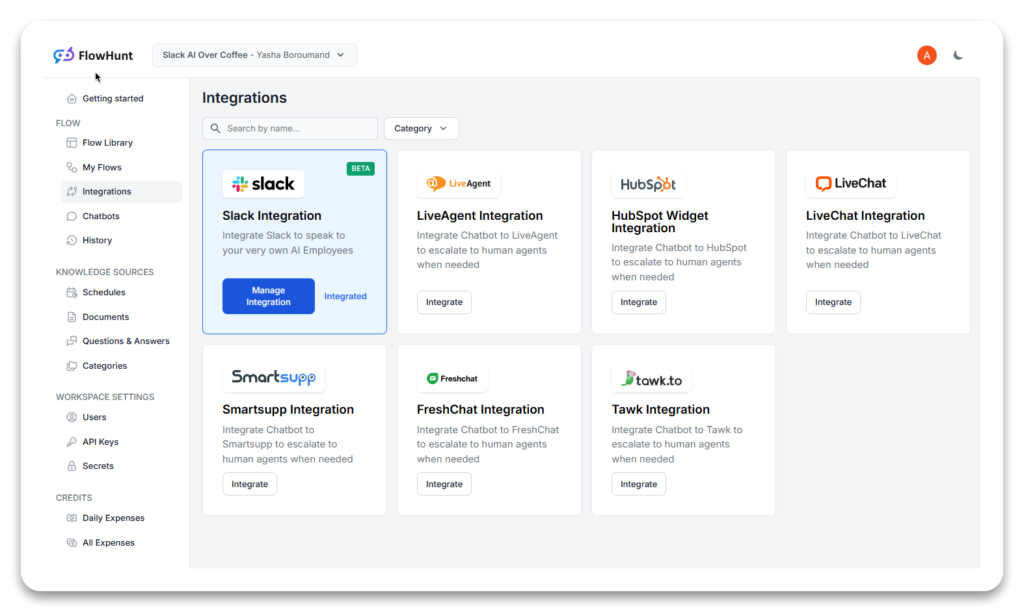

Conectați-vă la contul FlowHunt și deschideți tab-ul Integrations. Selectați Slack, apăsați Connect și autorizați aplicația pe ecranul OAuth al Slack. Acordați permisiunile de citire/scriere solicitate de FlowHunt — acestea permit botului să primească mesaje și să posteze răspunsuri în workspace-ul dvs.

URL-ul workspace-ului dvs. apare în colțul din stânga sus al aplicației Slack desktop sau web — copiați-l de acolo dacă FlowHunt vi-l cere. Odată autorizat, Slack este conectat și gata de utilizare în orice flux.

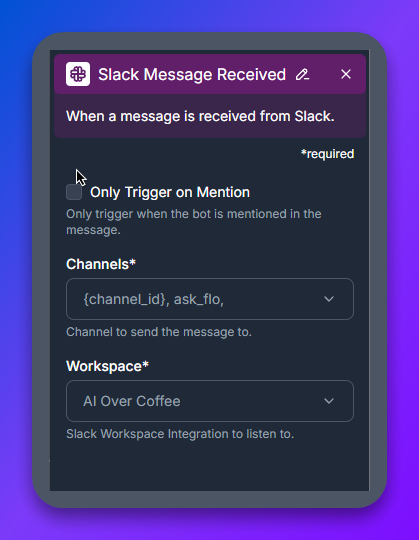

În constructorul de fluxuri al FlowHunt, plasați o componentă Slack Message Received pe canvas. Acest bloc ascultă mesajele primite în Slack și declanșează restul fluxului.

Configurați două setări:

#ai-assistant este cea mai curată configurare.

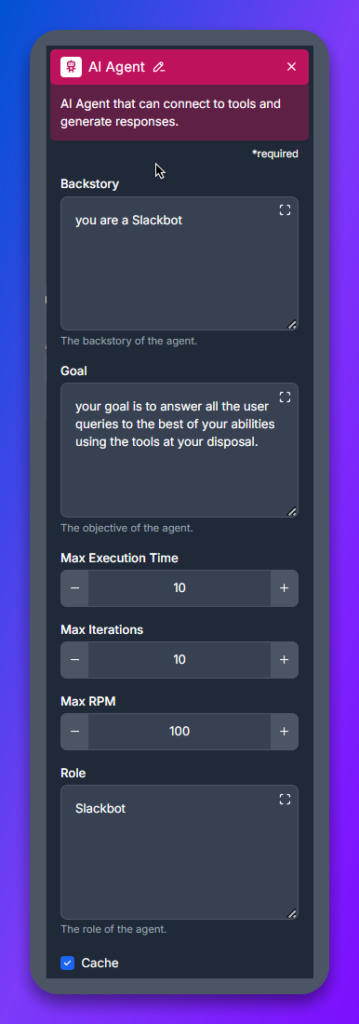

Blocul AI Agent este stratul de raționament al botului. Preia mesajul utilizatorului, decide ce instrumente să folosească și formulează răspunsul.

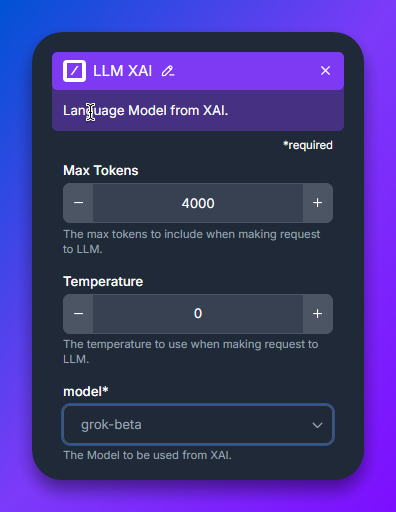

Conectați o componentă LLM la AI Agent. Aici alegeți ce model AI alimentează botul. FlowHunt are o componentă LLM separată pentru fiecare furnizor — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — iar în fiecare selectați varianta specifică.

Acesta este singurul pas care diferă în funcție de model. Săriți la secțiunea Alegeți modelul AI potrivit de mai jos pentru o comparație și note pe familie.

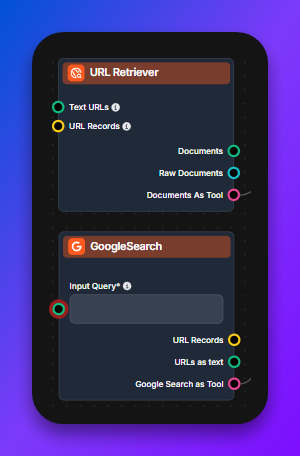

AI Agent devine semnificativ mai util când poate folosi instrumente. Cele frecvente:

Instrumentele sunt agnostice de model. Orice LLM ales la pasul 4 poate folosi orice instrument conectat.

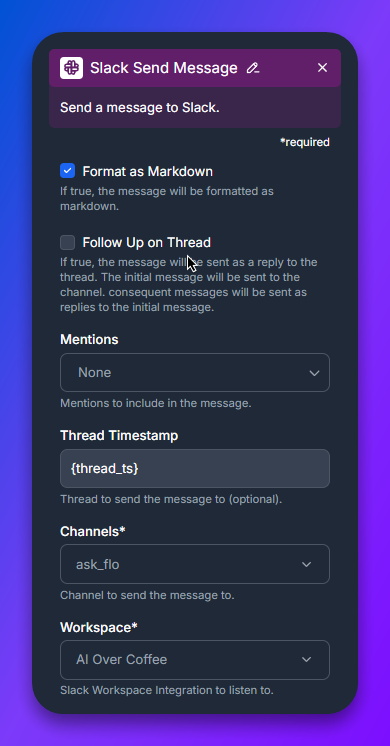

Finalizați fluxul cu o componentă Slack Send Message, configurată pentru același canal și workspace ca la pasul 2. Salvați fluxul, deschideți Slack și menționați botul cu @ în canalul de test. Botul ar trebui să răspundă folosind modelul ales la pasul 4.

Aceasta este toată configurarea. Schimbarea modelelor ulterior este o modificare cu un singur clic la pasul 4 — fără editări de cod, fără reconstrucția fluxului.

Fiecare familie majoră de LLM-uri funcționează în fluxul Slack al FlowHunt. Diferențele țin de cost, latență, fereastră de context, profunzime de raționament și calitate a apelării instrumentelor. Folosiți tabelul pentru a face o listă scurtă, apoi citiți secțiunea specifică familiei pentru note de configurare.

| Familia de modele | Cea mai bună pentru | Latență | Cost | Note |

|---|---|---|---|---|

| Claude (Anthropic) | Analiză cu context lung, raționament atent, revizuire de cod | Medie | Medie–Mare | Foarte bună la urmărirea instrucțiunilor nuanțate; excelentă pentru Q&A intern peste documente |

| GPT / seria o (OpenAI) | Uz general, ecosistem larg de instrumente, multimodal | Scăzută–Medie | Scăzut (mini) – Mare (seria o) | GPT-4o Mini este punctul ideal implicit; o1 / o3 pentru raționament dificil |

| Gemini (Google) | Ferestre de context masive, multimodal rapid, ancorat în căutare | Scăzută | Scăzut–Mediu | 1.5 Pro gestionează 1M+ tokeni; excelent pentru Q&A pe document întreg în Slack |

| Grok (xAI) | Interogări în timp real / cu conștientizarea știrilor, date X (Twitter), ton casual | Scăzută | Mediu | Ideal când botul are nevoie de conștientizarea evenimentelor curente |

| Llama (Meta) | Implementări auto-găzduite / private, sarcini sensibile la cost | Depinde de host | Scăzut (auto-găzduit) | Greutăți deschise — folosiți când contează rezidența datelor |

| Mistral | Greutăți deschise, raport echilibrat cost/calitate, găzduire prietenoasă cu UE | Scăzută | Scăzut–Mediu | Mistral Large concurează cu GPT-4o la cost mai mic |

Alegeți unul pentru a începe. Schimbarea modelelor în FlowHunt este o modificare cu un clic pe componenta LLM, deci nu merită să gândiți excesiv alegerea inițială — lansați cu o opțiune implicită rezonabilă, măsurați calitatea pe traficul real din Slack, iterați.

Fiecare secțiune de mai jos este de sine stătătoare. Alegeți secțiunea pentru familia modelului pe care îl conectați și urmați notele.

Claude este familia de LLM-uri Anthropic, potrivită pentru Slackbot-uri care gestionează Q&A intern nuanțat, sumarizare de documente, revizuire de cod și urmărirea atentă a instrucțiunilor. Pentru a conecta Claude la Slack, plasați componenta LLM Anthropic la pasul 4 și alegeți varianta:

Pentru Slackbot-uri de cunoștințe interne peste Notion sau Confluence, Claude 3.5 Sonnet plus un Document Retriever este punctul de pornire cel mai fiabil.

Modelele GPT și seria o de la OpenAI sunt cea mai largă alegere pentru Slack — performanță generală puternică, cea mai matură apelare a instrumentelor și intrare multimodală (vedere, audio). Plasați componenta LLM OpenAI la pasul 4 și alegeți varianta:

Pentru majoritatea echipelor, începeți cu GPT-4o Mini. Promovați la GPT-4o sau o1 doar pe fluxurile unde utilizatorii se plâng de calitatea răspunsurilor.

Google Gemini este cea mai puternică alegere când contează fereastra de context — Gemini 1.5 Pro gestionează peste 1M tokeni, suficient pentru a încărca baze de cod întregi sau seturi de documente într-o singură interogare Slack. Plasați componenta LLM Google la pasul 4 și alegeți varianta:

Dacă Slackbot-ul dvs. trebuie să raționeze peste întreaga bază de cunoștințe într-o singură trecere (fără pas de retrieval), fereastra de context a Gemini Pro este răspunsul cel mai curat.

xAI Grok este integrat în fluxul Slack al FlowHunt în același mod ca celelalte modele — plasați componenta LLM xAI (sau folosiți componenta LLM OpenAI care indică spre endpoint-ul Grok, în funcție de versiunea FlowHunt) și alegeți varianta Grok. Trăsătura distinctivă a Grok este conștientizarea în timp real — are acces la informații live, inclusiv date X (Twitter), făcându-l cea mai bună alegere când Slackbot-ul are nevoie de context al evenimentelor curente: știri, date de piață, evoluții recente. Asociați-l cu Google Search Tool pentru un acces web și mai larg.

Familia Llama de la Meta este opțiunea cu greutăți deschise — folosiți-o când rezidența datelor, auto-găzduirea sau costul per token exclud API-urile găzduite. Plasați componenta LLM Meta la pasul 4 și alegeți varianta:

Llama este răspunsul potrivit când echipa de securitate sau conformitate cere ca modelul să ruleze pe infrastructură pe care o controlați, sau când volumul mare de mesaje face costurile API-urilor găzduite prohibitive.

Mistral este concurentul european cu greutăți deschise — modele puternice, găzduire prietenoasă cu UE și raport bun preț-performanță. Plasați componenta LLM Mistral la pasul 4 și alegeți varianta:

Alegeți Mistral când contează rezidența datelor în UE, sau când doriți flexibilitate cu greutăți deschise și o calitate mai apropiată de frontieră decât Llama 3.x în unele benchmark-uri.

Trei modele de flux acoperă majoritatea implementărilor Slack. Construiți oricare dintre ele peste configurarea de mai sus, ajustând instrumentele și prompt-ul AI Agent-ului:

Aceste modele se suprapun curat: un singur flux Slack poate combina retrieval-ul din baza de cunoștințe, căutarea web live și apelurile API interne, LLM-ul alegând instrumentul potrivit pentru fiecare interogare.

Botul nu răspunde la mesaje. Verificați ca „Only Trigger on Mention" să corespundă modului în care testați — dacă este activat, trebuie să menționați botul cu @. Confirmați că în Slack Message Received canalul corespunde cu cel în care postați.

Botul răspunde, dar răspunsul este slab. Iterați mai întâi pe backstory și goal-ul AI Agent-ului — au mai mult impact decât schimbarea modelelor. Dacă, după iterarea prompt-ului, calitatea încă lasă de dorit, promovați la un model mai puternic în componenta LLM (Mini → standard → vârf).

Erori de permisiuni după autentificarea Slack. Reconectați integrarea Slack în tab-ul Integrations al FlowHunt și acordați din nou permisiunile. Slack invalidează ocazional token-urile după schimbări ale proprietarului workspace-ului.

Răspunsurile lungi sunt trunchiate în Slack. Slack are o limită de caractere per mesaj. Adăugați un pas de post-procesare în flux care să împartă răspunsurile lungi sau instruiți AI Agent-ul în goal să păstreze răspunsurile sub 3.000 de caractere când postează în Slack.

Toată configurarea — conectarea Slack, construirea fluxului, alegerea unui model — este un proiect de o seară în FlowHunt. Fluxul construit astăzi funcționează cu orice model viitor: când GPT-6 sau Claude 5 vor fi lansate, schimbați componenta LLM și restul fluxului continuă să ruleze.

Începeți cu planul gratuit FlowHunt , conectați Slack și lansați un Slackbot AI funcțional înainte de prânz.

Arshia este Inginer de Fluxuri AI la FlowHunt. Cu o pregătire în informatică și o pasiune pentru inteligența artificială, el este specializat în crearea de fluxuri eficiente care integrează instrumente AI în sarcinile de zi cu zi, sporind productivitatea și creativitatea.

Constructorul de fluxuri no-code de la FlowHunt conectează Slack la toate LLM-urile majore — Claude, GPT, Gemini, Grok, Llama, Mistral — printr-un singur flux consistent. Fără cod, fără infrastructură de gestionat.

Integrarea Slack a FlowHunt permite colaborare AI fără întreruperi direct în workspace-ul tău Slack. Adu orice Flow în Slack, automatizează fluxuri de lucru, of...

FlowHunt 2.6.12 introduce integrarea Slack, clasificarea intentiilor și modelul Gemini, îmbunătățind funcționalitatea chatbot-ului AI, înțelegerea clienților și...

Integrează FlowHunt cu Slack pentru a automatiza mesajele, a declanșa fluxuri de lucru și a-ți menține echipa la curent cu fluxuri alimentate de AI.

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.