Integracja ze Slackiem

Integracja FlowHunt ze Slackiem umożliwia płynną współpracę AI bezpośrednio w Twoim środowisku Slack. Przenieś dowolny Flow do Slacka, automatyzuj procesy, zape...

Podłącz dowolny LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) do Slacka za pomocą no-code flow buildera od FlowHunt. Konfiguracja jest taka sama dla każdego modelu — wybierz model dopasowany do swojego use case i uruchom go w kilka minut.

Dodanie asystenta AI do Slacka kiedyś oznaczało wybór dostawcy, napisanie kodu integracyjnego i przebudowę całości, gdy pół roku później pojawiał się lepszy model. Z FlowHunt integracja jest oddzielona od modelu: budujesz flow Slacka raz, podłączasz wybrany LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — i wymieniasz go w dowolnym momencie bez ruszania reszty.

Ten przewodnik przeprowadza przez całą konfigurację. Pierwsza połowa jest taka sama dla każdego modelu. Druga połowa pokazuje, który model wybrać do jakiego use case, z uwagami specyficznymi dla każdej rodziny LLM. Przeskocz do sekcji pasującej do Twojego stacku albo przeczytaj od początku do końca, jeśli zaczynasz od zera.

Slack to miejsce, w którym zespoły zadają pytania. Agent AI, który tam żyje, odpowiada na nie natychmiast — bez przełączania kontekstu na osobny czat, dashboard czy bazę wiedzy. Typowe wdrożenia:

Bot żyje w Slacku, więc adopcja jest automatyczna — nikt nie musi uczyć się nowego narzędzia.

Konfiguracja jest identyczna niezależnie od tego, który model AI wybierzesz. Model wybierasz w kroku 4; wszystko inne pozostaje takie samo.

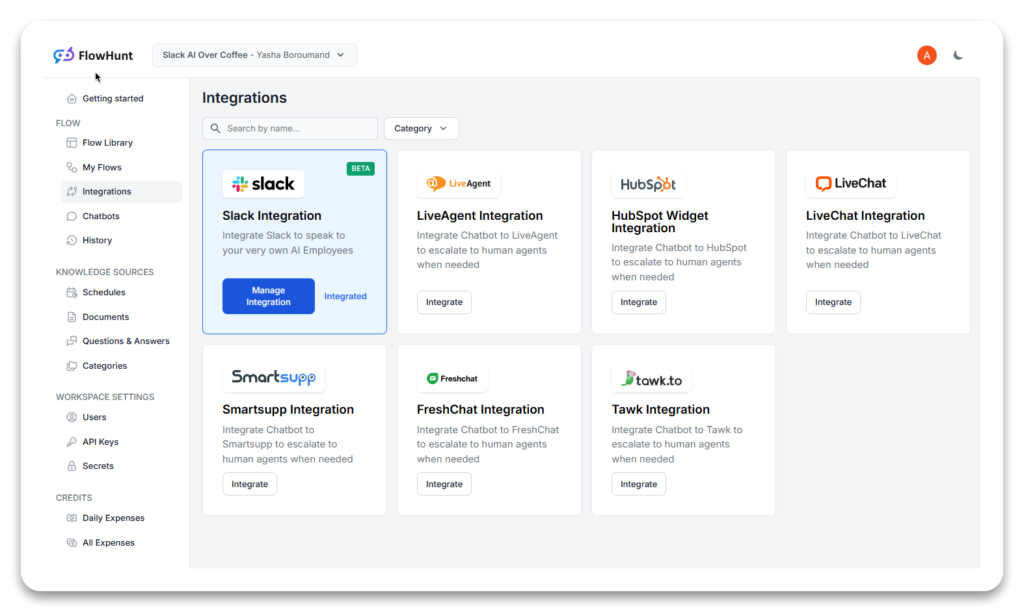

Zaloguj się do swojego konta FlowHunt i otwórz zakładkę Integrations. Wybierz Slack, kliknij Connect i autoryzuj aplikację na ekranie OAuth Slacka. Nadaj uprawnienia odczytu/zapisu, których FlowHunt wymaga — pozwalają botowi odbierać wiadomości i publikować odpowiedzi w Twoim workspace.

URL Twojego workspace znajdziesz w lewym górnym rogu aplikacji desktopowej lub webowej Slacka — skopiuj go stamtąd, jeśli FlowHunt o niego poprosi. Po autoryzacji Slack jest połączony i gotowy do użycia w dowolnym flow.

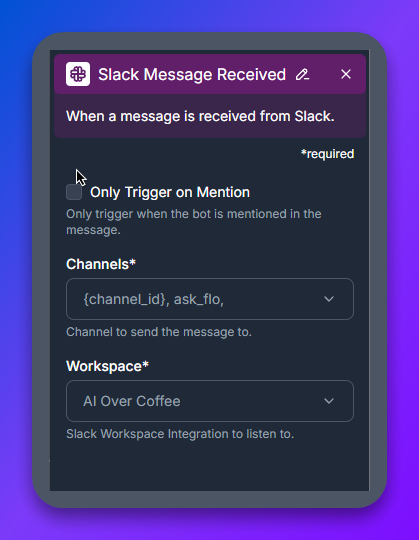

We flow builderze FlowHunt upuść na płótno komponent Slack Message Received. Ten blok nasłuchuje przychodzących wiadomości ze Slacka i uruchamia resztę flow.

Skonfiguruj dwa ustawienia:

#ai-assistant to najczystsze rozwiązanie.

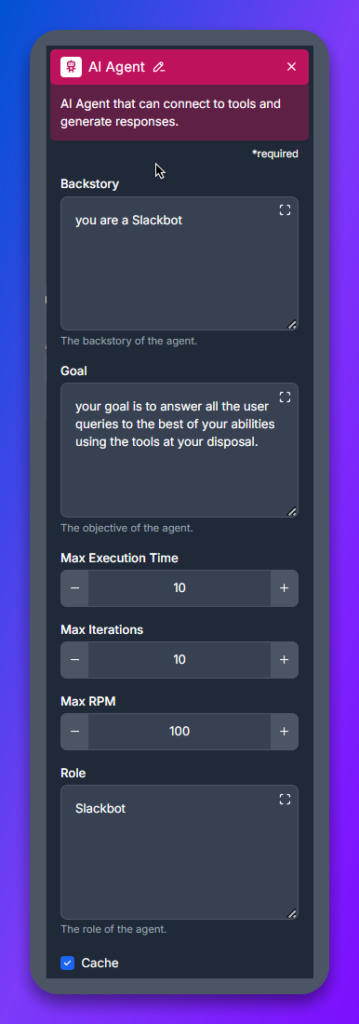

Blok AI Agent to warstwa rozumowania bota. Przyjmuje wiadomość użytkownika, decyduje, jakich narzędzi użyć, i tworzy odpowiedź.

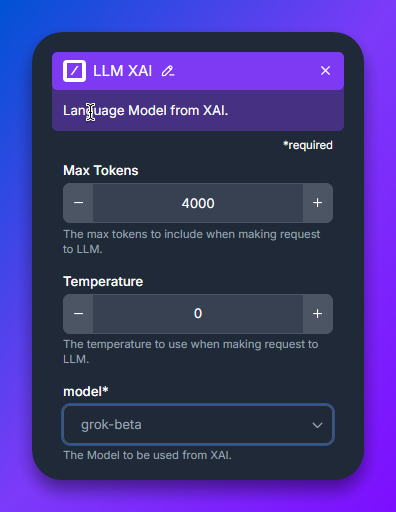

Podłącz komponent LLM do AI Agenta. Tutaj wybierasz, który model AI napędza bota. FlowHunt ma osobny komponent LLM dla każdego dostawcy — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — a w każdym wybierasz konkretny wariant modelu.

To jedyny krok różniący się między modelami. Przejdź niżej do sekcji Wybierz właściwy model AI , gdzie znajdziesz porównanie i uwagi dla poszczególnych rodzin.

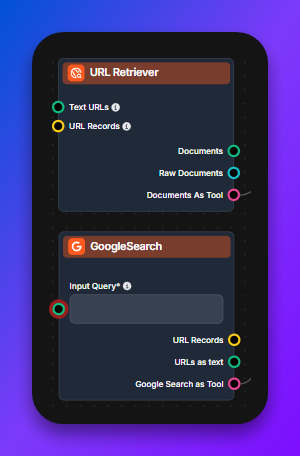

AI Agent staje się znacznie bardziej użyteczny, gdy może korzystać z narzędzi. Najczęściej stosowane:

Narzędzia są niezależne od modelu. Każdy LLM, który wybierzesz w kroku 4, może użyć każdego narzędzia, które podłączysz.

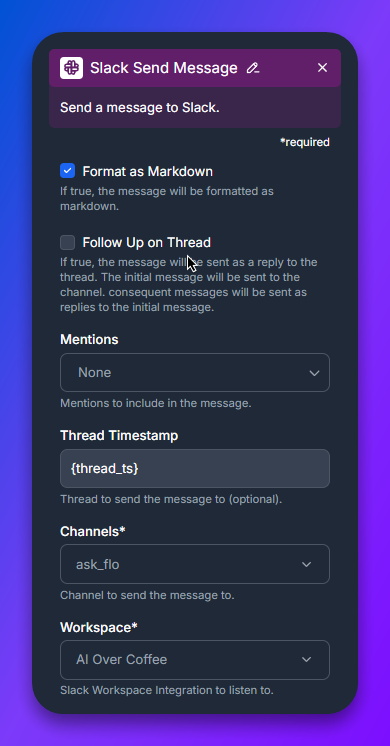

Zakończ flow komponentem Slack Send Message, skonfigurowanym dla tego samego kanału i workspace co w kroku 2. Zapisz flow, otwórz Slacka i @-wspomnij bota w kanale testowym. Bot powinien odpowiedzieć, używając modelu wybranego w kroku 4.

To cała konfiguracja. Późniejsza zmiana modelu to jedno kliknięcie w kroku 4 — bez edycji kodu, bez przebudowywania flow.

Każda główna rodzina LLM działa w Slack flow FlowHunt. Różnice sprowadzają się do kosztu, opóźnień, rozmiaru okna kontekstowego, głębi rozumowania i jakości wywoływania narzędzi. Najpierw zawęź wybór za pomocą tabeli, a potem przeczytaj sekcję dotyczącą konkretnej rodziny.

| Rodzina modeli | Najlepsza do | Opóźnienia | Koszt | Uwagi |

|---|---|---|---|---|

| Claude (Anthropic) | Analizy długiego kontekstu, ostrożnego rozumowania, code review | Średnie | Średni–wysoki | Świetnie podąża za niuansowanymi instrukcjami; doskonały do wewnętrznego Q&A nad dokumentami |

| GPT / o-series (OpenAI) | Zastosowań ogólnych, szerokiego ekosystemu narzędzi, multimodalności | Niskie–średnie | Niski (mini) – wysoki (o-series) | GPT-4o Mini to domyślny złoty środek; o1 / o3 do trudnego rozumowania |

| Gemini (Google) | Ogromnych okien kontekstowych, szybkiej multimodalności, ugruntowania w wyszukiwaniu | Niskie | Niski–średni | 1.5 Pro obsługuje ponad 1M tokenów; świetny do Q&A nad całymi dokumentami w Slacku |

| Grok (xAI) | Zapytań o aktualne wydarzenia, danych z X (Twitter), swobodnego tonu | Niskie | Średni | Najlepszy, gdy bot potrzebuje świadomości bieżących wydarzeń |

| Llama (Meta) | Wdrożeń self-hosted / prywatnych, obciążeń wrażliwych kosztowo | Zależy od hostingu | Niski (self-hosted) | Otwarte wagi — przydatne, gdy liczy się rezydencja danych |

| Mistral | Otwartych wag, zrównoważonego kosztu/jakości, hostingu przyjaznego UE | Niskie | Niski–średni | Mistral Large rywalizuje z GPT-4o przy niższych kosztach |

Zacznij od jednego. Zmiana modelu we FlowHunt to jednokliknięciowa modyfikacja komponentu LLM, więc rozważanie początkowego wyboru w nieskończoność się nie opłaca — startuj z rozsądnym domyślnym modelem, mierz jakość na realnym ruchu w Slacku i iteruj.

Każda sekcja poniżej jest samodzielna. Wybierz tę, która odpowiada rodzinie modelu, który podłączasz, i postępuj zgodnie z jej wskazówkami.

Claude to rodzina LLM od Anthropic, dobrze sprawdzająca się dla Slackbotów obsługujących niuansowe wewnętrzne Q&A, podsumowywanie dokumentów, code review i ostrożne podążanie za instrukcjami. Aby podłączyć Claude do Slacka, w kroku 4 upuść komponent LLM Anthropic i wybierz wariant:

Dla Slackbotów nad wewnętrzną wiedzą w Notion lub Confluence Claude 3.5 Sonnet plus Document Retriever to najpewniejszy punkt wyjścia.

GPT i o-series od OpenAI to najszerszy wybór dla Slacka — silna ogólna wydajność, najdojrzalsze wywoływanie narzędzi i wejście multimodalne (wizja, audio). W kroku 4 upuść komponent LLM OpenAI i wybierz wariant:

Dla większości zespołów zacznij od GPT-4o Mini. Awansuj do GPT-4o lub o1 tylko w przypadku flow, w których użytkownicy narzekają na jakość odpowiedzi.

Google Gemini to najsilniejszy wybór, gdy liczy się okno kontekstowe — Gemini 1.5 Pro obsługuje ponad 1M tokenów, co wystarcza, by wrzucić całe bazy kodu lub zestawy dokumentów do jednego zapytania w Slacku. W kroku 4 upuść komponent LLM Google i wybierz wariant:

Jeśli Slackbot musi rozumować nad pełną bazą wiedzy w jednym przebiegu (bez kroku retrievalu), okno kontekstowe Gemini Pro to najczystsza odpowiedź.

xAI Grok podłącza się do Slack flow FlowHunt tak samo jak inne modele — upuść komponent LLM xAI (lub użyj komponentu LLM OpenAI wskazującego na endpoint Grok, w zależności od wersji FlowHunt) i wybierz wariant Grok. Cechą wyróżniającą Groka jest świadomość w czasie rzeczywistym — ma dostęp do aktualnych informacji, w tym danych z X (Twitter), co czyni go najlepszym wyborem, gdy Slackbot potrzebuje kontekstu bieżących wydarzeń: wiadomości, danych rynkowych, najnowszych zmian. Sparuj go z Google Search Tool dla jeszcze szerszego dostępu do sieci.

Rodzina Llama od Meta to opcja z otwartymi wagami — używaj jej, gdy rezydencja danych, self-hosting lub koszt za token wykluczają hostowane API. W kroku 4 upuść komponent LLM Meta i wybierz wariant:

Llama to właściwa odpowiedź, gdy zespół ds. bezpieczeństwa lub zgodności wymaga, aby model działał na infrastrukturze, którą kontrolujesz, lub gdy duży wolumen wiadomości czyni koszty hostowanego API zaporowymi.

Mistral to europejski rywal z otwartymi wagami — silne modele, hosting przyjazny UE i dobry stosunek ceny do jakości. W kroku 4 upuść komponent LLM Mistral i wybierz wariant:

Wybierz Mistral, gdy liczy się rezydencja danych w UE lub gdy chcesz elastyczności otwartych wag z jakością bliższą czołówce niż Llama 3.x w niektórych benchmarkach.

Trzy wzorce flow pokrywają większość wdrożeń w Slacku. Zbuduj którykolwiek z nich na bazie konfiguracji powyżej, dostosowując narzędzia i prompt AI Agenta:

Te wzorce ładnie się nawarstwiają: jeden flow Slacka może łączyć retrieval z bazy wiedzy, aktualne wyszukiwanie w sieci i wewnętrzne wywołania API, a LLM wybiera odpowiednie narzędzie do każdego zapytania.

Bot nie odpowiada na wiadomości. Sprawdź, czy ustawienie „Only Trigger on Mention" pasuje do tego, jak testujesz — jeśli jest włączone, musisz @-wspomnieć bota. Upewnij się, że kanał w Slack Message Received zgadza się z kanałem, w którym piszesz.

Bot odpowiada, ale odpowiedź jest słaba. Najpierw iteruj na backstory i goal AI Agenta — mają większy wpływ niż wymiana modelu. Jeśli jakość po iteracji promptu nadal kuleje, awansuj komponent LLM na mocniejszy model (Mini → standard → najwyższa półka).

Błędy uprawnień po autoryzacji Slacka. Połącz ponownie integrację Slacka w zakładce Integrations FlowHunt i ponownie nadaj uprawnienia. Slack od czasu do czasu unieważnia tokeny po zmianie właściciela workspace.

Długie odpowiedzi są obcinane w Slacku. Slack ma limit znaków na wiadomość. Dodaj do flow krok post-processingu, który dzieli długie odpowiedzi, lub w celu AI Agenta poinstruuj go, by trzymał odpowiedzi do Slacka poniżej 3 000 znaków.

Cała konfiguracja — podłączenie Slacka, zbudowanie flow, wybór modelu — to we FlowHunt projekt na jeden wieczór. Flow, który zbudujesz dziś, zadziała z dowolnym przyszłym modelem: gdy pojawi się GPT-6 lub Claude 5, wymieniasz komponent LLM, a reszta flow działa dalej.

Zacznij od darmowego planu FlowHunt , podłącz Slacka i uruchom działającego AI Slackbota przed lunchem.

Arshia jest Inżynierką Przepływów Pracy AI w FlowHunt. Z wykształceniem informatycznym i pasją do sztucznej inteligencji, specjalizuje się w tworzeniu wydajnych przepływów pracy, które integrują narzędzia AI z codziennymi zadaniami, zwiększając produktywność i kreatywność.

No-code flow builder od FlowHunt łączy Slacka z każdym głównym LLM — Claude, GPT, Gemini, Grok, Llama, Mistral — za pomocą jednego spójnego flow. Bez kodu, bez zarządzania infrastrukturą.

Integracja FlowHunt ze Slackiem umożliwia płynną współpracę AI bezpośrednio w Twoim środowisku Slack. Przenieś dowolny Flow do Slacka, automatyzuj procesy, zape...

FlowHunt 2.6.12 wprowadza integrację ze Slackiem, klasyfikację intencji oraz model Gemini, usprawniając funkcjonalność czatbotów AI, wgląd w potrzeby klientów i...

Zintegruj FlowHunt ze Slackiem, aby automatyzować wysyłanie wiadomości, uruchamiać przepływy pracy i utrzymywać swój zespół na bieżąco dzięki przepływom opartym...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.