Tích hợp Slack

Tích hợp Slack của FlowHunt cho phép cộng tác AI liền mạch ngay trong không gian làm việc Slack của bạn. Đưa bất kỳ Flow nào vào Slack, tự động hóa quy trình là...

Kết nối bất kỳ LLM nào (Claude, GPT, Gemini, Grok, Llama, Mistral) với Slack bằng trình tạo flow no-code của FlowHunt. Cách thiết lập giống nhau cho mọi mô hình — chọn mô hình phù hợp với nhu cầu của bạn rồi triển khai trong vài phút.

Trước đây, để thêm trợ lý AI vào Slack thường phải chọn một nhà cung cấp, viết code tích hợp, rồi xây lại tất cả khi sáu tháng sau có một mô hình tốt hơn ra mắt. Với FlowHunt, phần tích hợp được tách rời khỏi mô hình: bạn chỉ xây flow Slack một lần, cắm LLM bạn muốn — Claude, GPT, Gemini, Grok, Llama, Mistral — và đổi bất cứ lúc nào mà không cần đụng vào phần còn lại.

Hướng dẫn này đi qua toàn bộ quá trình thiết lập. Nửa đầu giống nhau cho mọi mô hình. Nửa sau phân tích nên chọn mô hình nào cho từng trường hợp sử dụng, kèm các lưu ý riêng cho từng dòng LLM. Hãy nhảy đến phần phù hợp với stack của bạn, hoặc đọc từ đầu đến cuối nếu mới bắt đầu từ con số không.

Slack là nơi các nhóm đặt câu hỏi. Một AI Agent sống ở đó sẽ trả lời ngay lập tức — không cần chuyển ngữ cảnh sang công cụ chat khác, dashboard hay knowledge base. Các kịch bản triển khai phổ biến:

Bot nằm ngay trong Slack, vì vậy việc tiếp nhận diễn ra tự nhiên — không ai phải học một công cụ mới.

Cách thiết lập giống nhau bất kể bạn chọn mô hình AI nào. Chọn mô hình ở bước 4; mọi thứ khác giữ nguyên.

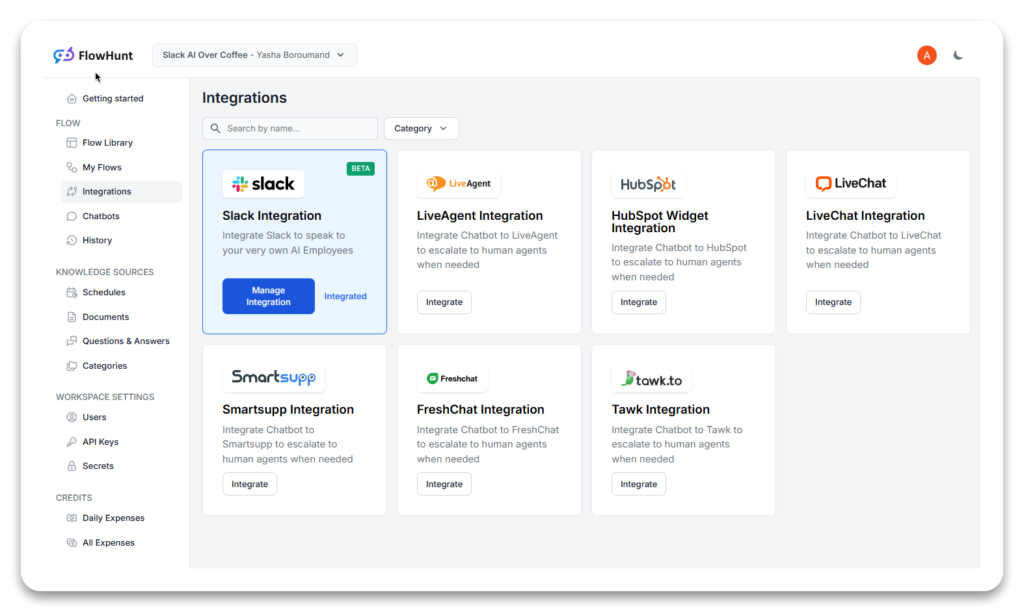

Đăng nhập vào tài khoản FlowHunt của bạn và mở tab Integrations. Chọn Slack, nhấn Connect, và cấp quyền cho ứng dụng trên màn hình OAuth của Slack. Cấp các quyền đọc/ghi mà FlowHunt yêu cầu — chúng cho phép bot nhận tin nhắn và gửi trả lời trong workspace của bạn.

URL workspace của bạn xuất hiện ở góc trên bên trái của Slack desktop hoặc web app — sao chép từ đó nếu FlowHunt yêu cầu. Sau khi cấp quyền, Slack đã được kết nối và sẵn sàng dùng trong mọi flow.

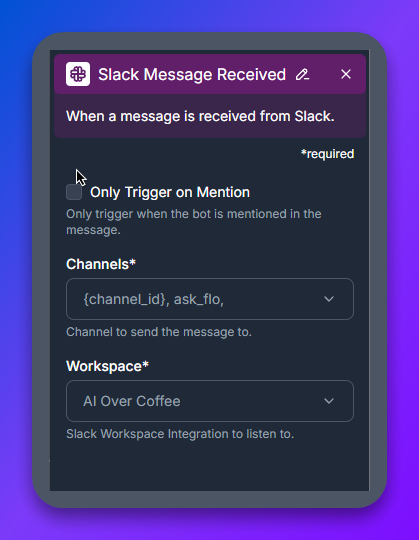

Trong trình tạo flow của FlowHunt, kéo component Slack Message Received lên canvas. Block này lắng nghe các tin nhắn Slack đến và kích hoạt phần còn lại của flow.

Cấu hình hai cài đặt:

#ai-assistant riêng là cấu hình gọn gàng nhất.

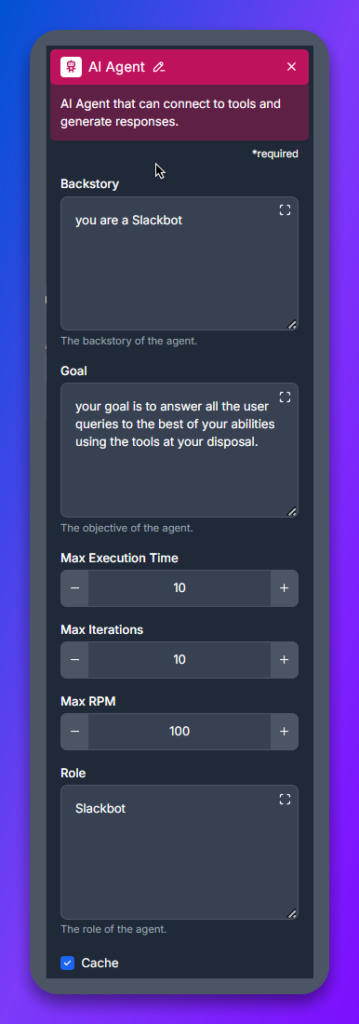

Block AI Agent là tầng suy luận của bot. Nó nhận tin nhắn của người dùng, quyết định dùng công cụ nào và soạn ra câu trả lời.

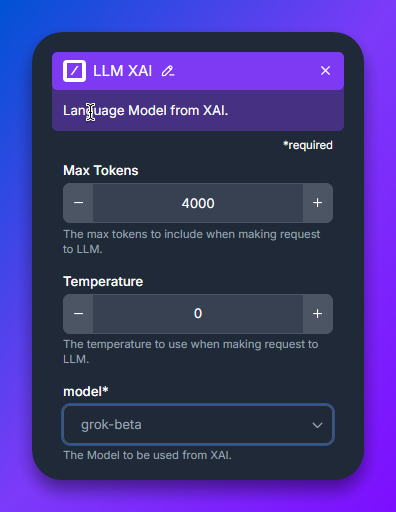

Kết nối một component LLM vào AI Agent. Đây là nơi bạn chọn mô hình AI cấp năng lượng cho bot. FlowHunt có component LLM riêng cho từng nhà cung cấp — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — và bên trong mỗi component bạn chọn biến thể mô hình cụ thể.

Đây là bước duy nhất khác nhau giữa các mô hình. Hãy nhảy đến mục Chọn mô hình AI phù hợp bên dưới để xem so sánh và lưu ý theo từng dòng.

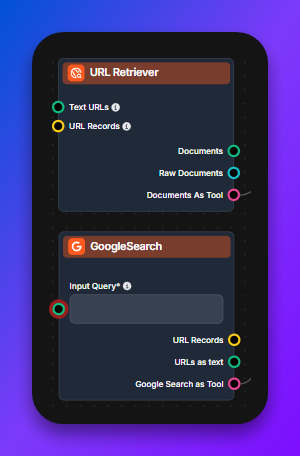

AI Agent trở nên hữu ích hơn rất nhiều khi có thể dùng công cụ. Một số phổ biến:

Công cụ không phụ thuộc mô hình. Bất kỳ LLM nào bạn chọn ở bước 4 đều có thể sử dụng bất kỳ công cụ nào bạn nối vào.

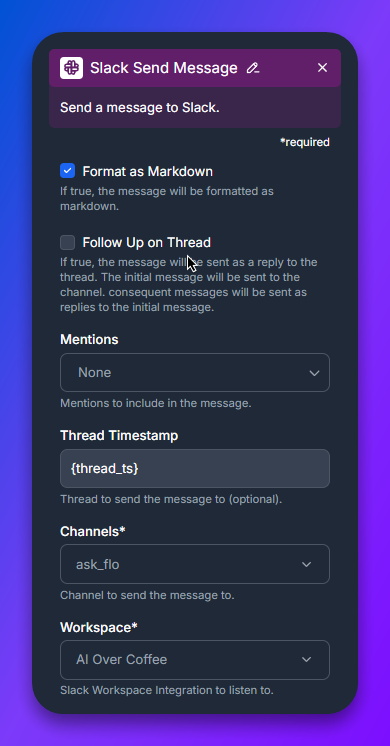

Hoàn thiện flow bằng component Slack Send Message, cấu hình cho cùng kênh và workspace như bước 2. Lưu flow, mở Slack và @ bot trong kênh thử nghiệm. Bot sẽ phản hồi bằng mô hình bạn đã chọn ở bước 4.

Đó là toàn bộ quá trình thiết lập. Đổi mô hình về sau chỉ là thay đổi một-cú-nhấp ở bước 4 — không sửa code, không xây lại flow.

Mọi dòng LLM lớn đều hoạt động trong flow Slack của FlowHunt. Sự khác biệt nằm ở chi phí, độ trễ, cửa sổ ngữ cảnh, độ sâu suy luận và chất lượng gọi công cụ. Dùng bảng dưới để rút ngắn danh sách, sau đó đọc phần riêng cho từng dòng để biết lưu ý cấu hình.

| Dòng mô hình | Phù hợp cho | Độ trễ | Chi phí | Ghi chú |

|---|---|---|---|---|

| Claude (Anthropic) | Phân tích ngữ cảnh dài, suy luận cẩn thận, code review | Trung bình | Trung bình–Cao | Bám sát chỉ thị tinh tế; xuất sắc cho hỏi đáp nội bộ trên tài liệu |

| GPT / dòng o (OpenAI) | Đa năng, hệ sinh thái công cụ rộng, đa phương thức | Thấp–Trung bình | Thấp (mini) – Cao (dòng o) | GPT-4o Mini là điểm ngọt mặc định; o1/o3 cho suy luận khó |

| Gemini (Google) | Cửa sổ ngữ cảnh khổng lồ, đa phương thức nhanh, có grounding tìm kiếm | Thấp | Thấp–Trung bình | 1.5 Pro xử lý 1M+ tokens; tuyệt vời cho hỏi đáp toàn bộ tài liệu trên Slack |

| Grok (xAI) | Truy vấn thời gian thực/biết tin tức, dữ liệu X (Twitter), giọng văn thoải mái | Thấp | Trung bình | Tốt nhất khi bot cần hiểu các sự kiện hiện tại |

| Llama (Meta) | Triển khai tự host/riêng tư, workload nhạy cảm chi phí | Tùy host | Thấp (tự host) | Trọng số mở — dùng khi quan trọng về nơi lưu trữ dữ liệu |

| Mistral | Trọng số mở, cân bằng chi phí/chất lượng, hosting thân thiện EU | Thấp | Thấp–Trung bình | Mistral Large cạnh tranh với GPT-4o ở chi phí thấp hơn |

Hãy chọn một để bắt đầu. Đổi mô hình trong FlowHunt chỉ là một-cú-nhấp ở component LLM, vì vậy đừng tốn quá nhiều công suy nghĩ cho lựa chọn ban đầu — triển khai với một mặc định hợp lý, đo chất lượng trên lưu lượng Slack thật, rồi cải tiến.

Mỗi mục bên dưới đều độc lập. Chọn mục cho dòng mô hình bạn đang kết nối và làm theo lưu ý.

Claude là dòng LLM của Anthropic, rất phù hợp với các Slackbot xử lý hỏi đáp nội bộ tinh tế, tóm tắt tài liệu, code review và bám sát chỉ thị cẩn thận. Để kết nối Claude với Slack, ở bước 4 hãy kéo component LLM Anthropic và chọn biến thể:

Với Slackbot tri thức nội bộ trên Notion hoặc Confluence, Claude 3.5 Sonnet kết hợp Document Retriever là điểm khởi đầu đáng tin cậy nhất.

Các mô hình GPT và dòng o của OpenAI là lựa chọn rộng nhất cho Slack — hiệu năng đa năng mạnh, gọi công cụ trưởng thành nhất và đầu vào đa phương thức (vision, audio). Ở bước 4 hãy kéo component LLM OpenAI và chọn biến thể:

Với hầu hết các nhóm, hãy bắt đầu với GPT-4o Mini. Chỉ nâng cấp lên GPT-4o hoặc o1 ở những flow mà người dùng phàn nàn về chất lượng câu trả lời.

Google Gemini là lựa chọn mạnh nhất khi cửa sổ ngữ cảnh quan trọng — Gemini 1.5 Pro xử lý hơn 1M tokens, đủ để đưa toàn bộ codebase hoặc bộ tài liệu vào một truy vấn Slack duy nhất. Ở bước 4 hãy kéo component LLM Google và chọn biến thể:

Nếu Slackbot của bạn cần suy luận trên toàn bộ kho tri thức trong một lượt (không cần bước retrieval), cửa sổ ngữ cảnh của Gemini Pro là câu trả lời gọn gàng nhất.

xAI Grok được tích hợp vào flow Slack của FlowHunt theo cùng cách như các mô hình khác — kéo component LLM xAI (hoặc dùng component LLM OpenAI trỏ vào endpoint Grok, tùy phiên bản FlowHunt của bạn) và chọn biến thể Grok. Đặc điểm nổi bật của Grok là khả năng nhận biết thời gian thực — nó truy cập được thông tin trực tiếp, bao gồm dữ liệu X (Twitter), khiến nó là lựa chọn tốt nhất khi Slackbot cần ngữ cảnh sự kiện hiện tại: tin tức, dữ liệu thị trường, các diễn biến mới. Kết hợp với Google Search Tool để có truy cập web rộng hơn.

Dòng Llama của Meta là lựa chọn trọng số mở — dùng khi việc lưu trữ dữ liệu, tự host hoặc chi phí mỗi token loại trừ các API được host. Ở bước 4 hãy kéo component LLM Meta và chọn biến thể:

Llama là câu trả lời đúng khi đội bảo mật hoặc tuân thủ yêu cầu mô hình phải chạy trên hạ tầng bạn kiểm soát, hoặc khi khối lượng tin nhắn lớn khiến chi phí API host trở nên không khả thi.

Mistral là đối thủ trọng số mở của châu Âu — mô hình mạnh, hosting thân thiện EU và giá/hiệu năng tốt. Ở bước 4 hãy kéo component LLM Mistral và chọn biến thể:

Chọn Mistral khi việc lưu trữ dữ liệu trong EU quan trọng, hoặc khi bạn muốn sự linh hoạt của trọng số mở với chất lượng gần biên giới hơn Llama 3.x ở một số benchmark.

Ba kiểu flow bao quát phần lớn các triển khai Slack. Xây bất kỳ kiểu nào trên nền cấu hình ở trên bằng cách điều chỉnh công cụ và prompt của AI Agent:

Các mô hình này có thể xếp chồng gọn gàng: một flow Slack duy nhất có thể kết hợp tìm kiếm trong kho tri thức, tìm kiếm web trực tiếp và gọi API nội bộ, để LLM chọn công cụ phù hợp cho mỗi truy vấn.

Bot không phản hồi tin nhắn. Kiểm tra ‘Only Trigger on Mention’ có khớp với cách bạn đang thử không — nếu bật, bạn phải @ bot. Xác nhận kênh trong Slack Message Received khớp với kênh bạn đang đăng tin.

Bot phản hồi nhưng câu trả lời kém. Hãy lặp lại trên backstory và goal của AI Agent trước — chúng có ảnh hưởng lớn hơn việc đổi mô hình. Nếu chất lượng vẫn chưa đạt sau khi cải tiến prompt, hãy nâng cấp lên mô hình mạnh hơn trong component LLM (Mini → tiêu chuẩn → top đầu).

Lỗi quyền sau khi xác thực Slack. Kết nối lại tích hợp Slack trong tab Integrations của FlowHunt và cấp lại quyền. Slack đôi khi vô hiệu hóa token sau khi chủ workspace thay đổi.

Câu trả lời dài bị cắt trong Slack. Slack có giới hạn ký tự cho mỗi tin nhắn. Thêm bước hậu xử lý trong flow để chia nhỏ phản hồi dài, hoặc chỉ thị cho AI Agent trong goal giữ phản hồi dưới 3.000 ký tự khi đăng vào Slack.

Toàn bộ quá trình thiết lập — kết nối Slack, xây flow, chọn mô hình — là dự án một buổi tối trong FlowHunt. Flow bạn xây hôm nay sẽ chạy được với mọi mô hình tương lai: khi GPT-6 hoặc Claude 5 ra mắt, bạn chỉ cần đổi component LLM và phần còn lại của flow vẫn tiếp tục chạy.

Bắt đầu với gói miễn phí của FlowHunt , kết nối Slack, và triển khai một AI Slackbot hoạt động trước bữa trưa.

Arshia là Kỹ sư Quy trình AI tại FlowHunt. Với nền tảng về khoa học máy tính và niềm đam mê AI, anh chuyên tạo ra các quy trình hiệu quả tích hợp công cụ AI vào các nhiệm vụ hàng ngày, nâng cao năng suất và sự sáng tạo.

Trình tạo flow no-code của FlowHunt kết nối Slack với mọi LLM hàng đầu — Claude, GPT, Gemini, Grok, Llama, Mistral — qua một flow nhất quán. Không cần code, không cần quản lý hạ tầng.

Tích hợp Slack của FlowHunt cho phép cộng tác AI liền mạch ngay trong không gian làm việc Slack của bạn. Đưa bất kỳ Flow nào vào Slack, tự động hóa quy trình là...

FlowHunt 2.6.12 giới thiệu tích hợp Slack, phân loại ý định và mô hình Gemini, nâng cao chức năng chatbot AI, hiểu biết khách hàng và quy trình làm việc nhóm....

Tích hợp FlowHunt với Slack để tự động hóa nhắn tin, kích hoạt luồng công việc và giúp nhóm của bạn luôn được cập nhật với các luồng AI....

Đồng Ý Cookie

Chúng tôi sử dụng cookie để cải thiện trải nghiệm duyệt web của bạn và phân tích lưu lượng truy cập của mình. See our privacy policy.