AI-agenter

Lär dig hur du bygger, konfigurerar och orkestrerar AI-agenter i FlowHunt. Från enkla agenter till djupa agenter och fullständiga team, hitta alla guider du beh...

Lär dig hur du bygger pålitliga AI-agenter med rätt arkitektur, verktygsintegration och felförebyggande. Jämför ramverk, mönster och verkliga exempel.

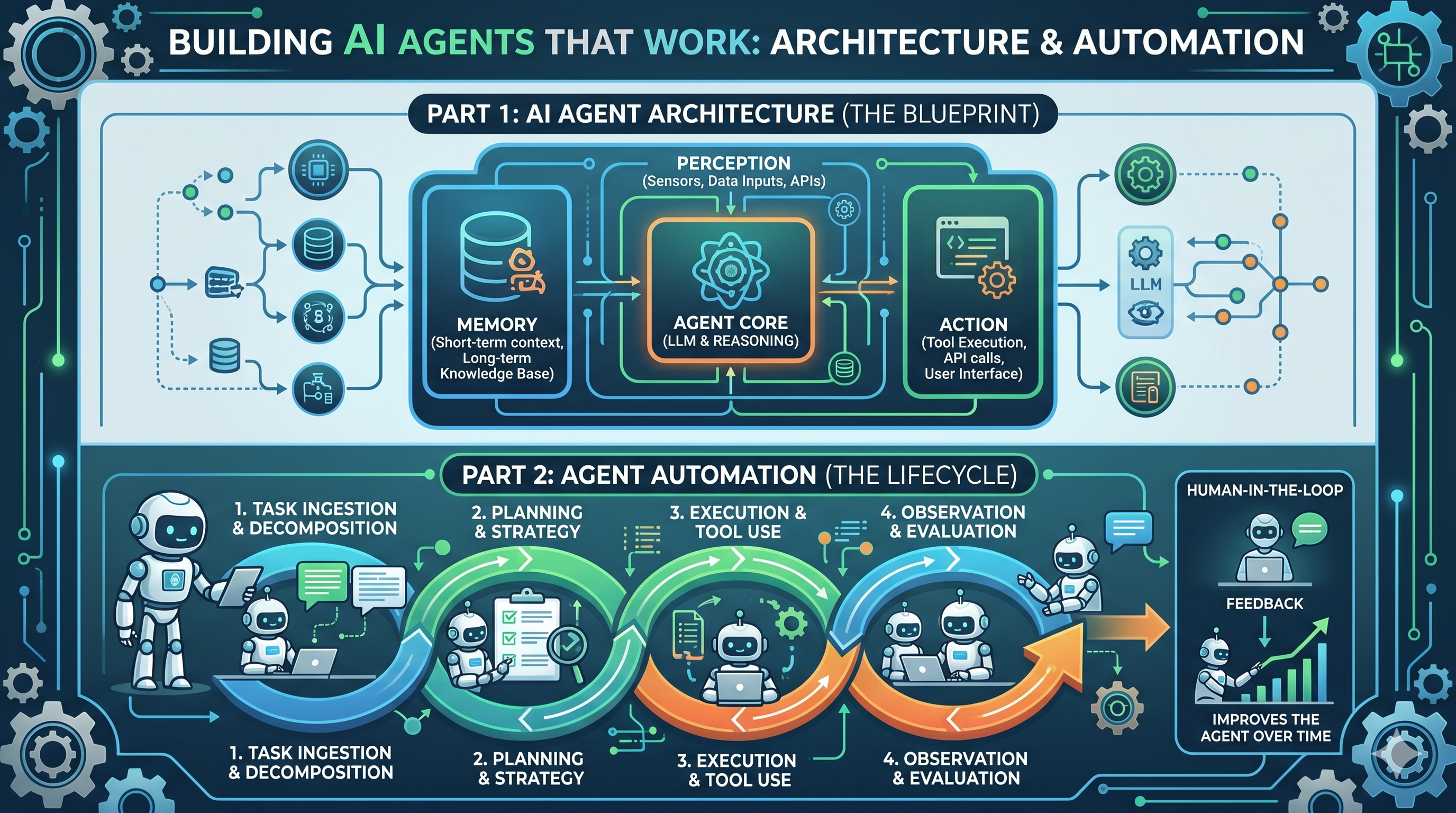

AI-agenter är fundamentalt annorlunda än chatbots. En chatbot väntar på användarinput och svarar. En agent arbetar mot mål autonomt, anropar verktyg, resonerar om problem och utför åtgärder utan mänsklig inblandning i varje steg.

Denna skillnad är viktig eftersom agenter kan automatisera hela arbetsflöden. En agent för leadskvalificering poängsätter prospekter, berikar deras data och tilldelar dem till säljare – allt utan mänsklig inblandning. En agent för innehållstriagering kategoriserar supportärenden, dirigerar dem till specialister och eskalerar gränsfall till människor.

I den här guiden lär du dig hur du arkitekturerar pålitliga agenter, integrerar dem med affärssystem, förhindrar vanliga fel och mäter deras påverkan. Vi går igenom verkliga mönster som används i produktion på företag som automatiserar leadskvalificering, dokumenthantering och kundsupport i stor skala.

En AI-agent är ett mjukvarusystem som:

Agenter är måldrivna. Du definierar målet (“Poängsätt och kvalificera denna lead”) och agenten listar ut hur det ska uppnås.

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

Användaren driver varje interaktion. Chatboten är tillståndslös – varje meddelande är oberoende.

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

Agenten arbetar mot ett definierat mål och fattar flera beslut och gör verktygsanrop autonomt.

Manuell leadskvalificering: 5 minuter per lead × 100 leads = 500 timmar/månad. Kostnad: 10 000 USD/månad (vid 20 USD/timme).

Agentdriven: 10 sekunder per lead × 100 leads = 16 timmar/månad. Kostnad: 100 USD (agentens API-anrop). Besparing: 99 %.

Agenter multiplicerar ditt teams kapacitet utan att anställa.

Komplexa uppgifter kräver flera steg:

Agenter hanterar detta resonemang automatiskt. Du definierar målet; agenten bryter ned det i steg.

Agenter är “händer”. De anropar API:er för att:

En enskild agent kan orkestrera 5–10 verktygsanrop för att slutföra ett arbetsflöde.

Agenter kan förbättras över tid. Om en agent klassificerar dokument felaktigt ger du feedback. Agenten lär sig och justerar sin promptstrategi.

Kärnan i varje agent är en slinga:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

Agenten läser:

LLM tar emot en prompt som:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

LLM svarar: “Jag bör berika leaden först för att få intäktsdata, sedan poängsätta, sedan tilldela.”

Agenten utför det valda verktyget:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Agenten kontrollerar: Lyckades verktygsanropet? Förde det framåt mot målet? Uppdatera minnet och fortsätt slingan.

Agenten upprepar observation → resonemang → åtgärd → feedback tills:

Verktyg är funktioner som agenten kan anropa. Definiera dem tydligt:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Tydliga beskrivningar hjälper LLM att välja rätt verktyg.

LLM svarar med ett verktygsanrop:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Ditt agentramverk utför verktyget och skickar tillbaka resultatet till LLM.

Hantera både framgång och misslyckande:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Om ett verktyg misslyckas bör agenten prova ett annat tillvägagångssätt eller eskalera till en människa.

Agentens arbetsminne: aktuell input, verktygsresultat, resoneringssteg. Lagras vanligtvis i kontextfönstret (prompten).

Exempel: Agent för leadskvalificering kommer ihåg:

Beständigt minne: tidigare beslut, inlärda mönster, kunskapsbas.

Användningsfall:

Implementera med vektordatabaser (Pinecone, Weaviate) för semantisk sökning.

LLM:er har begränsade kontextfönster (4K–128K tokens). Agenter kan inte komma ihåg allt. Strategier:

För de flesta agenter är Claude eller öppen källkodsmodeller tillräckliga och billigare.

Exempel på reflexion-prompt:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

Välj hastighet för realtid (kundsupport). Välj noggrannhet för högriskfall (finansiella beslut).

Reaktiva agenter fattar ett enda beslut och agerar. Ingen flerstegs-planering.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latens: 1–3 sekunder. Kostnad: 0,001–0,01 USD per fråga.

Planeringsagenter bryter ned komplexa mål i steg.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latens: 5–15 sekunder. Kostnad: 0,02–0,05 USD per lead.

Inlärande agenter blir bättre med feedback.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Över tid förbättras rekommendationer när agenten lär sig användarpreferenser.

En övervakaragent koordinerar specialistagenter.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Varje specialistagent är optimerad för sin uppgift. Övervakaren orkestrerar.

Hur sofistikerat agentens tänkande är. Enkla agenter använder chain-of-thought. Komplexa agenter använder planering och reflexion.

Kan du enkelt koppla API:er, databaser, CRM-system? Eller behöver du anpassad kod?

Hur snabbt kan en utvecklare få en fungerande agent? Kodfria plattformar är snabbare; Python-ramverk är mer flexibla.

Vissa ramverk är öppen källkod (gratis). Andra tar betalt per API-anrop eller prenumeration.

Vad är varje verktyg optimerat för?

| Verktyg | Ramverkstyp | Resoneringskapacitet | Verktygsintegration | Inlärningskurva | Pris | Bäst för |

|---|---|---|---|---|---|---|

| n8n | Visuell arbetsflödesbyggare | Chain-of-thought | 500+ integrationer | Låg | Gratis + betald | Icke-tekniska användare, snabb installation |

| CrewAI | Python-ramverk | Planering + reflexion | Anpassade verktyg (Python) | Medel | Öppen källkod | Utvecklare, komplexa agenter |

| Autogen | Python-ramverk | Multi-agent-resonemang | Anpassade verktyg | Hög | Öppen källkod | Forskning, multi-agent-system |

| LangGraph | Python-ramverk | Planering + tillståndshantering | LangChain-ekosystem | Medel | Öppen källkod | Komplexa arbetsflöden, tillståndsspårning |

| FlowHunt | Nativ plattform | Chain-of-thought + planering | Nativa + API-integrationer | Låg | Prenumeration | Arbetsflödesautomatisering, användarvänlighet |

| Lindy.ai | Kodfri plattform | Chain-of-thought | 100+ integrationer | Mycket låg | Freemium | Icke-tekniska, snabba agenter |

| Gumloop | Kodfri plattform | Chain-of-thought | 50+ integrationer | Mycket låg | Freemium | Enkel automatisering, mallar |

Viktiga skillnader:

Var specifik. Dåligt: “Automatisera leadshantering.” Bra: “Poängsätt leads 0–100, berika med företagsdata, tilldela till säljare baserat på kapacitet.”

Avvägningar:

Indata: leaddata, dokumenttext, kundfråga, kontext från minnet.

Lista API:er, databaser, tjänster som agenten kommer att anropa.

Exempel för leadskvalificering:

Definiera framgångsvillkor. “Stanna när lead är poängsatt och tilldelad.”

Definiera även max antal steg för att undvika oändliga slingor. “Stanna efter 10 steg, oavsett.”

CrewAI-exempel:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

De flesta agenter anropar REST-API:er. Använd en standard HTTP-klient:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Utlös agenter vid händelser (ny lead, inkommande e-post, formulärinlämning):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Agenten läser kunddata, tidigare interaktioner, kunskapsbas:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Agent skriver beslut till databasen:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Använd transaktioner för flerstegsoperationer:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Använd officiella SDK:er:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Använd OAuth-scopes för att begränsa vad agenter kan göra:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Högriskbeslut: finansiella transaktioner, kundåterbetalningar, policyundantag.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Använd RAG för att förankra agenten i fakta:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementera cachning:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

En agent som gör 5 sekventiella API-anrop med 1 sekund vardera = 5+ sekunders latens.

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Använd snabbare modeller:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Jämför agentens utdata med ground truth (mänsklig granskning, faktiska resultat).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Mät end-to-end-tid från input till output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Fråga användare: “Hur nöjd är du med agentens beslut?”

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Övervaka ROI. Om en agent inte levererar värde, avveckla den. Skala upp framgångsrika agenter till andra team.

FAQ-sektionen återges automatiskt från frontmatter och visas nedan.

{{ cta-dark-panel heading=“Bygg agenter utan komplexiteten” description=“FlowHunts nativa agentplattform hanterar verktygsintegration, felhantering och övervakning. Börja bygga autonoma arbetsflöden på minuter, inte veckor.” ctaPrimaryText=“Prova FlowHunt gratis” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Boka en demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}

Arshia är en AI-arbetsflödesingenjör på FlowHunt. Med en bakgrund inom datavetenskap och en passion för AI, specialiserar han sig på att skapa effektiva arbetsflöden som integrerar AI-verktyg i vardagliga uppgifter, vilket förbättrar produktivitet och kreativitet.

FlowHunts nativa agentplattform hanterar verktygsintegration, felhantering och övervakning. Börja bygga autonoma arbetsflöden på minuter.

Lär dig hur du bygger, konfigurerar och orkestrerar AI-agenter i FlowHunt. Från enkla agenter till djupa agenter och fullständiga team, hitta alla guider du beh...

Lär dig hur du skapar en medicinsk chatbot med AI genom att använda FlowHunts PubMed-verktyg. Denna omfattande guide täcker hur du sätter upp ett forskningsflöd...

Upptäck hur en kundtjänstchatbot kan förbättra din supportverksamhet med snabba, korrekta svar, tillgänglighet dygnet runt och smidig plattformsintegration. Lär...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.