تكامل Slack

يتيح تكامل FlowHunt مع Slack التعاون السلس مع الذكاء الاصطناعي مباشرة داخل مساحة عمل Slack الخاصة بك. يمكنك إضافة أي Flow إلى Slack، وأتمتة سير العمل، وتقديم ال...

اربط أي نموذج LLM (Claude وGPT وGemini وGrok وLlama وMistral) بـ Slack باستخدام منشئ سير العمل بدون كود من FlowHunt. الإعداد هو نفسه لكل نموذج — اختر النموذج الذي يناسب حالة استخدامك ثم انشره في دقائق.

كانت إضافة مساعد ذكاء اصطناعي إلى Slack تعني سابقًا اختيار مزوّد، وكتابة كود التكامل، وإعادة بناء كل شيء عند ظهور نموذج أفضل بعد ستة أشهر. مع FlowHunt، يكون التكامل منفصلاً عن النموذج: تبني سير عمل Slack مرة واحدة، وتوصل LLM الذي تريده — Claude أو GPT أو Gemini أو Grok أو Llama أو Mistral — وتستبدله في أي وقت دون لمس البقية.

يتناول هذا الدليل الإعداد بالكامل. النصف الأول هو نفسه لكل نموذج. ويشرح النصف الثاني أي نموذج تختار لأي حالة استخدام، مع ملاحظات خاصة بكل عائلة LLM. انتقل إلى القسم الذي يطابق منظومتك التقنية، أو اقرأ من البداية إلى النهاية إذا كنت تبدأ من الصفر.

Slack هو المكان الذي يسأل فيه الفريق الأسئلة. ووكيل الذكاء الاصطناعي الذي يعيش هناك يجيب عليها فورًا — دون التبديل إلى أداة دردشة منفصلة أو لوحة تحكم أو قاعدة معرفة. عمليات النشر الشائعة:

يعيش الروبوت في Slack، لذا فإن الاعتماد عليه تلقائي — لا يحتاج أحد إلى تعلم أداة جديدة.

الإعداد متطابق بغض النظر عن نموذج الذكاء الاصطناعي الذي تختاره. اختر نموذجك في الخطوة 4؛ كل شيء آخر يبقى كما هو.

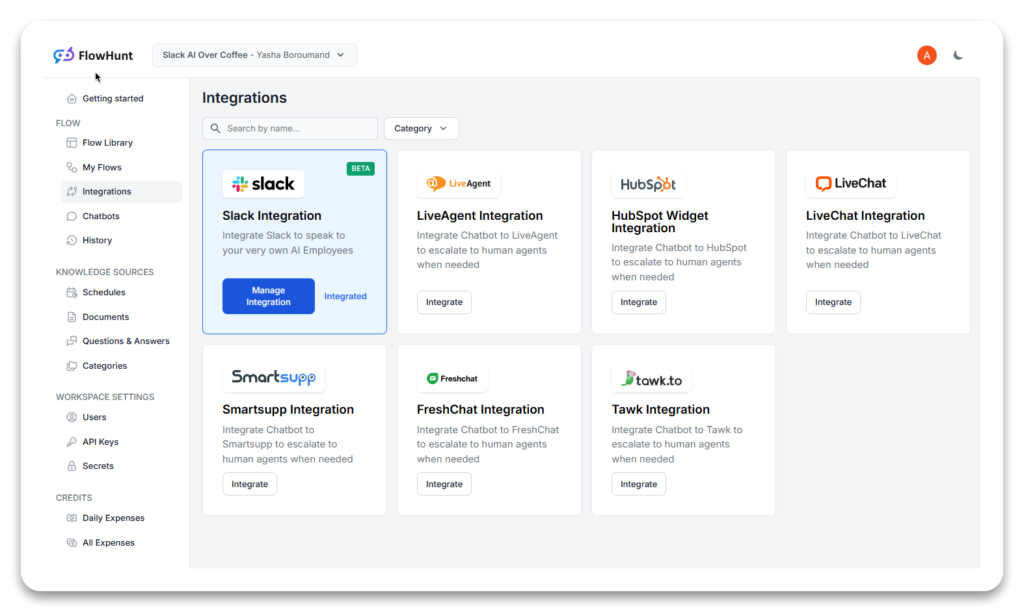

سجّل الدخول إلى حساب FlowHunt الخاص بك وافتح علامة التبويب التكاملات. اختر Slack، وانقر على اتصال، وامنح التطبيق الإذن في شاشة OAuth الخاصة بـ Slack. امنح أذونات القراءة/الكتابة التي يطلبها FlowHunt — فهي تتيح للروبوت استقبال الرسائل ونشر الردود في مساحة العمل الخاصة بك.

يظهر رابط مساحة العمل الخاصة بك في الزاوية العلوية اليسرى من تطبيق Slack لسطح المكتب أو الويب — انسخه من هناك إذا طلب FlowHunt ذلك. بمجرد منح الإذن، يصبح Slack متصلاً وجاهزًا للاستخدام في أي سير عمل.

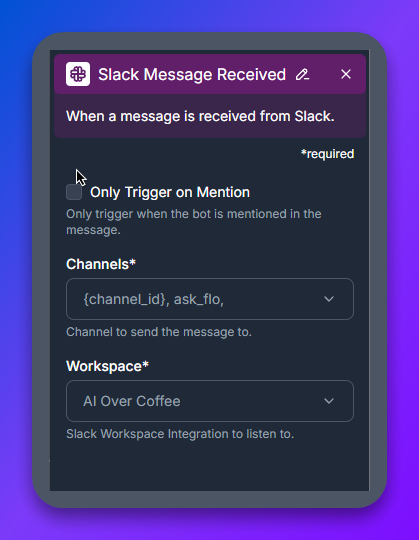

في منشئ سير العمل في FlowHunt، أسقط مكوّن استقبال رسالة Slack على لوحة الرسم. تستمع هذه الكتلة لرسائل Slack الواردة وتشغّل بقية سير العمل.

اضبط إعدادين:

#ai-assistant المخصصة هي الإعداد الأنظف.

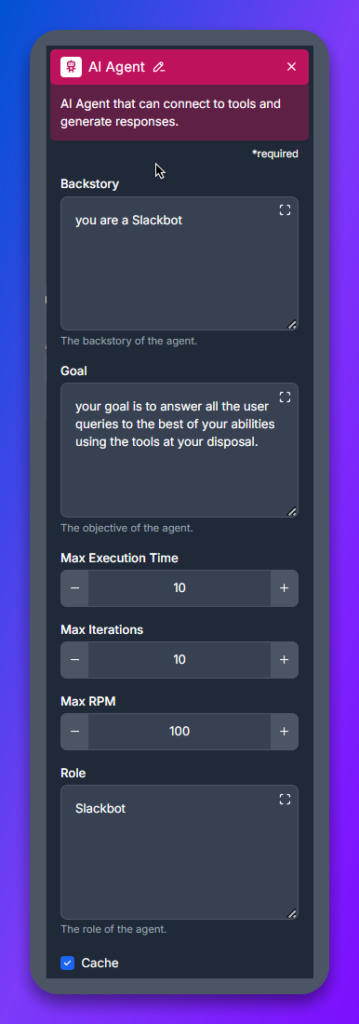

كتلة AI Agent هي طبقة الاستدلال للروبوت. تأخذ رسالة المستخدم، وتقرر الأدوات التي ستستخدمها، وتصوغ الرد.

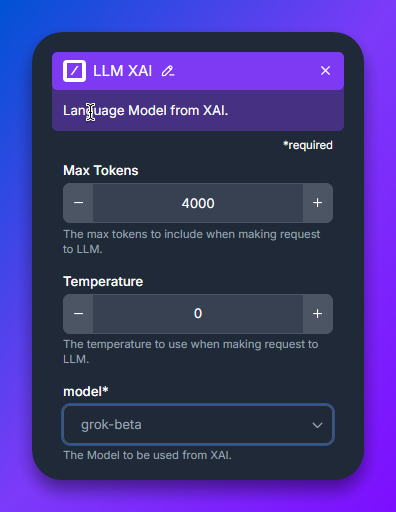

اربط مكوّن LLM بـ AI Agent. هنا تختار نموذج الذكاء الاصطناعي الذي يشغّل الروبوت. لدى FlowHunt مكوّن LLM منفصل لكل مزوّد — LLM OpenAI، وLLM Anthropic، وLLM Google، وLLM Meta، وLLM Mistral، وLLM xAI — وداخل كل واحد، تختار نسخة النموذج المحددة.

هذه هي الخطوة الوحيدة التي تختلف لكل نموذج. انتقل إلى قسم اختر نموذج الذكاء الاصطناعي المناسب أدناه للحصول على مقارنة وملاحظات لكل عائلة.

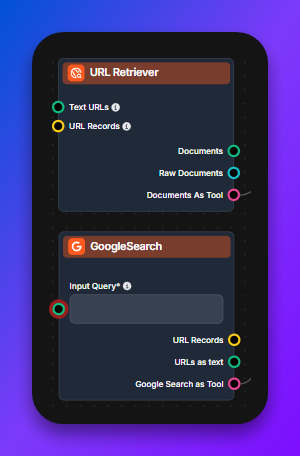

يصبح AI Agent أكثر فائدة بشكل كبير عندما يمكنه استخدام الأدوات. الأدوات الشائعة:

الأدوات لا تعتمد على نموذج معين. أي LLM تختاره في الخطوة 4 يمكنه استخدام أي أداة تربطها.

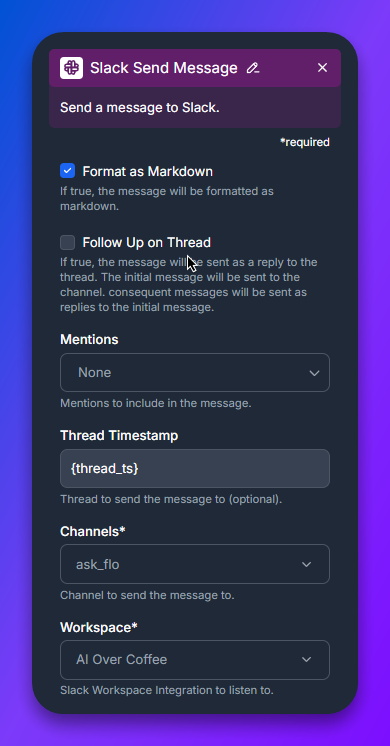

أنه سير العمل بمكوّن إرسال رسالة Slack، مهيأ لنفس القناة ومساحة العمل في الخطوة 2. احفظ سير العمل، وافتح Slack، وأشِر إلى الروبوت باستخدام @ في قناة الاختبار. يجب أن يستجيب الروبوت باستخدام النموذج الذي اخترته في الخطوة 4.

هذا هو الإعداد بأكمله. تبديل النماذج لاحقًا هو تغيير بنقرة واحدة في الخطوة 4 — لا تعديلات على الكود، ولا إعادة بناء لسير العمل.

تعمل كل عائلة LLM رئيسية في سير عمل Slack الخاص بـ FlowHunt. تنحصر الفروقات في التكلفة، والكمون، ونافذة السياق، وعمق الاستدلال، وجودة استدعاء الأدوات. استخدم الجدول لتقصير القائمة، ثم اقرأ القسم الخاص بكل عائلة للحصول على ملاحظات الإعداد.

| عائلة النموذج | الأفضل لـ | الكمون | التكلفة | الملاحظات |

|---|---|---|---|---|

| Claude (Anthropic) | تحليل السياق الطويل، الاستدلال الدقيق، مراجعة الكود | متوسط | متوسط–مرتفع | قوي في اتباع التعليمات الدقيقة؛ ممتاز للأسئلة والأجوبة الداخلية على المستندات |

| GPT / سلسلة o (OpenAI) | استخدام عام، نظام أدوات واسع، متعدد الوسائط | منخفض–متوسط | منخفض (mini) – مرتفع (سلسلة o) | GPT-4o Mini هو النقطة المثالية الافتراضية؛ o1 / o3 للاستدلال الصعب |

| Gemini (Google) | نوافذ سياق ضخمة، وسائط متعددة سريعة، مدعوم بالبحث | منخفض | منخفض–متوسط | يتعامل 1.5 Pro مع أكثر من مليون توكن؛ رائع للأسئلة والأجوبة على المستند بأكمله في Slack |

| Grok (xAI) | استعلامات في الوقت الفعلي / مدركة للأخبار، بيانات X (Twitter)، نبرة عفوية | منخفض | متوسط | الأفضل عندما يحتاج الروبوت إلى الوعي بالأحداث الجارية |

| Llama (Meta) | عمليات نشر ذاتية الاستضافة / خاصة، أعباء عمل حساسة للتكلفة | يعتمد على المضيف | منخفض (ذاتي الاستضافة) | أوزان مفتوحة — استخدمه عند أهمية إقامة البيانات |

| Mistral | أوزان مفتوحة، توازن بين التكلفة والجودة، استضافة صديقة للاتحاد الأوروبي | منخفض | منخفض–متوسط | يتنافس Mistral Large مع GPT-4o بتكلفة أقل |

اختر واحدًا للبدء. تبديل النماذج في FlowHunt هو تغيير بنقرة واحدة في مكوّن LLM، لذا فإن المبالغة في التفكير في الاختيار الأولي لا تستحق العناء — انشر بافتراض معقول، وقس الجودة على حركة Slack الفعلية، ثم كرّر.

كل قسم أدناه قائم بذاته. اختر القسم الخاص بعائلة النموذج التي تربطها واتبع ملاحظاته.

Claude هو عائلة LLM الخاصة بـ Anthropic، ومناسب جدًا لروبوتات Slack التي تتعامل مع الأسئلة والأجوبة الداخلية الدقيقة، وتلخيص المستندات، ومراجعة الكود، واتباع التعليمات بعناية. لربط Claude بـ Slack، أسقط مكوّن LLM Anthropic في الخطوة 4 واختر النسخة:

لروبوتات Slack القائمة على المعرفة الداخلية على Notion أو Confluence، فإن Claude 3.5 Sonnet مع Document Retriever هو نقطة البداية الأكثر موثوقية.

نماذج OpenAI من GPT وسلسلة o هي الخيار الأوسع لـ Slack — أداء عام قوي، وأفضل استدعاء للأدوات نضوجًا، وإدخال متعدد الوسائط (رؤية، صوت). أسقط مكوّن LLM OpenAI في الخطوة 4 واختر النسخة:

بالنسبة لمعظم الفرق، ابدأ بـ GPT-4o Mini. ارتقِ إلى GPT-4o أو o1 فقط في سير العمل الذي يشتكي فيه المستخدمون من جودة الإجابة.

Google Gemini هو الخيار الأقوى عندما تكون نافذة السياق مهمة — يتعامل Gemini 1.5 Pro مع أكثر من مليون توكن، وهو ما يكفي لإسقاط قواعد كود كاملة أو مجموعات مستندات في استعلام Slack واحد. أسقط مكوّن LLM Google في الخطوة 4 واختر النسخة:

إذا احتاج Slackbot الخاص بك إلى الاستدلال على قاعدة المعرفة الكاملة الخاصة بك في تمريرة واحدة (بدون خطوة استرجاع)، فإن نافذة سياق Gemini Pro هي أنظف إجابة.

تم دمج xAI Grok في سير عمل Slack الخاص بـ FlowHunt بنفس طريقة النماذج الأخرى — أسقط مكوّن LLM xAI (أو استخدم مكوّن LLM OpenAI الذي يشير إلى نقطة نهاية Grok، اعتمادًا على إصدار FlowHunt الخاص بك) واختر نسخة Grok. السمة المميزة لـ Grok هي الوعي في الوقت الفعلي — لديه إمكانية الوصول إلى المعلومات الحية، بما في ذلك بيانات X (Twitter)، مما يجعله الخيار الأفضل عندما يحتاج Slackbot إلى سياق الأحداث الجارية: الأخبار، وبيانات السوق، والتطورات العاجلة. اقرنه بـ Google Search Tool لمزيد من الوصول الواسع إلى الويب.

عائلة Llama من Meta هي الخيار ذو الأوزان المفتوحة — استخدمها عندما تستبعد إقامة البيانات أو الاستضافة الذاتية أو التكلفة لكل توكن واجهات برمجة التطبيقات المستضافة. أسقط مكوّن LLM Meta في الخطوة 4 واختر النسخة:

Llama هو الإجابة الصحيحة عندما يطلب فريق الأمان أو الامتثال لديك أن يعمل النموذج على بنية تحتية تتحكم فيها، أو عندما يجعل حجم الرسائل المرتفع تكاليف واجهة برمجة التطبيقات المستضافة باهظة.

Mistral هو المنافس الأوروبي ذو الأوزان المفتوحة — نماذج قوية، استضافة صديقة للاتحاد الأوروبي، وأداء جيد مقابل السعر. أسقط مكوّن LLM Mistral في الخطوة 4 واختر النسخة:

اختر Mistral عندما تكون إقامة البيانات في الاتحاد الأوروبي مهمة، أو عندما تريد مرونة الأوزان المفتوحة بجودة أقرب إلى الحدود من Llama 3.x في بعض المعايير.

تغطي ثلاثة أنماط لسير العمل معظم عمليات نشر Slack. ابنِ أيًا منها فوق الإعداد أعلاه عن طريق تعديل أدوات AI Agent والـ prompt:

تتطبق هذه الأنماط بسلاسة: يمكن لسير عمل Slack واحد أن يجمع بين استرجاع قاعدة المعرفة، والبحث الحي على الويب، واستدعاءات API الداخلية، مع اختيار LLM للأداة المناسبة لكل استعلام.

الروبوت لا يستجيب للرسائل. تحقق من أن “تشغيل عند الإشارة فقط” يطابق طريقة اختبارك — إذا كان مفعلاً، يجب عليك الإشارة إلى الروبوت باستخدام @. تأكد من أن القناة في استقبال رسالة Slack تطابق القناة التي تنشر فيها.

الروبوت يستجيب لكن الإجابة سيئة. كرر على backstory وgoal الخاصين بـ AI Agent أولاً — فهي أكثر تأثيرًا من تبديل النماذج. إذا كانت الجودة لا تزال سيئة بعد تكرار الـ prompt، ارتقِ إلى نموذج أقوى في مكوّن LLM (Mini → قياسي → المستوى الأعلى).

أخطاء الأذونات بعد مصادقة Slack. أعد ربط تكامل Slack في علامة تبويب التكاملات في FlowHunt وأعد منح الأذونات. يلغي Slack أحيانًا التوكنات بعد تغييرات مالك مساحة العمل.

الردود الطويلة تُقطع في Slack. لـ Slack حد أقصى للأحرف لكل رسالة. أضف خطوة معالجة لاحقة في سير العمل لتقسيم الردود الطويلة، أو وجّه AI Agent في goal الخاص به للحفاظ على الردود تحت 3000 حرف عند النشر إلى Slack.

الإعداد بأكمله — ربط Slack، وبناء سير العمل، واختيار نموذج — هو مشروع لمساء واحد في FlowHunt. سير العمل الذي تبنيه اليوم يعمل مع أي نموذج مستقبلي: عند ظهور GPT-6 أو Claude 5، تستبدل مكوّن LLM ويستمر بقية سير العمل في العمل.

ابدأ بـ الفئة المجانية لـ FlowHunt ، واربط Slack، وأطلق Slackbot ذكيًا يعمل قبل الغداء.

أرشيا هو مهندس سير عمل الذكاء الاصطناعي في FlowHunt. بخلفية في علوم الحاسوب وشغف بالذكاء الاصطناعي، يختص في إنشاء سير عمل فعّال يدمج أدوات الذكاء الاصطناعي في المهام اليومية، مما يعزز الإنتاجية والإبداع.

يربط منشئ سير العمل بدون كود من FlowHunt بين Slack وكل نماذج LLM الكبرى — Claude وGPT وGemini وGrok وLlama وMistral — من خلال سير عمل واحد متسق. لا كود، ولا بنية تحتية لإدارتها.

يتيح تكامل FlowHunt مع Slack التعاون السلس مع الذكاء الاصطناعي مباشرة داخل مساحة عمل Slack الخاصة بك. يمكنك إضافة أي Flow إلى Slack، وأتمتة سير العمل، وتقديم ال...

قم بدمج FlowHunt مع Slack لأتمتة الرسائل، تشغيل سير العمل، وإبقاء فريقك على اطلاع دائم من خلال التدفقات المدعومة بالذكاء الاصطناعي....

يقدم FlowHunt 2.6.12 تكامل Slack، وتصنيف النوايا، ونموذج Gemini، مما يعزز وظائف شات بوت الذكاء الاصطناعي، وفهم العملاء، وسير العمل في الفريق....

الموافقة على ملفات تعريف الارتباط

نستخدم ملفات تعريف الارتباط لتعزيز تجربة التصفح وتحليل حركة المرور لدينا. See our privacy policy.